逻辑回归中的梯度下降(Logistic Regression Gradient Descent)

本节我们讨论怎样通过计算偏导数来实现逻辑回归的梯度下降算法。

它的关键点是几个重要公式,其作用是用来实现逻辑回归中梯度下降算法。

但是在本节中,将使用计算图对梯度下降算法进行计算。必须要承认的是,使用计算图来计算逻辑回归的梯度下降算法有点大材小用了。但是,以这个例子作为开始来讲解,可以使你更好的理解背后的思想。从而在讨论神经网络时,你可以更深刻而全面地理解神经网络。

接下来让我们开始学习逻辑回归的梯度下降算法。

假设样本只有两个特征x_1和x_2,为了计算z,我们需要输入参数w_1、w_2 和b,除此之外还有特征值x_1和x_2。因此z的计算公式为: z=w_1 x_1+w_2 x_2+b

回想一下逻辑回归的公式定义如下:

^y=a=σ(z) 其中z=w^T x+b , σ(z)=1/(1+e^(-z) )

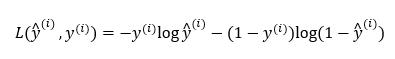

损失函数:

代价函数:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?