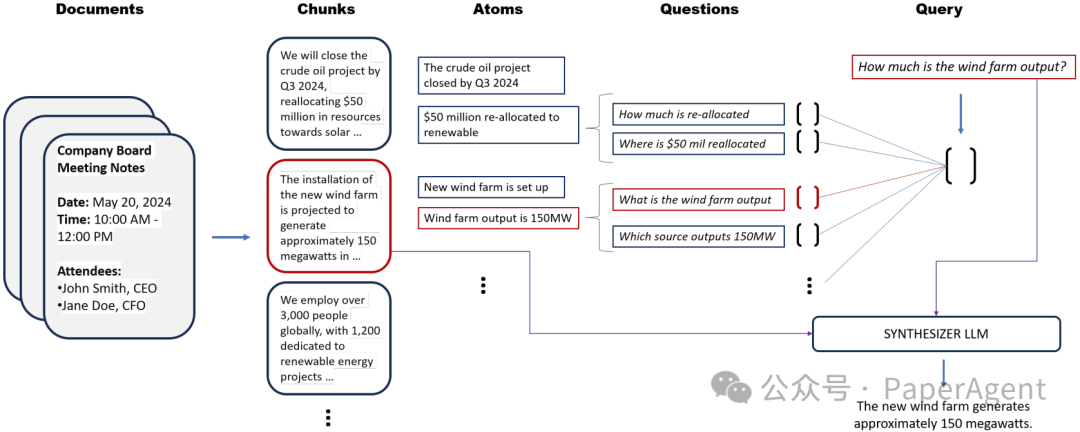

RAG框架的核心在于将文档分割成独立的块(chunks),然后通过检索过程识别与给定查询相关的块,并将检索到的块(以及查询)作为提示传递给合成模型LLM以生成所需的响应。然而,检索步骤可能成为性能瓶颈,因为错误的块可能导致合成LLM生成错误的响应(garbage in,garbage out)。

为了解决这个问题,提出了一种零样本(zeroshot)适应标准密集检索步骤的方法,以提高块的准确召回(recall)。具体来说,将块分解为原子陈述(atomic statements),然后基于这些原子生成一组合成问题(以块作为上下文),通过密集检索找到与用户查询最接近的合成问题集合及其相关的块。

使用原子单位基于问题的检索,用于企业RAG

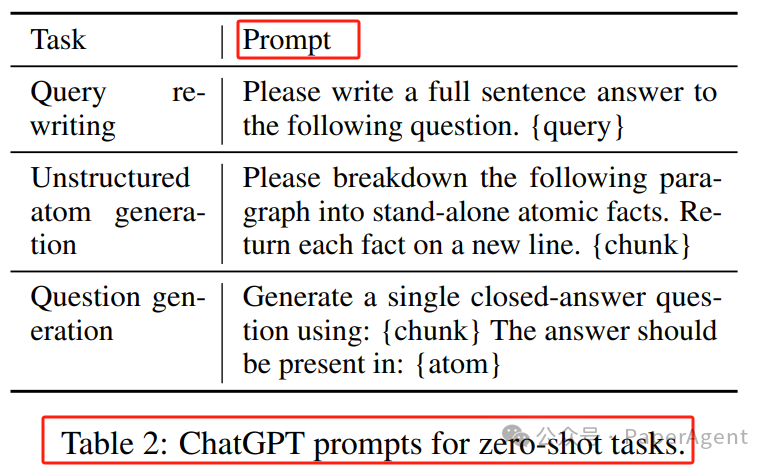

各环节(query改写,原子化,问题生成)的prompt

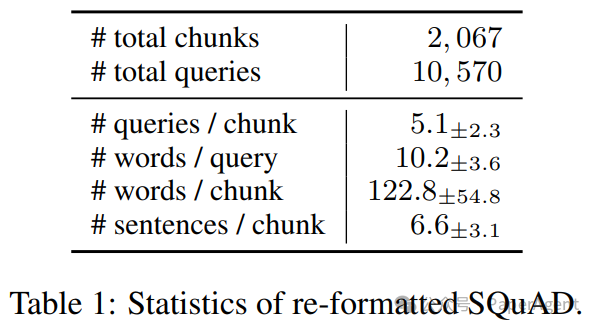

使用了重新格式化的SQuAD数据集来评估RAG框架。该数据集包含2,067个块和10,570个查询。

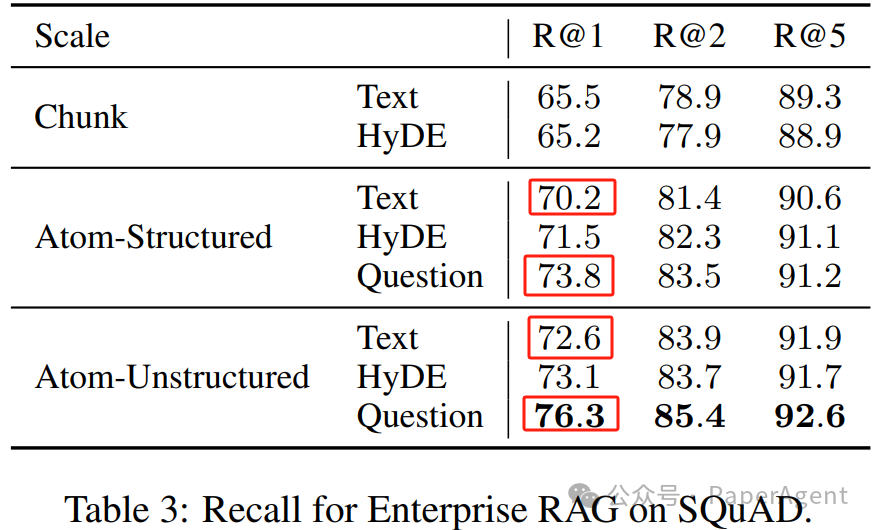

使用原子单位进行检索可以显著提高检索的准确率。特别是,通过生成针对原子的合成问题,可以进一步提高检索的准确率。例如,在R@1(即正确块在检索结果中排名第一的比例)上,使用结构化原子文本的检索准确率从65.5%提高到70.2%,而_使用合成问题进一步提高到73.8%_。

Atom-Structured:使用块的自然结构,将每个句子视为一个独立的原子。Atom-Unstructured:原子生成系统(例如,针对指令微调的大型语言模型)被要求生成原子陈述,以最好地捕捉块中的所有信息。

这种方法不需要额外的训练,可以零样本地应用于企业RAG系统中,以提高对公司文档的自动化查询性能。未来的工作将扩展到不同领域的数据集,包括金融和医疗领域。

Question-Based Retrieval using Atomic Units for Enterprise RAG``https://github.com/OpenBMB/MiniCPM-Vhttps://arxiv.org/pdf/2405.12363

## AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

四、AI大模型商业化落地方案

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?