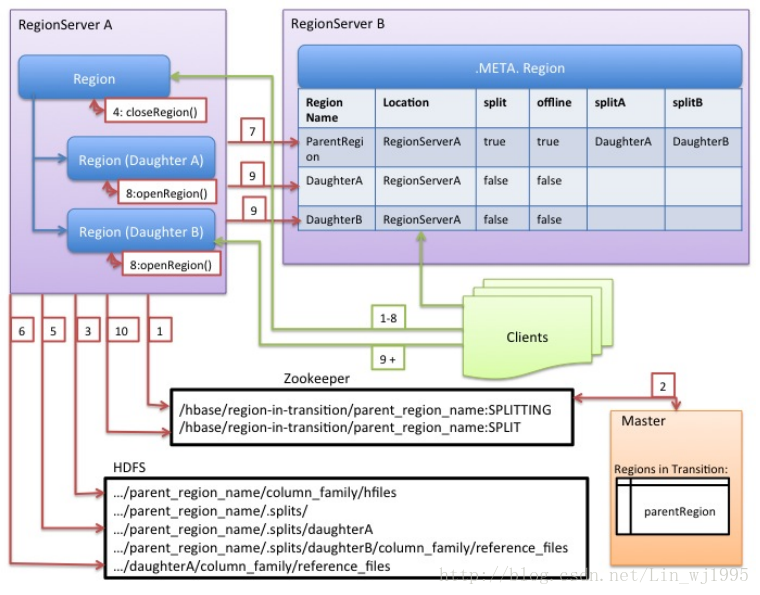

- 将region进行锁定,防止修改,然后在Zookeeper中创建一个节点,并将改节点修改为SPLITTING

- HMaster知道了该Region正在分裂

- RegionServer在HDFS的region目录下创建.split的子目录

- RegionServer关闭Region,并将其标记为离线状态,此时如果有客户端进行请求,那么抛出NotServingRegionException异常

- RegionServer在.split目录下为子RegionA和B创建目录,并且创建必要的数据结构。然后RegionServer分裂StoreFile,并且为每个store file创建两份(??为什么是两份)引用文件,这些引用文件指向父Region的文件

- RegionServer在HDFS中创建子region的目录,并将父region的引用文件移动到子region的目录下

- RegionServer在Meta表中将父Region的相关信息设置成offline,并且在Meta表中添加子region的信息。此时如果用户scan meta表,将会看到父region已经分裂了,但是还不知道具体分裂成那些子region直到子region出现在meta表中。如果子region的信息put到了meta表,那么这次split将会生效。如果RegionServer在rpc成功之前挂掉了,那么master和下个RegionServer将会打开region并清除这次split失败后产生的脏数据。在Meta表更新后,这次split将会被master回滚

- RegionServer将会平行的打开子regionA和B

- 然后将子region的信息和主region的信息添加到meta表中,现在子region正式上线。通过这次操作,用户可以查到该region并且能够查询该region的内容。客户端在本地缓存的meta信息,将会在请求该RegionServer后被清除,并且从meta表中重新缓存新的Region的信息

- RegionServer将会更新ZK中的 /hbase/region-in-transition/region-name 节点中之前设置的SPLIT状态成为FINISH状态,从而Master能够感知到Split已经完成。如果需要,子region能够自由的讲数据重新分配给其它的region。此时split成功。

- 分裂后,Meta和hdfs还包含父region的引用,这些引用将会被移除当子region重写数据文件时。在Master中的垃圾回收的程序会定期的检查子region中是否仍然有指向父region的文件。如果没有,父region将会被删除。

HBase中RegionServer Split的过程(翻译)

最新推荐文章于 2022-12-09 15:45:19 发布

9985

9985

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?