准备工作:

我们的三个节点的集群(master,slave1,slave2)已经安装成功并且启动,具体安装方法可以参照之前的一篇教程Hadoop-2.6.4集群安装(详细图文)。

由于我们之前已经克隆出来一台,这次我们可以拿这一台来练习,先备份,搞崩了拿新的再搞!

当然,大家也可以自己重新安装一台,然后要安装配置好 jdk,最好是跟之前安装的版本一致,免得出什么幺蛾子。

既然是动态添加,就意味着机器不重启,其实在实际工作环境中,集群跑起来之后是不会那么容易就重启的。

1 准备工作之后的一堆小工作

机器我们是准备好了,但是我们还需要配置好多东西才可以正式开始。

比如,我们需要修改第四台机器的 hostname,配置静态IP,配置 ssh。这些可以参照之前的安装方法,我也就不再重复一遍了,相信大家这么长时间了,这些东西早就搞的很6了。

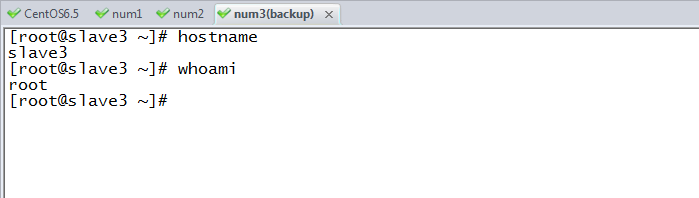

这里我把第四台机器的 hostname 配置成了 slave3。

声明:在工作环境中最好是不要用 root 用户来配置 hadoop,不然就是徒增麻烦。用我们之前的 hadoop 用户,但是我们是学习阶段,为了方便操作,就一路使用了 root 用户。

2 正式工作

在之前的准备工作之后的一堆小工作做完之后,我们就可以开始配置了。

2.1 复制 hadoop-2.6.4

在 master 主机上,将 hadoop-2.6.4 整个目录复制到 slave3 上:

[root@master hadoop-2.6.4]# hostname

master

[root@master hadoop-2.6.4]# pwd

/usr/hadoop/hadoop-2.6.4

[root@master hadoop-2.6.4]# scp . root@slave3:/usr/hadoop/hadoop-2.6.4

...

[root@master hadoop-2.6.4]#之后我们到 slave3 主机上,进到 /usr/hadoop/hadoop-2.6.4 目录,将 logs 目录中的文件全删掉:

[root@slave3 ~]# hostname

slave3

[root@slave3 ~]# cd /usr/hadoop/hadoop-2.6.4/logs

[root@slave3 logs]# rm -f *.*

[root@slave3 logs]#我没有在逗你,”*.*“表示的任意格式的文件,不是表情^&^

2.2 修改 slave3 的环境变量

其实这个我们可以偷个懒,直接拷贝 master 上的就可以了:

[root@master hadoop-2.6.4]# hostname

master

[root@master hadoop-2.6.4]# scp /etc/profile root@slave3:/etc/

~~

[root@master hadoop-2.6.4]# source /etc/profile

[root@master hadoop-2.6.4]# 2.3 在 slave3 节点上启动 datanode

启动 datanode,但是这次用到的命令不一样:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2504

2504

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?