阅读目录:

-

先认识一下AI大模型家族

-

AI是什么?

-

机器学习是什么?

-

机器学习有哪些分支?

-

什么是强化学习?

-

深度学习属于哪类学习?

-

生成式AI和深度学习是什么关系?

-

大语言模型是什么?

-

所有大语言模型都是生成式AI?

-

大语言模型LLM (large language model)到底是什么?

-

大模型LLM的“大”是什么含义?

-

LLM核心技术到底是什么?

【以下正文】

今天,我们突然发现,AI可以帮忙生成文字、图片、音频和视频等等内容了,而且让人难以分清背后的创作者到底是人类还是AI。这些AI生成的内容被叫做AIGC,它是AI generated content,即AI生成内容的简写。像ChatGPT生成的文章、GitHub Copilot生成的代码、Midjourney生成的图片等,都属于AIGC。而当AIGC这个词在国内火爆的同时,海外更流行的是另外一个词Generative AI,即生成式AI。从字面上来看,生成式AI,这之间的关系很好理解,生成式AI所生成的内容就是AIGC。所以,ChatGPT、GitHub Copilot、Midjourney等都属于生成式AI。由此可见,AIGC和生成式AI的概念都是很容易理解。因为AI这个词,在国内比生成式AI更加流行,很多语境下AIGC也被用于指代生成式AI。

AIGC主要有两种类型:一种是基于模板的自动化生成,另一种是基于深度学习技术的自动化生成。

首先,基于模板的自动化生成是一种较为简单的AIGC方法。其基本原理是先设计一个模板,然后填充模板中的空白部分以生成内容。这种方法的优点是生成的内容结构清晰、逻辑严谨,但缺点是生成的内容形式单一、难以与其他文章区分开来。

其次,基于深度学习技术的自动化生成则更加灵活,可以根据需求自由生成不同风格、不同主题的内容。与基于模板的自动化生成相比,基于深度学习技术的自动化生成能够更好地满足用户的需求,但也存在着一些问题,例如生成的内容质量和可信度难以保证,需要经过人工编辑和审核。

AIGC将走过三个发展阶段:第一个阶段是“助手阶段”,AIGC用来辅助人类进行内容生产;第二个阶段是“协作阶段”,AIGC以虚实并存的虚拟人形态出现,形成人机共生的局面;第三个阶段是“原创阶段”,AIGC将独立完成内容创作。

先认识一下AI大模型家族

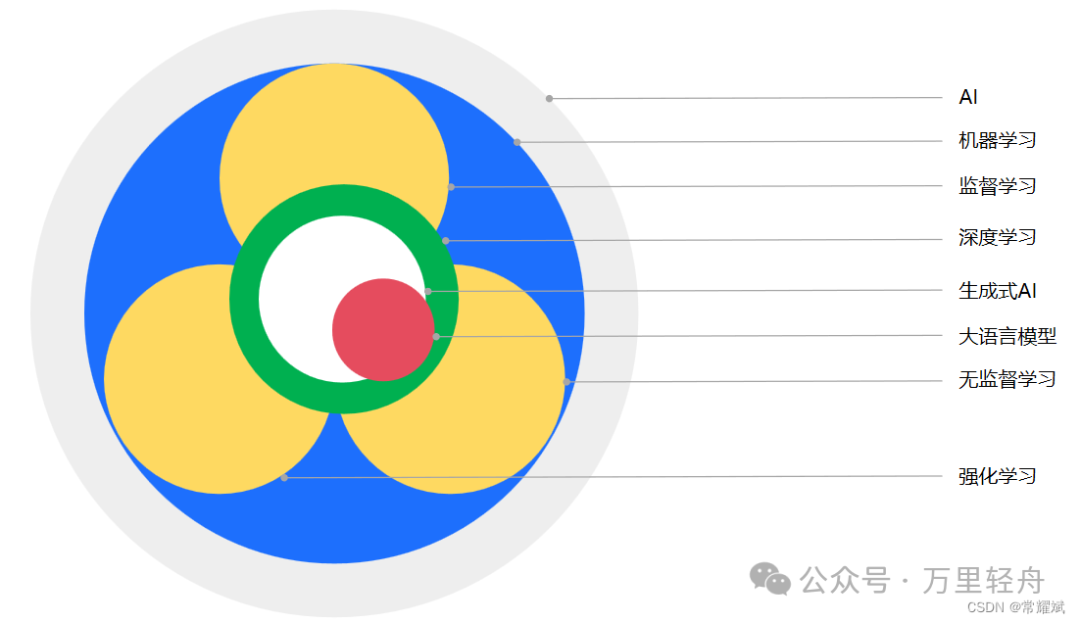

生成式AI、监督学习、无监督学习、强化学习、深度学习、大语言模型、Transformer等,这些算法之间又是什么关系呢?

其实,这些AI知识点,如何了解原理,可以一言以蔽之,先通过一张图,感性认识它们之间的关系。

AI是什么?

人工智能(Artificial Intelligence),英文缩写为AI。是计算机科学的一个分支学科,旨在让计算机系统去模拟人类的智能,从而解决问题和完成任务。早在1956年,AI就被确立为了一个学科领域,在此后数十年间经历过多轮低谷与繁荣。AI是新一轮科技革命和产业变革的重要驱动力量,是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。人工智能是智能学科重要的组成部分,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式做出反应的智能机器。人工智能是十分广泛的科学,包括机器人、语言识别、图像识别、自然语言处理、专家系统、机器学习,计算机视觉等。AI发展经历了很多举足轻重的关键里程碑,例如:从1943年的神经网络诞生,到2024年的Sora风靡全球,经历了81年的心路历程。

机器学习是什么?

机器学习是AI的一个子集,它的核心在于不需要人类做显示编程,而是让计算机通过算法自行学习和改进,去识别模式,做出预测和决策。比如,如果我们通过代码告诉电脑,图片里有红色说明是玫瑰,图片里有橙色说明是向日葵,程序对花种类的判断就是通过人类直接明确编写逻辑达成的,不属于机器学习。举例:如果我的电脑,有大量玫瑰和向日葵的图片,让电脑自行识别模式,总结规律,从而能对没见过的图片进行预测和判断,这种就是机器学习。

机器学习有哪些分支?

机器学习有多个分支,包括监督学习、无监督学习、强化学习。在监督学习里,机器学习算法会接受有标签的训练数据,标签就是期望的输出值,所以每个训练数据点都既包括输入特征,也包括期望的输出值。算法的目标:是学习输入和输出之间的映射关系,从而在给定新的输入特征后,能够准确预测出相应的输出值。监督学习任务包括分类和回归,分类数据划分为不同的类别。举例:拿一堆猫和狗的照片,和照片对应的猫狗标签进行训练,然后让模型根据没见过的照片预测是猫还是狗,这就属于分类。举例:拿一些房子特征的数据,比如面积、卧室数、是否带阳台等和相应的房价作为标签进行训练。回归是让模型根据没见过的房子的特征预测房价是什么数值,这就属于回归。无监督学习,和监督学习不同,主要是学习的数据是没有标签的,所以算法的任务是自主发现数据里的规律。无监督学习任务包括聚类,就是把数据进行分组,举例:拿一堆新闻文章,让模型根据主题或内容的特征,自动把相似文章进行组织。

什么是强化学习?

强化学习,是让模型在环境里采取行动,获得结果反馈,从反馈里学习,从而能在给力情况下采取最佳行动来最大化奖励或是最小化损失。举例:和训练小狗类似,刚开始的时候,小狗会随心所欲做出很多动作,但随着和训犬师的互动,小狗会发现某些动作能够获得零食,某些动作没有流失,某些动作甚至会遭受惩罚。通过观察动作和奖惩之间的联系,小狗的行为会逐渐接近训犬师的期望。强化学习可以应用在很多任务上,举例:让模型下围棋时,获得不同行动导致的奖励或损失反馈,从而在一局游戏里优化策略,学习如何采取行动达到高分。

深度学习属于哪类学习?

深度学习属于机器学习中的特殊类,深度学习是机器学习的一个分支,核心在于:使用人工神经网络模仿人脑处理信息的方式,通过层次化的方法提取和表示数据的特征,专注于非结构化数据处理。神经网络,是由许多基本的计算和储存单元组成,这些单元被称为神经元。这些神经元通过层层连接来处理数据,并且深度学习模型通常有很多层,因此称为深度。举例:要用计算机识别小猫的照片。在深度学习中,数据首先被传递到一个输入层,就像人类的眼睛看到图片一样。然后数据通过多个隐藏层,每一层都会对数据进行一些复杂的数学运算,来帮助计算机理解图片中的特征,例如小猫的耳朵、眼睛等等。最后计算机会输出一个答案,表明这是否是一张小猫的图片。神经网络可以用于监督学习、无监督学习、强化学习,所以深度学习不属于他们的子集。

总之,深度学习是机器学习的一个特定领域,它利用人工神经网络模型进行学习和训练。深度学习模型由多个层次(称为神经网络的层)组成,每一层都会对输入数据进行变换和表示。这些网络层通过一系列的非线性转换将输入数据映射到输出结果。深度学习模型的核心是深度神经网络(Deep Neural Network,DNN),它可以通过大量的标记数据进行训练,从而实现高度准确的预测和分类任务。

这里必须提一下,卷积神经网络(CNN)是深度学习的杰出代表作,革命性提升了AI模型在江湖上的多年霸主地位,卷积神经网络作为深度学习中的一种重要网络结构,具有自动提取特征和高效分类的能力。随着深度学习技术的发展,CNN在计算机视觉、自然语言处理、语音识别等领域取得了显著的成果。

生成式AI和深度学习是什么关系?

生成式AI是深度学习的一种应用,它利用神经网络来识别现有的模式和结构,学习生成新的内容,内容形式可以是文本、图片、音频。而大语言模型也叫LLM (large language model),也是深度学习的一种应用,专门用于进行自然语言处理任务。

生成式AI的原理主要基于深度学习技术和神经网络。其基本原理是,通过训练模型来学习从输入到输出的映射关系。这种映射关系通常由一组权重和偏置参数来定义,这些参数是通过优化损失函数来获得的。通过调整这些参数,模型可以逐渐改进其预测和生成结果的能力。

生成式AI的神经网络通常采用前馈神经网络(Feedforward Neural Network)或循环神经网络(Recurrent Neural Network)。在前馈神经网络中,信息从输入层逐层传递到输出层,每个神经元只与前一层的神经元相连。而在循环神经网络中,信息在同一个网络中循环传递,每个神经元可以与自身的多个输出相连。这两种网络结构都可以用于生成式AI,但它们的应用场景有所不同。

生成式AI的优点在于,它可以高效地生成大量有意义的内容,比如文章、图像、音频等。此外,它还可以根据用户的个性化需求,生成符合用户兴趣和需求的内容。但是,生成式AI也存在一些缺点,比如它可能会出现语法错误、语义错误等问题,而且它生成的内容可能缺乏创新性和独特性。

2024年2月16日,OpenAI发布了“文生视频”(text-to-video)的大模型工具,Sora(利用自然语言描述,生成视频)。这个消息一经发出,全球社交主流媒体平台以及整个世界都再次被OpenAI震撼了。AI视频的高度一下子被Sora拉高了,要知道Runway Pika等文生视频工具,都还在突破几秒内的连贯性,而Sora已经可以直接生成长达60s的一镜到底视频,要知道目前Sora还没有正式发布,就已经能达到这个效果。

大语言模型是什么?

大语言模型里面的大字说明模型的参数量非常大,可能有数十亿甚至到万亿个,而且训练过程中也需要海量文本数据集,所以能更好的理解自然语言以及生成高质量的文本。大语言模型的例子有非常多,比如国外的GPT、LLaMA,国内的ERNIE、ChatGLM等,可以进行文本的理解和生成。举例:以GPT3这个模型为例子,它会根据输入Prompt提示词(提示词Prompt,简单来说,就是让告诉Chatgpt它需要做什么,类似程序员编程。但不同之处在于,你只需要输入纯文本,ChatGPT会尽可能地理解你的意思,并完成你提出的任务。)以及前面生成过的词,通过概率计算逐步生成下一个词或Token(Token"(标记),是指将输入文本分解为更小的单位,例如单词、字母或字符。在自然语言处理中,将文本分解为标记有助于模型理解语义和语法结构。当一个Prompt被发送给GPT时,它会被分解成多个Token,这个过程被称为Tokenier。一般情况下,对于英文单词,四个字符表示一个标记Token。对于ChatGPT3.5来说,它最开始支持的Token最大值是4096)来输出文本序列。

所有大语言模型都是生成式AI?

不是所有的生成式AI都是大语言模型,而所有的大语言模型是否都是生成式AI,这也存在些许争议。生成图像的扩散模型(如:Sora)就不是大语言模型,它并不输出文本。因为,有些大元模型由于其架构特点不适合进行文本生成。举例:谷歌的BERT就是一个例子,它的参数量和训练数据很大,属于大语言模型。应用方面,BERT理解上下文的能力很强,因此被谷歌用在搜索上,用来提高搜索排名和信息摘录的准确性。它也被用于情感分析、文本分类等任务。但同时其不擅长文本生成。特别是连贯的长文本生成,所以,普遍认为此类模型不属于生成式AI的范畴。

大语言模型LLM到底是什么?

2022年10月30日,OpenAI发布ChatGPT,一跃成为当下最快达到100万用户的线上产品,也带动大语言模型成为了当下热点,更多AI聊天助手,如雨后春笋一般出现在大家的视野里。那大语言模型干什么了?大语言模型(Large Language Model),也叫LLM ,是用于做自然语言相关任务的深度学习模型,可以模型一些文本内容输入,它能返回相应的输出,完成的具体任务可以是生成、分类、总结、改写等。大语言模型首先需要通过大量文本进行无监督学习。举例:以GPT3为例,它的训练数据有多个互联网文本语料库,覆盖线上书籍、新闻文章、科学论文、维基百科、社交媒体帖子等等。接受海量的训练文本数据,模型能更多了解单词与上下文之间的关系,从而更好地理解文本的含义,并形成更准确的预测。

****大语言模型的"大"是什么含义?

大模型的大,指的不仅仅是训练数据巨大,而是参数数量巨大。参数是模型内部的变量,可以理解为是模型在训练过程中学到的知识。参数决定了模型如何对输入数据做出反应,从而决定模型的行为。在过去的语言模型研究中发现,用更多的数据和算力来训练具有更多参数的模型,很多时候能带来更好的模型表现。这就需要AI学习。举例:做蛋糕,一是只允许AI调整面粉、糖蛋的量;二是可允许AI调整面粉、糖蛋、奶油、牛奶、苏打粉、可可粉的量,以及烤箱的时长和温度。因为后者由于可以调整的变量更多,更能让AI模仿做出更好吃的蛋糕。随着餐数的增加,它甚至有能力做出别的品类,创造一些全新的食品。所以,如今语言模型的参数数量可能是曾经的数万倍甚至数百万倍。以Open AI的第一个大模型GPT1为例,它有1.17亿个参数,到了GPT2,参数有15亿个参数,而这GPT3参数又增长到了1750亿个。这样,大模型不像小模型那样局限于单项或某几项任务,而是具有更加广泛的能力。比如在这之前,我们可能要训练单独的模型,分别去做总结、分类、提取等等任务,但现在一个大模型就可以搞定这一切。像GPT Cloud、文心一言、通义千问等AI聊天助手,都是基于大语言模型的应用。

LLM核心技术到底是什么?

大语言模型公众认知,其技术发展里程碑,其实要回溯到2017年6月,谷歌团队发表论文《Attention is all you need》,提出了transformer架构,至此,自然语言处理的发展方向被革命性的颠覆了。随后,出现了一系列基于transformer架构的模型,2018年OpenAI发布GPT1.0,谷歌发布BERT,2019年OpenAI发布了GPT2.0,百度发布ERNIE1.0等。所以,大语言模型的发展早就如火如荼了。

AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

四、AI大模型商业化落地方案

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?