@正规方程

前言

斯坦福大学吴恩达老师的机器学习课程几乎是每位热爱人工智能领域同学的必修课。网上虽然有许多基于python实现的代码,但大多使用python交互模式解释器ipython实例讲解。本人基于自己的理解采用pycharm提供源代码及个人理解,部分代码可能参考他人代码部分,如有侵权请私信我

一、问题探讨

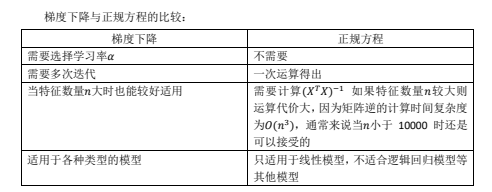

参考视频4-6 ,到目前为止,我们都在使用梯度下降算法寻找局部最优解。但是对于某些线性回归问题,正规方程方法是更好的解决方案:它相较梯度下降算法而言,可以一次计算得出theta且代码简易方便。且不需要我们人为定义学习率a

而正规方程是通过求解下面的方程来找出使得代价函数最小的参数的

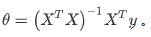

假设我们的训练集特征矩阵为 X,并且我们的训练集结果为向量 y,则利用正规方程解出向量

注:可以看到由于向量theta需要我们求出逆矩阵

所以对于那些不可逆矩阵(通常是因为矩阵之间不独立,如包含英尺为单位的尺寸和米为单位的尺寸两个特征,也有可能是特征数量大于训练集的数量),正规方程方法是不可用的

二、代码解析

1.引入库

代码如下(示例):

def normalEqn(X, y):

theta = np.linalg.inv(X.T@X)@X.T@y#X.T@X等价于X.T.dot(X)

return theta

final_theta2=normalEqn(x2, y2)

print(final_theta2)

注:使用了原数据x2,y2

C:\Users\33696\AppData\Local\Programs\Python\Python39\python.exe D:/pythonProject/Include/机器学习.py

0.4893617021276595

[[-1.10845139e-16 8.84042349e-01 -5.24551809e-02]](梯度下降算法结果)

0.130686706060959

[[-1.11022302e-16]

[ 8.84765988e-01]

[-5.31788197e-02]](正规方程算法结果)

pycharm计算结果如上图所示,可以看到两个计算方法得到的结果相差不大,因而对于读者而言,根据具体的问题,以及特征变量的数量,这两种算法都是值得学习的

总结

总结一下,只要特征变量的数目并不大,标准方程是一个很好的计算参数𝜃的替代方法。

具体地说,只要特征变量数量小于一万,我通常使用标准方程法,而不使用梯度下降法。(吴恩达老师课程讲义)

759

759

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?