目录

3)Regularized linear regression

4)Regularized logistic regression

我们已经学习了线性回归和逻辑回归算法,已经可以有效解决很多问题,但是在实际应用中我们会遇到过拟合问题,这是我们在机器学习中经常遇到的情况。

1)The problem of overfitting

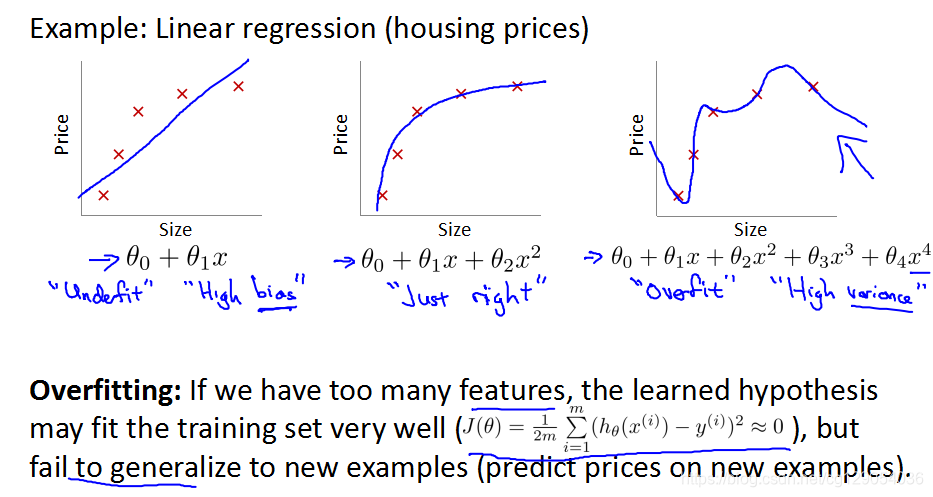

下图是一个回归问题的例子,第一个模型是线性拟合,欠拟合,第三个模型是一个四次方的模型,过于拟合了原始数据,但是对新的数据表现会很差,中间的模型似乎最合适。

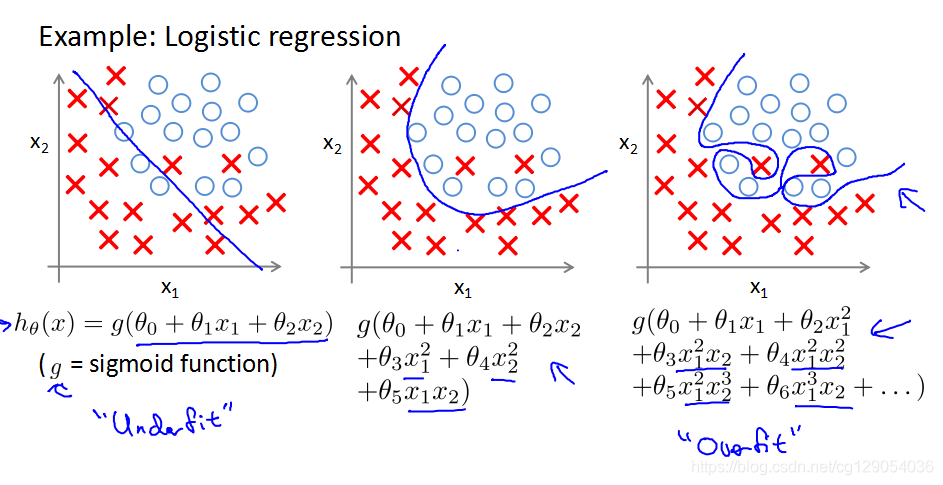

分类问题中,也会出现这种情况,对训练数据拟合越好,对新的数据模型表现就会越差。

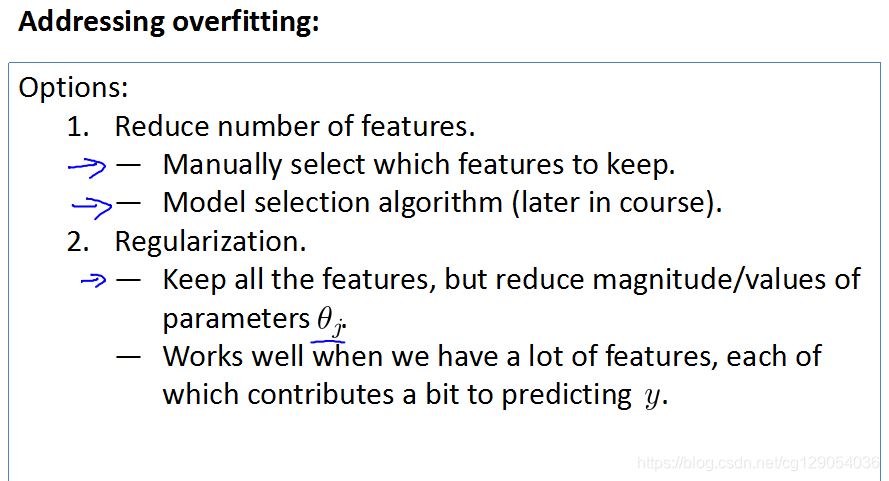

下面给出解决过拟合的几点建议:减少特征数量,正则化;

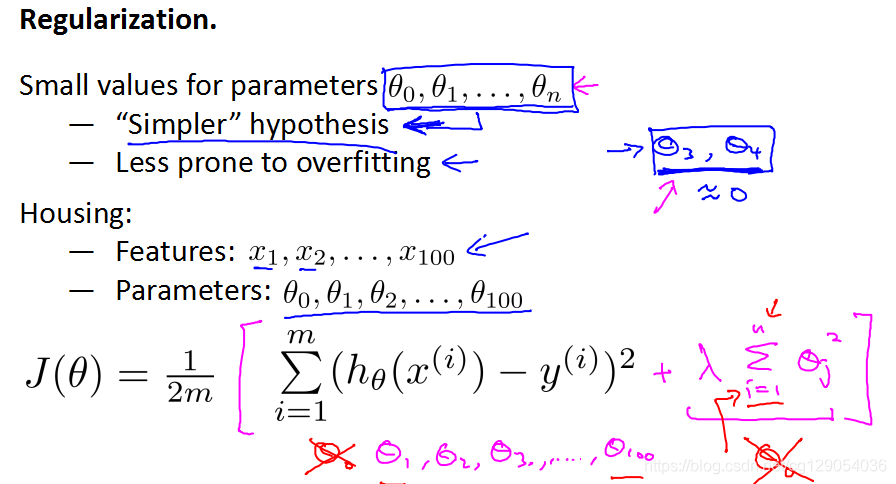

2)Cost function

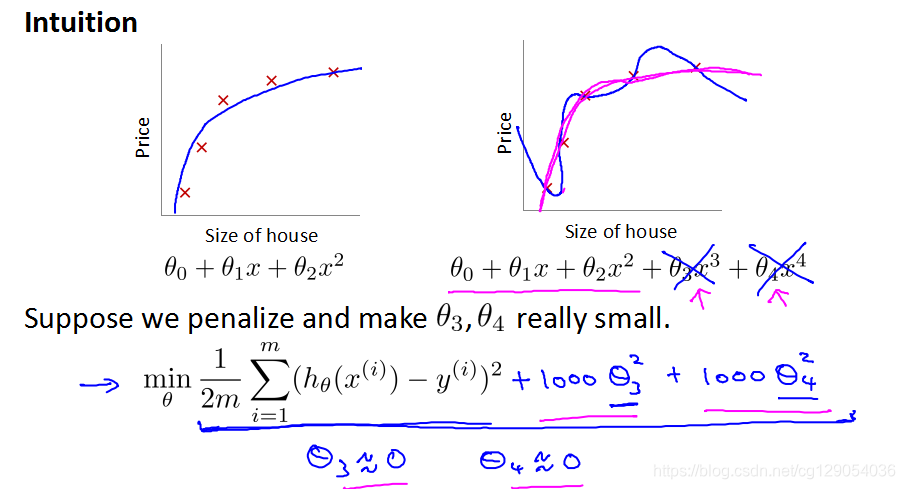

我们之前出现过拟合是因为有高次项,因此我们做一点修改,在一定程度上减少高次项参数的值,如下图:

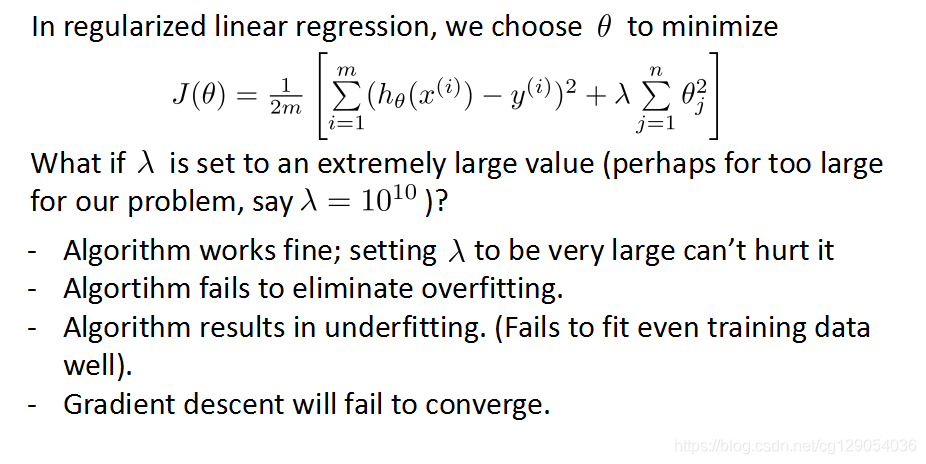

这就是正则化的思想,减少参数的值。但正则化参数不宜太大。

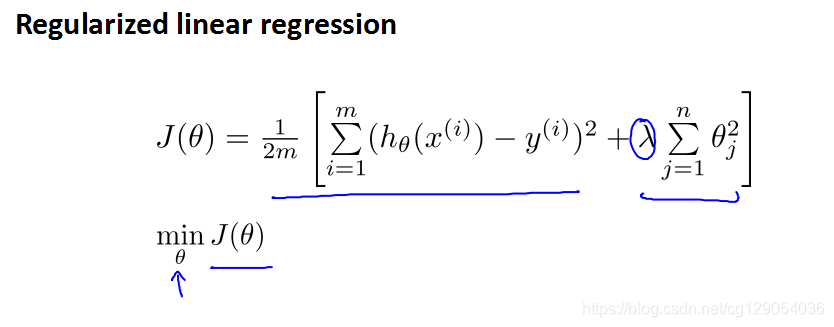

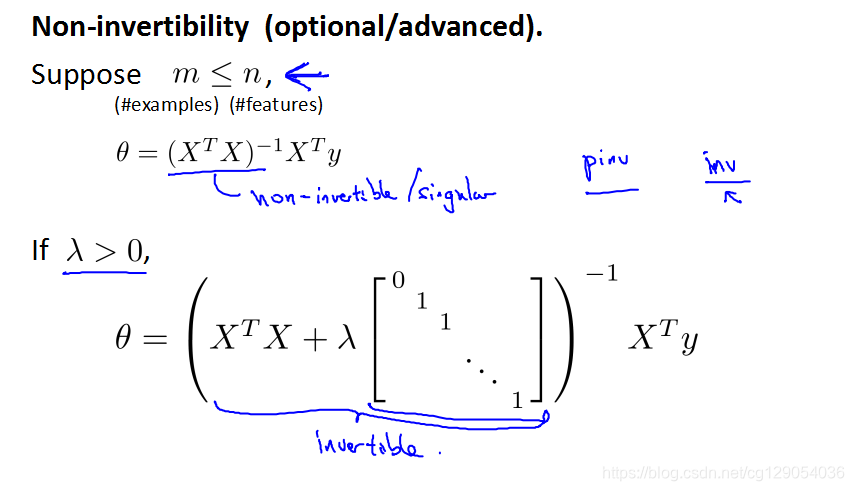

3)Regularized linear regression

这是我们之前修改的带有正则化的成本函数:

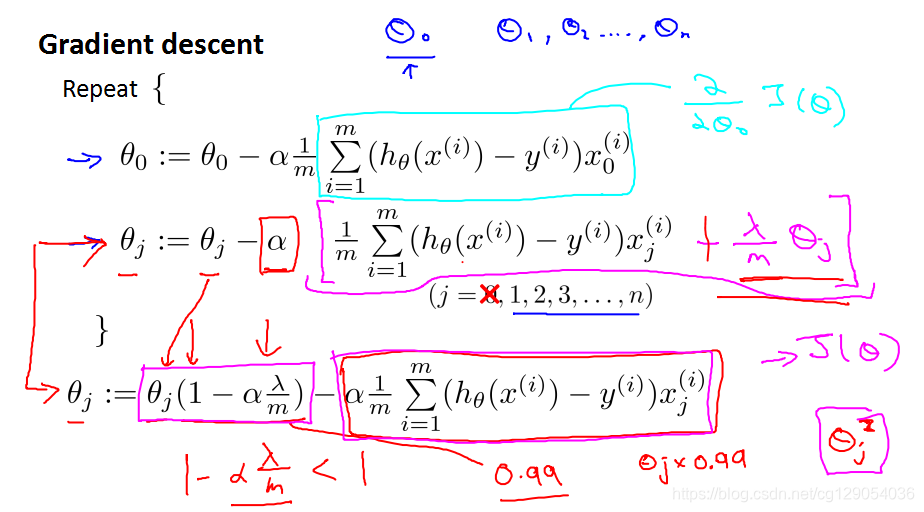

我们还是使用梯度下降算法求参数,多了一个正则项;

对于正规方程,我们也是多了一个正则项矩阵;

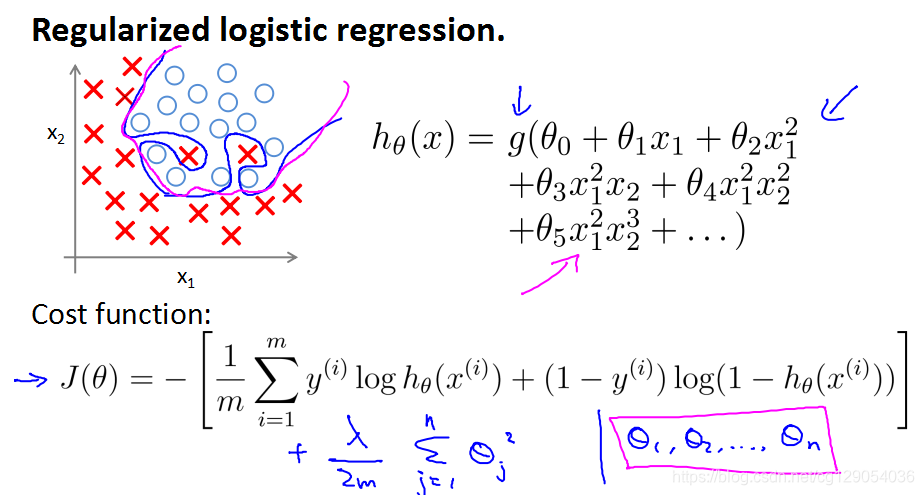

4)Regularized logistic regression

我们来看一下我们修改后的逻辑回归函数的成本函数,多了一个正则项;

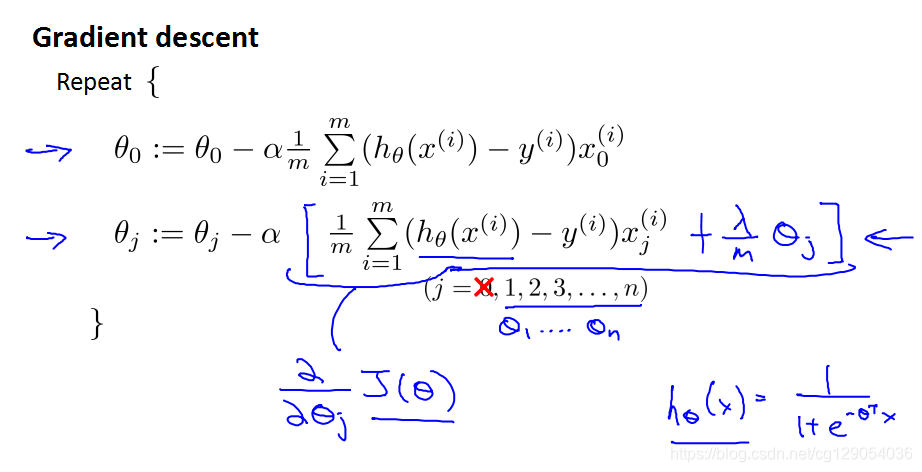

梯度下降法和线性回归形式是一样的。但还需要提醒的是,里面的预测模型是不一样的,逻辑回归预测模型为sigmoid函数。线性回归和逻辑回归算法的第一个参数都不参与正则化。

4591

4591

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?