要学简笔画,不会几款可爱的POP字体怎么行?

要学简笔画,不懂一点作画技巧如何是好?

今天,铃铛子和大家一起来交流POP字体的写法和简笔画的几种简单技法。

一、POP毛毛虫字体的写法

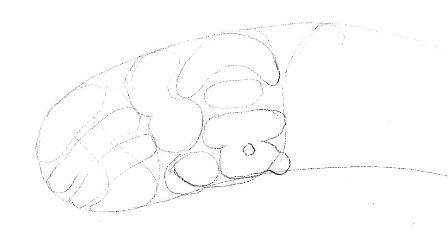

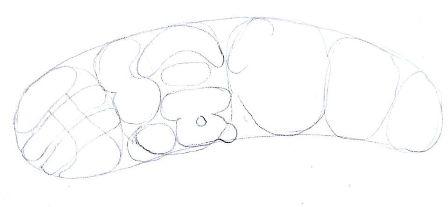

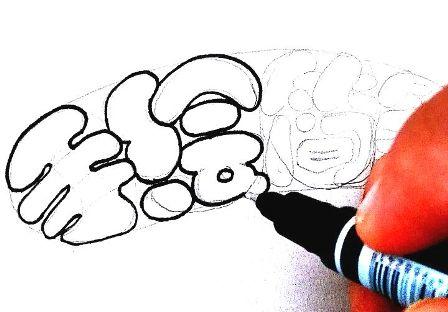

首先画出大致轮廓,一个不规则的拱形圆柱体。

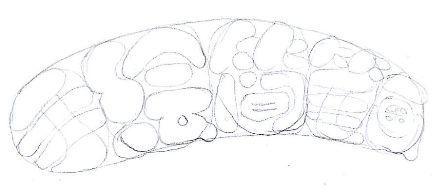

然后用铅笔等分成五分,每个框框里写好字样,再用铅笔描粗成毛毛虫字体,如下图:

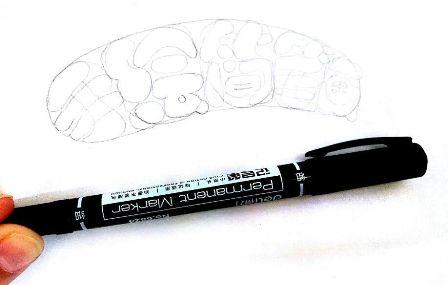

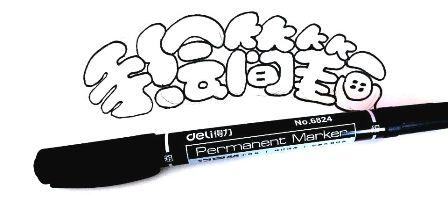

然后用油性笔勾线,在用水溶性彩色笔上色。

上色之前发现图案好单调,要想图文并茂怎么能没有图呢?于是......

我用铅笔做了个造型,然后勾线,最后上色。

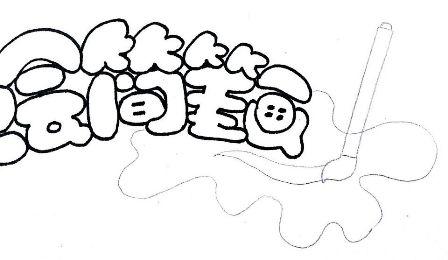

画作完成后,可以适当加一些点缀,让你的图案更加漂亮哦,比如摇晃的短线,有没有让字体充满动感呢?

完成

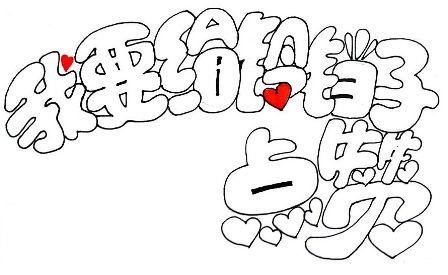

如果你想写——我要给铃铛子点赞应该怎么画呢?

亲,你get到了吗?

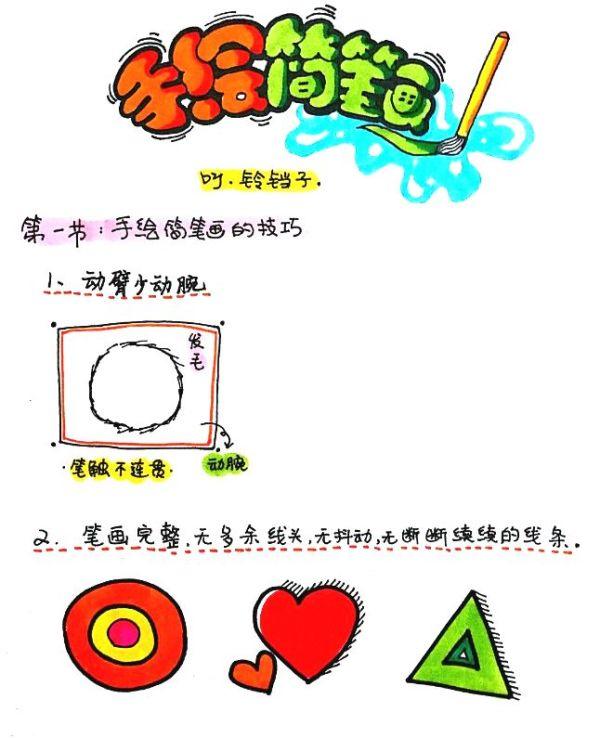

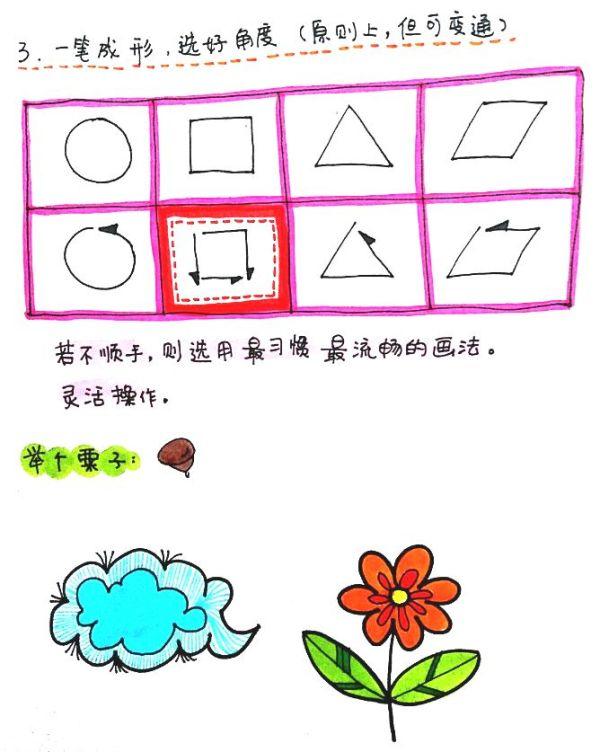

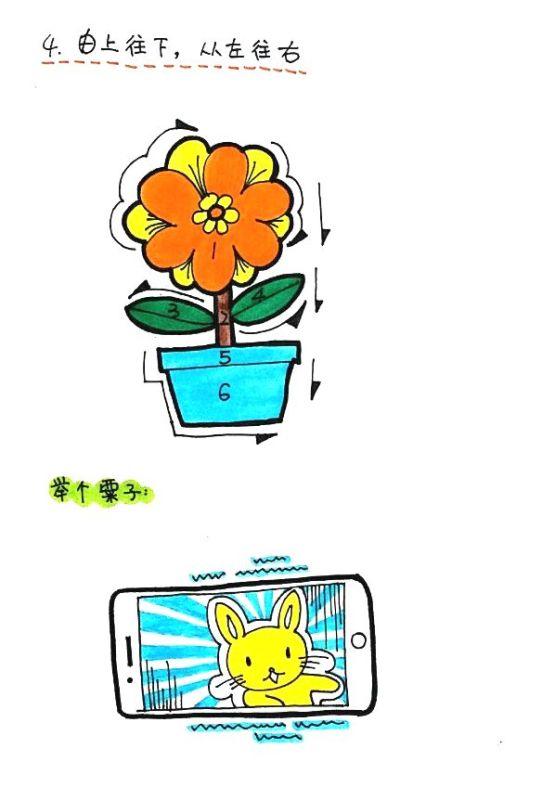

二、说完了字体,我们谈一谈画简笔画的技巧:

学到了怎么多技能,你不练习练习吗?

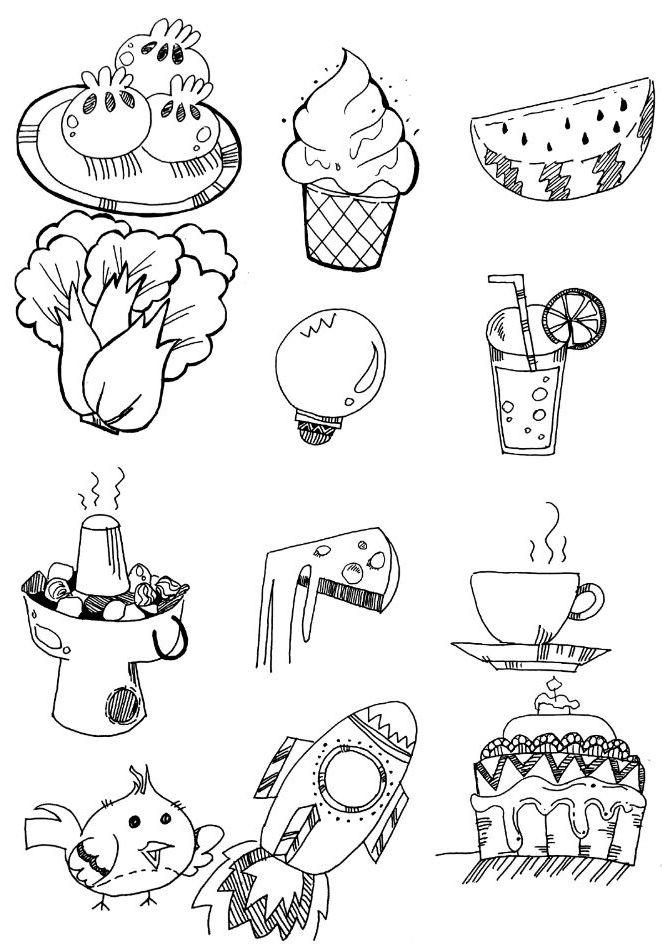

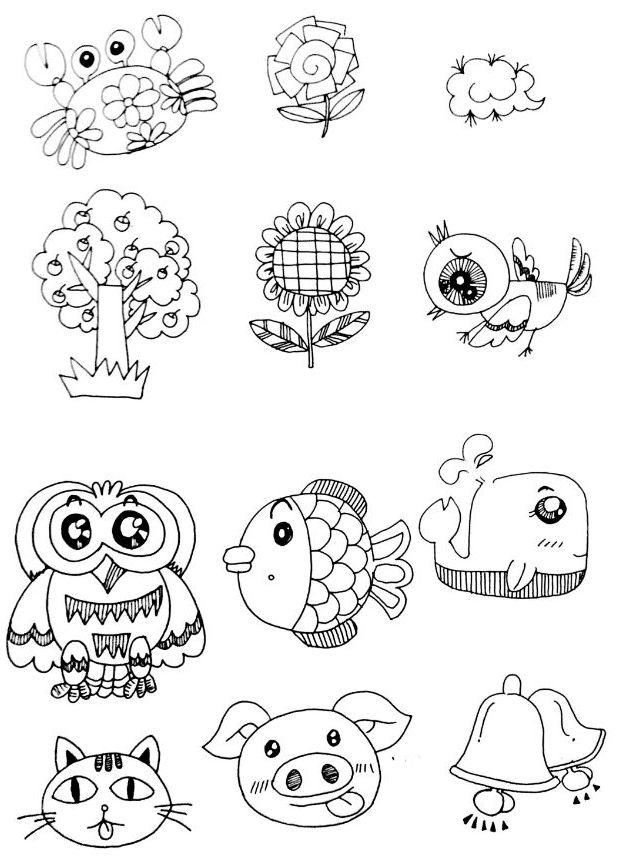

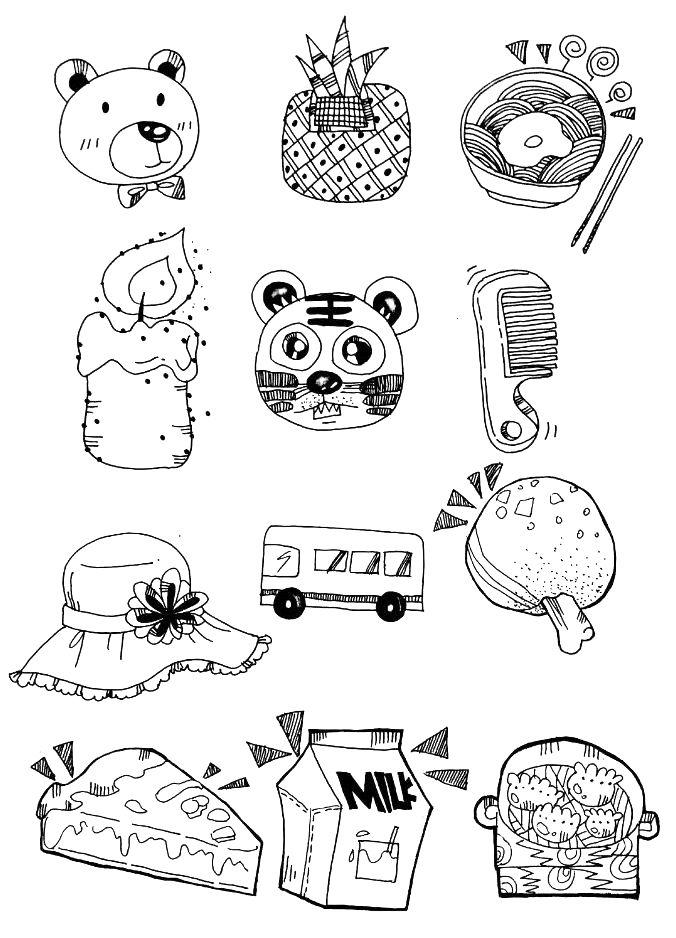

铃铛子手绘了一些素材给大家临摹,接招吧:

聊了这么多,你不给铃铛子点个赞吗?

mua~三颗药!

ALL BY:铃铛子

以下是我的近期教程,来看看吧:

教程 1 | 10分钟成为简笔画达人,然后......

428

428

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?