公司同事的文

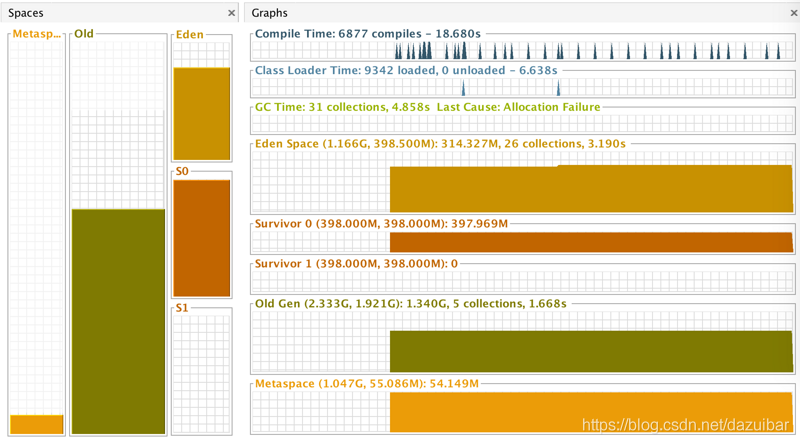

spark的任务,在运行期间executor总是挂掉。刚开始觉得是数据量太大executor内存不够。但是估算了数据量,觉得不应该出现内存不够。于是,首先尝试通过jvisualvm观察executor的内存分布:

老年代还没填满,进程就会出现挂掉的情况,所以并不是jvm级别的OOM。

仔细检查对应NodeManager的日志,发现如下日志:

WARN org.apache.hadoop.yarn.server.nodemanager.containermanager.monitor.ContainersMonitorImpl: Container [pid=1151,containerID=container_1578970174552_5615_01_

000003] is running beyond physical memory limits. Current usage: 4.3 GB of 4 GB physical memory used; 7.8 GB of 8.4 GB virtual memory used. Killing container.

Dump of the process-tree for container_1578970174552_5615_01_000003 :

|- PID PPID PGRPID SESSID CMD_NAME USER_MODE_TIME(MILLIS) SYSTEM_TIME(MILLIS) VMEM_USAGE(BYTES) RSSMEM_USAGE(PAGES) FULL_CMD_LINE

|- 1585 1175 1585 1151 (python) 50 67 567230464 8448 python -m pyspark.daemon

|- 1596 1585 1585 1151 (python) 1006 81 1920327680 303705 python -m pyspark.daemon

|- 1175 1151 1151 1151 (java) ...

|- 1151 1146 1151 1151 (bash) ...

INFO org.apache.hadoop.yarn.server.nodemanager.containermanager.monitor.ContainersMonitorImpl: Memory usage of ProcessTree 1152 for container-id container_1578

970174552_5615_01_000004: 4.3 GB of 4 GB physical memory used; 7.8 GB of 8.4 GB virtual memory used日志说,某个container的进程占用物理内存超过的阈值,yarn将其kill掉了。并且这个内存的统计是基于Process Tree的,我们的spark任务会启动python进程,并将数据通过pyspark传输给python进程,换句话说数据即存在jvm,也存在python进程,如果按照进程树统计,意味着会重复至少两倍。很容易超过“阈值”。

在yarn中,NodeManager会监控container的资源占用,为container设置物理内存和虚拟内存的上限,当超过以后,会kill container。

虚拟内存上限 = 物理内存上限 x yarn.nodemanager.vmem-pmem-ratio(默认是2.1)

通过设置两个开关可以关闭检查,但注意要设置到NodeManager上:

<property>

<name>yarn.nodemanager.pmem-check-enabled </name>

<value>false</value>

<description>Whether physical memory limits will be enforced for containers.</description>

</property>

# 虚拟内存检查

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

<description>Whether virtual memory limits will be enforced for containers.</description>

</property>还有一种情况跟spark自身内存设置有关系,参考:

https://www.jianshu.com/p/ceee2d5990f8 Spark on Yarn 为什么出现内存超界container被kill

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?