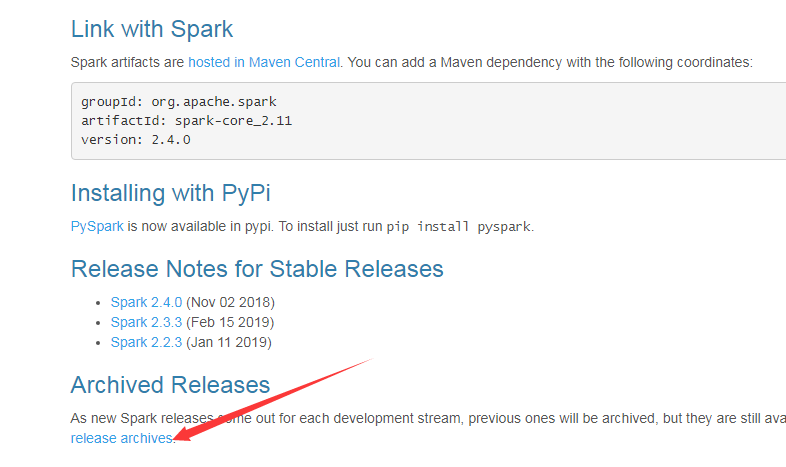

下载

http://spark.apache.org/downloads.html

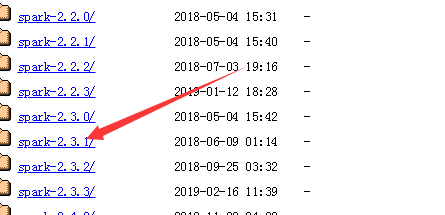

下载2.3.1

https://blog.csdn.net/qq_15349687/article/details/82748074(齐全)

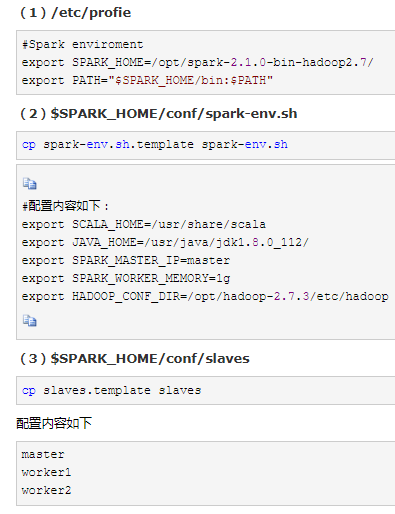

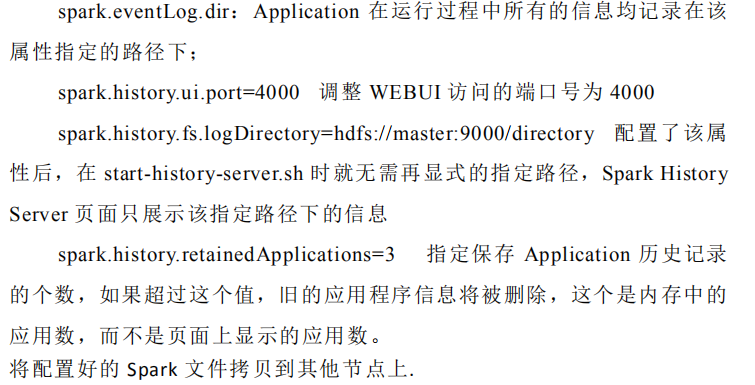

配置文件

https://www.cnblogs.com/purstar/p/6293605.html

https://www.cnblogs.com/swordfall/p/7903678.html(配置明了)

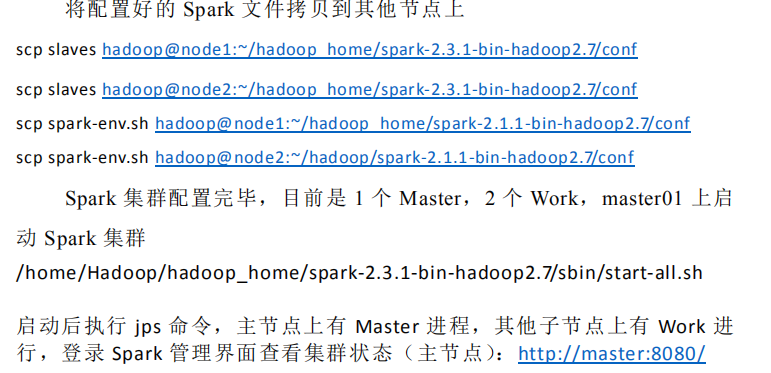

把上面相对应的路径和名字改为自己的即可,

配置环境变量bin和sbin

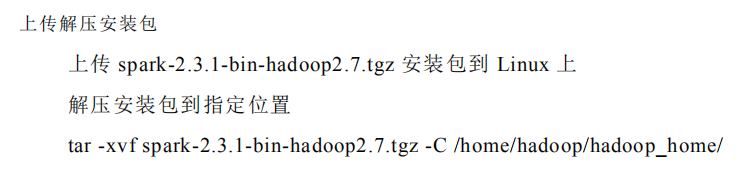

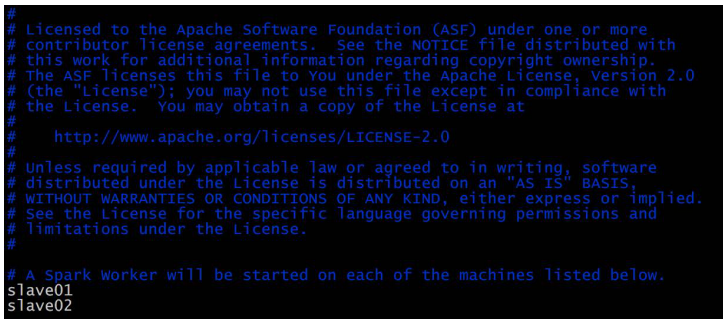

cp slaves.properties slaves

slaves里

node1

node2

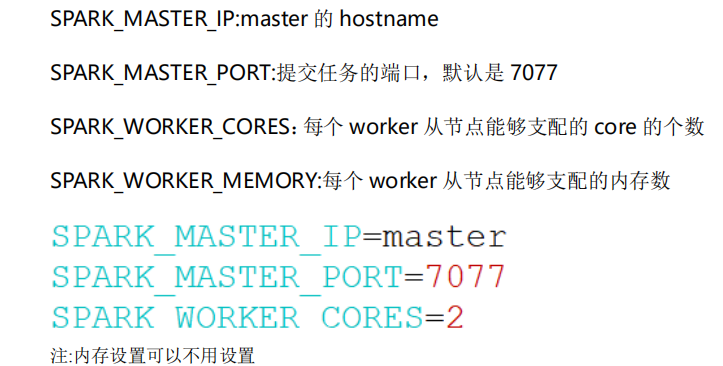

cp spark-env.sh.properties spark-env.sh

hadoop_conf_dir=/home/hadoop/hadoop_home/etc/hadoop

上面不详细,详细如下

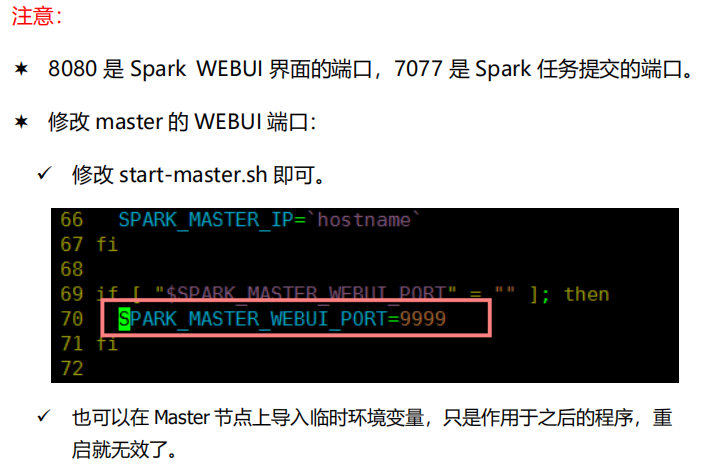

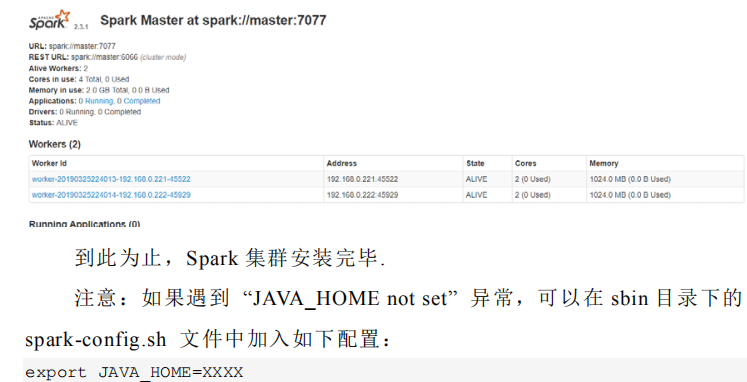

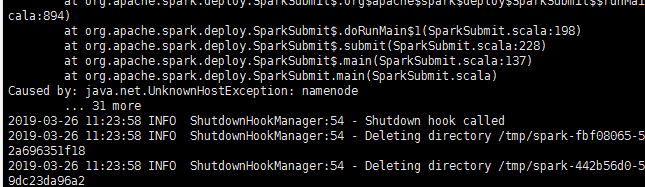

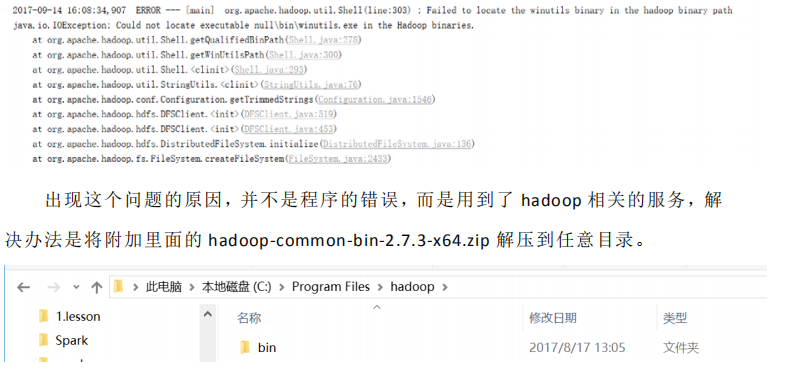

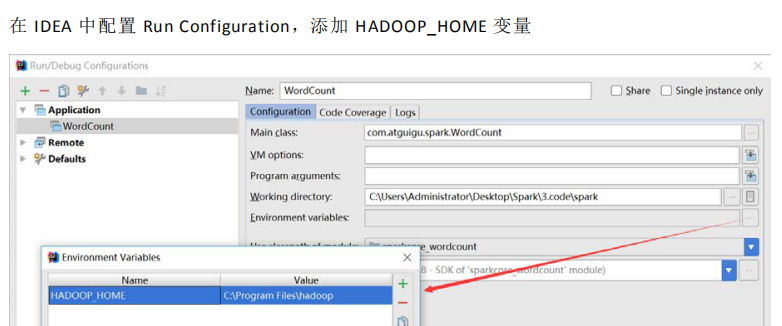

报错

检查得知端口有误

(因本人在配置时直接把spark-default.xml文件里的内容取消注释,而忘记修改,不是master:9000)

108

108

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?