1. SparkShuffle概念

Shuffle描述着数据从map task输出到reduce task输入的这段过程。

一般将在map端的Shuffle称之为Shuffle Write,在Reduce端的Shuffle称之为Shuffle Read.

shuffle的性能高低直接影响了整个程序的性能和吞吐量。

问题:聚合之前,每一个key对应的value不一定都是在一个partition中,也不太可能在同一个节点上,因为RDD是分布式的弹性的数据集,RDD的partition极有可能分布在各个节点上。

如何聚合?

– Shuffle Write:上一个stage的每个map task就必须保证将自己处理的当前分区的数据相同的key写入一个分区文件中,可能会写入多个不同的分区文件中。

– Shuffle Read:reduce task就会从上一个stage的所有task所在的机器上寻找属于己的那些分区文件,这样就可以保证每一个key所对应的value都会汇聚到同一个节点上去处理和聚合。

Spark中有两种Shuffle类型,HashShuffle和SortShuffle,

Spark1.2之前是HashShuffle,

Spark1.2引入SortShuffle 。

Spark2.0就只有sortshuffle

2. HashShuffle

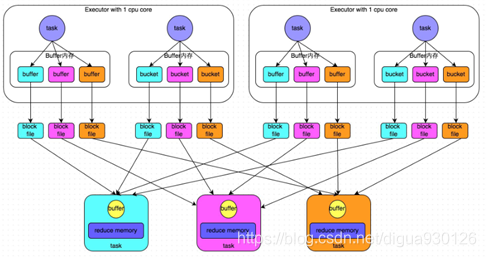

1) 普通机制

-

普通机制示意图

-

执行流程

a) 每一个map task将不同结果写到不同的buffer中,每个buffer的大小为32K。buffer起到数据缓存的作用。

b) 每个buffer文件最后对应一个磁盘小文件。

c) reduce task来拉取对应的磁盘小文件。 -

总结

① .map task的计算结果会根据分区器(默认是hashPartitioner)来决定写入到哪一个磁盘小文件中去。ReduceTask会去Map端拉取相应的磁盘小文件。

② .产生的磁盘小文件的个数:

M(map task的个数)*R(reduce task的个数) -

存在的问题

产生的磁盘小文件过多,会导致以下问题:- a) 在Shuffle Write过程中会产生很多写磁盘小文件的对象。

- b) 在Shuffle Read过程中会产生很多读取磁盘小文件的对象。

- c) 在JVM堆内存中对象过多会造成频繁的gc,gc还无法解决运行所需要的内存 的话,就会OOM。

- d) 在数据传输过程中会有频繁的网络通信,频繁的网络通信出现通信故障的可能性大大增加,一旦网络通信出现了故障会导致shuffle file cannot find 由于这个错误导致的task失败,TaskScheduler不负责重试,由DAGScheduler负责重试Stage。

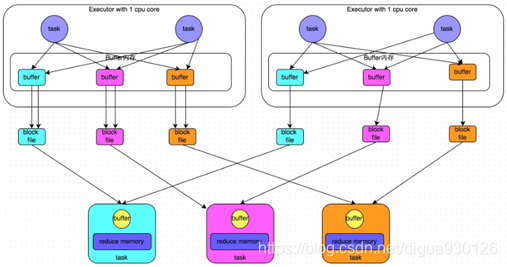

2) 合并机制

- 合并机制示意图

- 总结

产生磁盘小文件的个数:C(core的个数)*R(reduce的个数)

3. SortShuffle

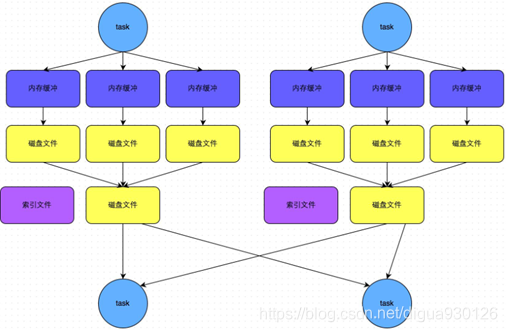

1) 普通机制

- 普通机制示意图

- 执行流程

a) map task 的计算结果会写入到一个内存数据结构里面,内存数据结构默认是5M

b) 在shuffle的时候会有一个定时器,不定期的去估算这个内存结构的大小,当内存结构中的数据超过5M时,比如现在内存结构中的数据为5.01M,那么他会申请5.01*2-5=5.02M内存给内存数据结构。

c) 如果申请成功不会进行溢写,如果申请不成功,这时候会发生溢写磁盘。

d) 在溢写之前内存结构中的数据会进行排序分区

e) 然后开始溢写磁盘,写磁盘是以batch的形式去写,一个batch是1万条数据,

f) map task执行完成后,会将这些磁盘小文件合并成一个大的磁盘文件,同时生成一个索引文件。

g) reduce task去map端拉取数据的时候,首先解析索引文件,根据索引文件再去拉取对应的数据。 - 总结

产生磁盘小文件的个数: 2*M(map task的个数)

2) bypass机制

-

bypass机制示意图

-

总结

① .bypass运行机制的触发条件如下:- shuffle reduce task的数量小于spark.shuffle.sort.bypassMergeThreshold的参数值。这个值默认是200。

- 不需要进行map端的预聚合,比如groupBykey,join.

② .产生的磁盘小文件为:2*M(map task的个数)

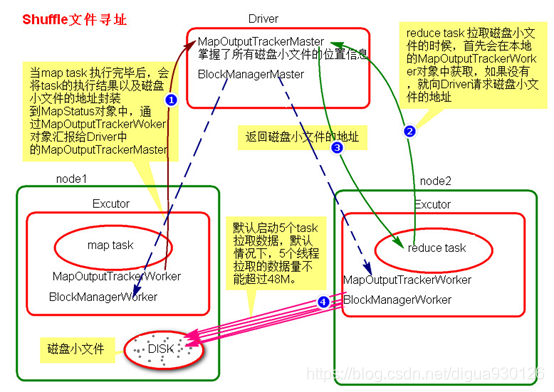

4. Shuffle文件寻址

1) MapOutputTracker

MapOutputTracker是Spark架构中的一个模块,是一个主从架构。管理磁盘小文件的地址。

- MapOutputTrackerMaster是主对象,存在于Driver中。

- MapOutputTrackerWorker是从对象,存在于Excutor中。

2) BlockManager

BlockManager块管理者,是Spark架构中的一个模块,也是一个主从架构。

- BlockManagerMaster,主对象,存在于Driver中。

BlockManagerMaster会在集群中有用到广播变量和缓存数据或者删除缓存数据的时候,通知BlockManagerSlave传输或者删除数据。 - BlockManagerWorker,从对象,存在于Excutor中。

BlockManagerWorker会与BlockManagerWorker之间通信。 - 无论在Driver端的BlockManager还是在Excutor端的BlockManager都含有四个对象:

① DiskStore:负责磁盘的管理。

② MemoryStore:负责内存的管理。

③ ConnectionManager:负责连接其他的

BlockManagerWorker。

④ BlockTransferService:负责数据的传输。

3) Shuffle文件寻址图

4) Shuffle文件寻址流程

- a) 当map task执行完成后,会将task的执行情况和磁盘小文件的地址封装到MapStatus对象中,通过MapOutputTrackerWorker对象向Driver中的MapOutputTrackerMaster汇报。

- b) 在所有的map task执行完毕后,Driver中就掌握了所有的磁盘小文件的地址。

- c) 在reduce task执行之前,会通过Excutor中MapOutPutTrackerWorker向Driver端的MapOutputTrackerMaster获取磁盘小文件的地址。

- d) 获取到磁盘小文件的地址后,会通过BlockManager中的ConnectionManager连接数据所在节点上的ConnectionManager,然后通过BlockTransferService进行数据的传输。

- e) BlockTransferService默认启动5个task去节点拉取数据。默认情况下,5个task拉取数据量不能超过48M。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?