机器学习

机器学习三个部分:编程能力+数学统计知识+业务知识

机器学习分类

1 监督学习:例如分类、房价预测

2 无监督学习:例如聚类

3 强化学习:例如动态系统、机器人控制系统

机器学习算法

| 是否连续 | 无监督 | 有监督 |

|---|---|---|

| 连续 | 聚类 && 降维 | 回归 |

| PCA | 线性回归/多项式回归 | |

| SVD | 决策树 | |

| K-means | 随机森林 | |

| 不连续 | 隐马尔科夫 | 分类 |

| 相关性分析 | KNN/Trees | |

| FP-Growth/Apriori | 逻辑回归/朴素贝叶斯/SVM |

机器学习一般思路

分析得到多个特征:高、富、帅、潜等;

观察多个数据得到每个数据的每个特征值;

设计得分函数;

设计损失函数;

损失函数最小化,求得特征权重;

根据得分函数,对新数据预测。

微积分

微积分用于求损失函数的最小值。

1 夹逼定理

2 导数

导数定义与意义:导数是曲线的斜率;二阶导数是斜率变化快慢的反应。

常用函数的导数

3泰勒公式

4方向导数与梯度

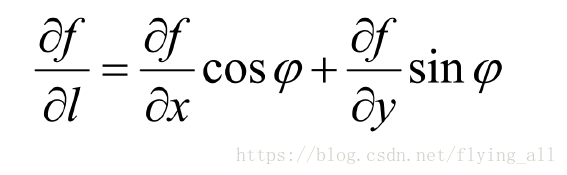

方向导数:是标量

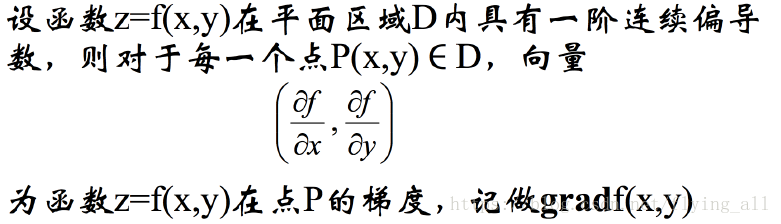

梯度:是有方向的,是一个向量;是f函数对坐标轴求偏导得到的。

梯度的方向是函数在该点增长最快的方向。

5梯度下降法

在损失函数最小值计算中用到。

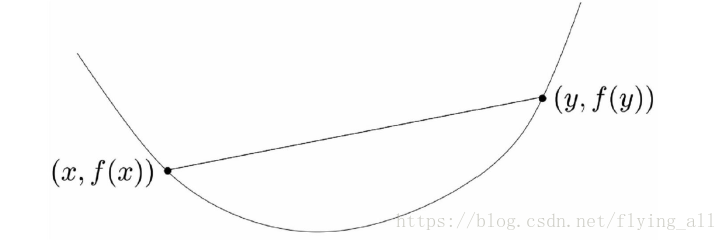

6凸函数

凸函数的定义:

∀x,y∈dom,0<θ<1,

∀

x

,

y

∈

d

o

m

,

0

<

θ

<

1

,

有

f(θx+(1−θ)y)<=θf(x)+(1−θ)f(x)

f

(

θ

x

+

(

1

−

θ

)

y

)

<=

θ

f

(

x

)

+

(

1

−

θ

)

f

(

x

)

凸函数判定依据:

二阶导数>=0

二

阶

导

数

>

=

0

,f(x)是凸的。

概率与数理统计

1概率公式

条件概率:

全概率公式:

贝叶斯公式:

2常见概率分布

3概率与统计的区别

概率:已知总体,已知概率分布参数,求某种情况发生的概率。已知总体,求抽样(某事件)发生的概率。

数理统计:已知总体分布,但不知道具体参数,从抽样数据中推出总体参数。

在有监督的机器学习中,已知数据,求得权重的过程是数理统计的过程:从样本推出总体参数;这是机器学习的训练过程。

在有监督的机器学习中,已知数据和权重,求得标签的过程是概率:已知总体,求抽样发生的概率;这是机器学习的预测过程。

4 根据各个分布特性评估模型和样本

观察已有数据的标签分布、每个特征的分布;评估了分布后,大致可以得到某些特征和标签的相关性较强,某些特征和标签的相关性较弱。

统计估计的是分布,机器学习训练出来的是模型。模型可能包含了多个分布。

模型是有误差的。误差本身可以是概率的形式。

5 常见统计量

期望

方差

协方差:可以评价特征与标签的相关性;用于特征选择

相关系数

线性代数

A.x的含义

SVD的几何意义

矩阵乘法

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?