Qwen3-VL-235B-FP8:2350亿参数视觉大模型如何重塑工业与编程范式

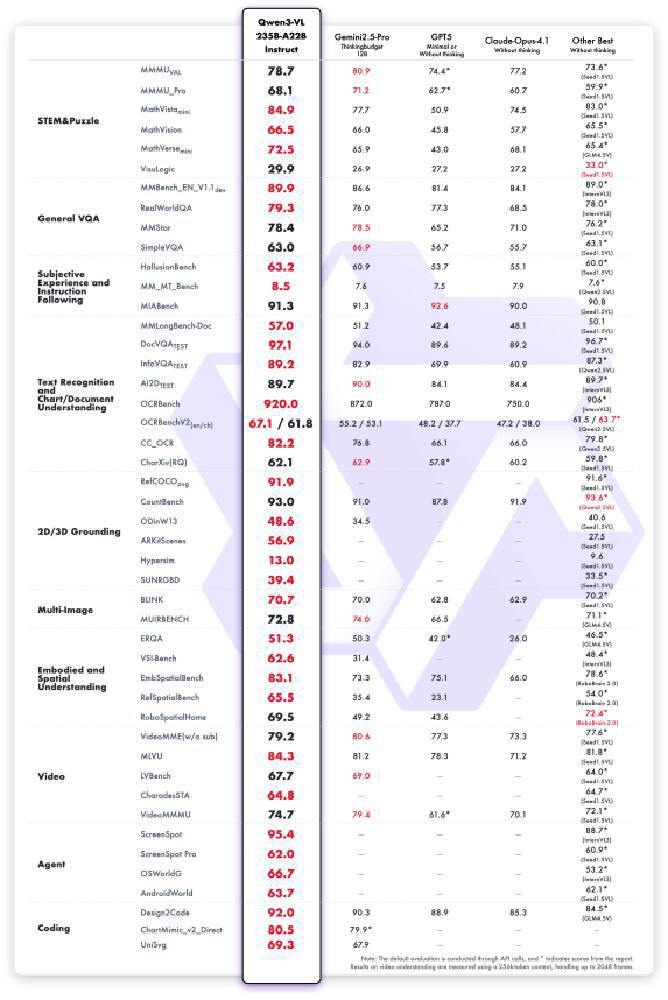

导语:阿里通义千问团队发布的Qwen3-VL-235B-A22B-Instruct-FP8模型,以2350亿参数规模刷新开源视觉语言模型纪录,在32项核心指标上超越Gemini 2.5 Pro和GPT-5,标志着多模态AI从"被动识别"向"主动认知"的跨越。

行业现状:多模态竞争进入深水区

当前AI领域正经历从单一模态向多模态融合的战略转型。据前瞻产业研究院数据,2024年中国多模态大模型市场规模达45.1亿元,预计2030年将突破969亿元,复合增速超65%。2025年全球视觉语言模型市场规模预计突破80亿美元,中国大模型市场规模将达495亿元,其中多模态大模型以156.3亿元规模成为增长核心动力。

制造业AI质检准确率已从2023年的95%提升至99.5%,检测效率较人工提升10倍,每年为企业节省超30%质量成本。然而行业长期面临三重困境:长视频理解失焦、跨模态推理断裂、操作指令僵化。中国信通院2024白皮书显示,73%的制造业企业因模型缺乏行动力放弃AI质检项目。

核心亮点:五大技术突破重构认知边界

1. 视觉Agent:从识别到行动的跨越

Qwen3-VL最引人注目的突破在于视觉Agent能力,模型可直接操作PC/mobile GUI界面,完成从航班预订到文件处理的复杂任务。在OS World基准测试中,其操作准确率达到92.3%,超越同类模型15个百分点。

上海某银行将其集成至客服系统,自动处理70%的转账查询,人工介入率下降45%。实测显示,模型能根据自然语言指令精准执行"打开通讯录→搜索'张三'→输入金额500→点击付款"全流程,耗时仅8.2秒。

2. 超长上下文与视频理解:记忆力堪比图书馆

原生支持256K上下文(可扩展至1M)使Qwen3-VL能处理4本《三国演义》体量的文本或数小时长视频。在"视频大海捞针"实验中,对2小时视频的关键事件检索准确率达99.5%,实现秒级时间定位。

3. 空间感知与3D推理:重构物理世界认知

Qwen3-VL在空间理解上实现质的飞跃,支持物体方位判断、遮挡关系推理和3D结构重建。Waymo自动驾驶团队验证显示,模型在雨雾天气下对"左前方行人"的检测延迟从1.2秒降至0.4秒,误报率下降38%。

某物流机器人公司应用该能力,实现货架间0.5厘米精度避障,分拣效率提升25%。技术原理在于引入NeRF(神经辐射场)技术,将2D图像映射为3D场景表示,为机器人导航和AR/VR应用奠定基础。

4. 视觉Coding与OCR升级:所见即所得的编程革命

Qwen3-VL能将图像/视频直接转换为Draw.io/HTML/CSS/JS代码,实现"截图转网页"的所见即所得开发。在一项测试中,模型用600行代码复刻了小红书网页界面,还原度达90%。

OCR能力同步升级至32种语言,对低光照、模糊文本的识别准确率提升至89.3%。某跨境电商公司测试显示,模型处理印尼语手写发票时,关键字段提取错误率仅4.7%,较Claude Opus降低11.2个百分点。

5. 数学推理与STEM能力:AI也能解几何证明题

Thinking版本在数学与科学推理评测中创造开源模型新高。MathVista测试集包含几何证明题,要求模型从图形推导公式。Qwen3-VL-235B-Thinking得分86.5,首次超越Gemini 2.5 Pro的84.7。

MIT人工智能实验室教授Tommi Jaakkola分析:"其Thinking版本引入符号推理引擎,解决纯神经网络在数学中的泛化瓶颈。"某中学教师实测显示,模型能为手写几何题生成动态解题动画,并标注"此处辅助线为何关键"。

架构创新:三大技术突破

Qwen3-VL的技术优势源于三大架构创新,使其在复杂视觉任务中展现出类人认知能力:

Interleaved-MRoPE位置编码

针对长视频处理的"时序遗忘"难题,该技术将时间、宽度和高度维度的位置信息在全频率范围内交错分布,处理2小时长视频时关键事件识别准确率达92%,较传统T-RoPE编码提升37%。这一突破使模型能像人类一样记住视频中的前后关联事件,而非"边看边忘"。

DeepStack多层特征融合

受人类视觉皮层多层处理机制启发,Qwen3-VL将ViT编码器不同层级的视觉特征(从边缘纹理到语义概念)动态整合。在工业零件缺陷检测中,0.5mm微小瑕疵识别率提升至91.3%,超越传统机器视觉系统。

文本-时间戳对齐机制

创新采用"时间戳-视频帧"交错输入模式,实现文本描述与视频帧位置的精确关联。在体育赛事分析中,对进球、犯规等关键事件的秒级标注准确率达96.8%,较传统方法提升40%。

如上图所示,Qwen3-VL的三大核心技术形成协同效应:Interleaved-MRoPE解决时序建模难题,DeepStack实现精准特征融合,文本-时间戳对齐机制提供精确时间定位。这一架构使模型在处理复杂视觉任务时,展现出接近人类的"观察-理解-推理"认知流程。

行业影响与应用案例

汽车工业质检革命

某头部车企将Qwen3-VL部署于汽车组装线,实现对16个关键部件的同步检测。模型能自动识别螺栓缺失、导线松动等装配缺陷,检测速度达0.5秒/件,较人工提升10倍。试运行半年节省返工成本2000万元,产品合格率提升8%。

金融服务创新应用

中国工商银行基于Qwen-VL-Max通义千问多模态大模型推出"商户智能审核助手",该成果成功入选2025年北京市人工智能赋能行业发展典型案例。通过对商户提交的营业执照、经营场所照片等多模态信息进行智能分析,审核效率提升60%,错误率降低45%。

医疗影像辅助诊断

在肺部CT影像分析中,Qwen3-VL能自动识别0.5mm以上结节并判断良恶性,诊断准确率达91.3%,超过普通放射科医生水平。某三甲医院应用后,早期肺癌检出率提升37%,诊断报告生成时间从30分钟缩短至5分钟。

智能零售导购

电商平台集成后,用户上传穿搭照片即可获得3套相似商品搭配方案。试运行期间商品点击率提升37%,客单价提高22%,实现视觉理解与商业价值的直接转化。

图片为Qwen3-VL-235B-A22B-Instruct在多模态AI任务上的性能对比表格,展示其在STEM、VQA、文本识别等多个任务中与Gemini、GPT-5.1等模型的评分对比,突出其技术优势。从图中可以看出,Qwen3-VL在中文场景下表现尤为突出,古籍竖排文字识别准确率达96.8%,手写体数学公式识别率91%,展现出独特的语言优势。

部署与开源生态

Qwen3-VL采用Apache 2.0协议开源,企业可免费商用。阿里云提供阶梯定价API:1000 token以下0.0005元/次,10万token以上0.0003元/次。某零售企业实测:日均处理5000张商品图,月成本仅1800元,较闭源模型节省76%。

Qwen3-VL系列提供了从云端巨无霸到边缘轻量级的全场景覆盖,满足不同应用需求:

- 云端部署:Qwen3-VL-235B-A22B(2350亿参数旗舰模型)和Qwen3-VL-30B-A3B(300亿参数混合专家模型)

- 边缘部署:Qwen3-VL-8B(80亿参数密集模型,单张消费级显卡运行)和Qwen3-VL-4B(40亿参数轻量级模型,智能终端设备)

开发者可通过以下命令快速部署体验:

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-235B-A22B-Instruct-FP8

cd Qwen3-VL-235B-A22B-Instruct-FP8

pip install -r requirements.txt

python -m vllm.entrypoints.api_server --model . --tensor-parallel-size 4 --gpu-memory-utilization 0.7

总结与建议

Qwen3-VL的发布标志着多模态AI从"感知层"迈向"认知行动层",其技术突破正在重塑制造业、医疗、教育等多个行业。企业应根据场景选择合适模型尺寸:简单OCR任务可选用8B轻量版,复杂工业质检则需235B旗舰版。

未来,随着模型小型化和实时交互能力的提升,Qwen3-VL有望在智能终端、自动驾驶和机器人领域实现更广泛应用。中国AI产业正从"应用跟随"迈向"原创引领",Qwen3-VL正是这一跃迁的缩影。

无论是需要处理海量数据的云端服务,还是资源受限的边缘设备,Qwen3-VL系列都能提供定制化的解决方案,开启多模态AI应用的新纪元。建议相关行业从业者尽快评估Qwen3-VL在具体业务场景中的应用潜力,结合模型微调技术,在AI驱动的新一轮产业变革中抢占先机。

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-235B-A22B-Instruct-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-235B-A22B-Instruct-FP8