Heritrix项目介绍

Heritrix工程始于2003年初,IA的目的是开发一个特殊的爬虫,对网上的资源进行归档,建立网络数字图书馆。在过去的6年里,IA已经建立了400TB的数据。 IA期望他们的crawler包含以下几种:

- 宽带爬虫:能够以更高的带宽去站点爬。

- 主题爬虫:集中于被选择的问题。

- 持续爬虫:不仅仅爬更当前的网页还负责爬日后更新的网页。

- 实验爬虫:对爬虫技术进行实验,以决定该爬什么,以及对不同协议的爬虫 爬行结果进行分析的。

Heritrix工作原理

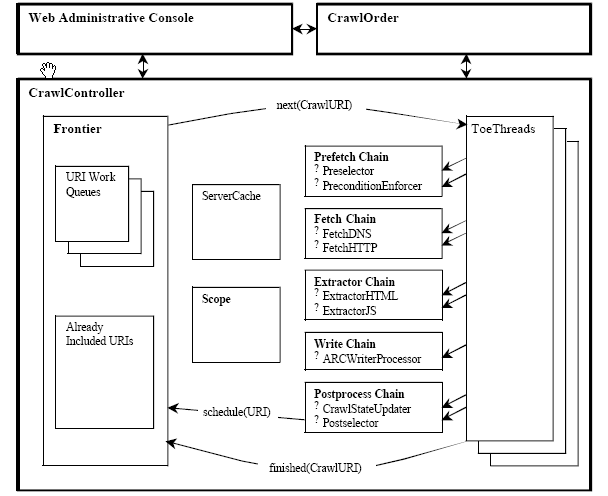

Heritrix是一个爬虫框架,可加如入一些可互换的组件。它的执行是递归进行的,主要有以下几步:

- 在预定的URI中选择一个。

- 获取URI

- 分析,归档结果

- 选择已经发现的感兴趣的URI。加入预定队列。

- 标记已经处理过的URI

- Heritrix主要有三大部件:范围部件,边界部件,处理器链

- 范围部件:主要按照规则决定将哪个URI入队。

- 边界部件:跟踪哪个预定的URI将被收集,和已经被收集的URI,选择下一个 URI,剔除已经处理过的URI。

- 处理器链:包含若干处理器获取URI,分析结果,将它们传回给边界部件

-

Heritrix的其余部件有:

- WEB管理控制台:大多数都是单机的WEB应用,内嵌JAVA HTTP 服务器。 操作者可以通过选择Crawler命令来操作控制台。

- Crawler命令处理部件:包含足够的信息创建要爬的URI。

- Servercache(处理器缓存):存放服务器的持久信息,能够被爬行部件随时查到,包括IP地址,历史记录,机器人策略。

-

处理器链:

- 预取链:主要是做一些准备工作,例如,对处理进行延迟和重新处理,否决随后的操作。

- 提取链:主要是获得资源,进行DNS转换,填写请求和响应表单

- 抽取链:当提取完成时,抽取感兴趣的HTML,JavaScript,通常那里有新的也适合的URI,此时URI仅仅被发现,不会被评估

- 写链:存储爬行结果,返回内容和抽取特性,过滤完存储。

- 提交链:做最后的维护,例如,测试那些不在范围内的,提交给边 界部件

-

Heritrix 1.0.0包含以下关键特性:

- 用单个爬虫在多个独立的站点一直不断的进行递归的爬。

- 从一个提供的种子进行爬,收集站点内的精确URI,和精确主机。

- 主要是用广度优先算法进行处理。

- 主要部件都是高效的可扩展的

- 良好的配置,包括:

- 可设置输出日志,归档文件和临时文件的位置

- 可设置下载的最大字节,最大数量的下载文档,和最大的下载时间。

- 可设置工作线程数量。

- 可设置所利用的带宽的上界。

- 可在设置之后一定时间重新选择。

- 包含一些可设置的过滤机制,表达方式,URI路径深度选 择等等。

Heritrix的局限

- 单实例的爬虫,之间不能进行合作。

- 在有限的机器资源的情况下,却要复杂的操作。

- 只有官方支持,仅仅在Linux上进行了测试。

- 每个爬虫是单独进行工作的,没有对更新进行修订。

- 在硬件和系统失败时,恢复能力很差。

- 很少的时间用来优化性能。

爬虫信息

- 爬虫名称: Heritrix

- 爬行强度: 低

- HTTP User Agent:

Mozilla/5.0 (compatible; heritrix/1.10.2 +http://i.stanford.edu/)

- 来访IP:171.64.75.233

对Heritrix爬虫进行控制

Heritrix被设计成严格遵循robots.txt文件的排除指示和META robots标签。

邀请Heritrix来访

如果你在在robots.txt中限制了部分爬虫,那么你可能需要在robots.txt中增加下述内容:

User-agent: Heritrix Disallow:

禁止Heritrix访问

如果你不希望Heritrix爬虫占用服务器资源,可以这样封锁它:

User-agent: Heritrix

Disallow: /

如果你仅仅不希望Heritrix爬行某些目录,则可以这样:

User-agent: Heritrix

Disallow: /somedir/

参考资料

官方网站

http://crawler.archive.org/ 关于Heritrix项目的官方信息

http://i.stanford.edu/ Heritrix爬虫的官方信息

外部链接

Template:5Heritrix Crawler vs. Nutch Crawler http://www.dbanotes.net/web/heritrix_crawler_vs_nutch_crawler.html 书籍

629

629

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?