一、介绍

卷积神经网络是当前深度学习领域比较火的研究方法。其应用主要是在计算机视觉上。例如,图像分类,目标检测,人脸识别等等。并且已经在这些领域取得了相当大的成就。本文主要介绍卷积神经网络的开篇之作:LeNet-5。LeNet-5由Y. LeCun 在1998年发表的文章《Gradient-Based Learning Applied to Document Recognition 》中正式提出。在论文中,应用MNIST手写数字体数据做实验。LeNet并不是1998年才存在的。在1989年Y.LeCun的另一篇文章就已经提到。知识在1998年正式提出。下面,我们就看一下LeNet-5的网络结构。

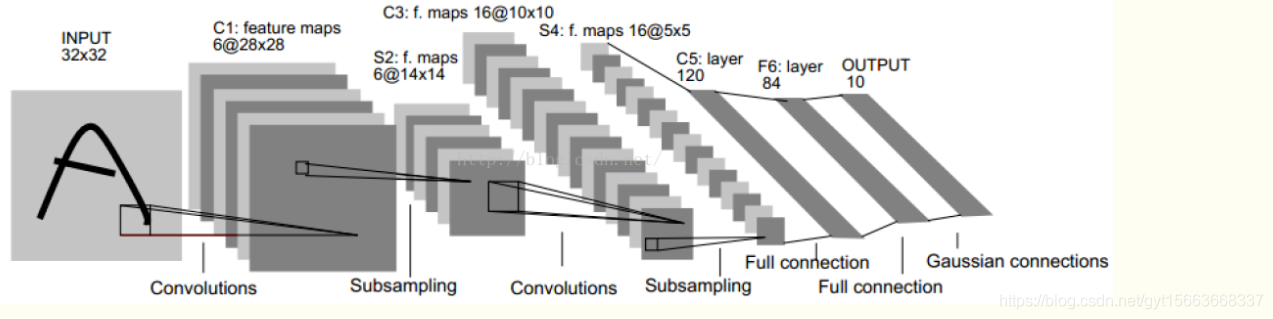

二、模型结构

上图是LeNet-5的网络结构图。该网络一共包含7层,输入时一个

32

×

32

32\times 32

32×32的图像。当我们实际应用这个网络的时候可以根据实际的问题来修改输入尺寸与网络中的结构。

- Layer C1:第一个卷积层,得到6个 28 × 28 28\times28 28×28的特征图。卷积核的大小为 5 × 5 5\times5 5×5。

- Layer S2:下采样层等同于池化层,我们一般使用最大池化操作。得到6个 14 × 14 14\times14 14×14的特征图。设置 2 × 2 2\times2 2×2的过滤器。

- Layer C3:第二个卷积层,得到16个 5 × 5 5\times5 5×5的特征图。卷积核的大小为 5 × 5 5\times5 5×5。

- Layer S4:下采样层等同于池化层。得到16个 5 × 5 5\times5 5×5的特征图。设置 2 × 2 2\times2 2×2的过滤器。

- Layer C5:第三个卷积层,得到120个 1 × 1 1\times1 1×1的特征图。卷积核的大小为 5 × 5 5\times5 5×5。因为S4得到的特征图也是 5 × 5 5\times5 5×5。所以得到的输出是1个数。这步相当于全连接。通常我们直接设置全连接层。

- Layer F6:全连接层,设置84个单元。激活函数可以使用Relu。

- Layer F7:输出层,10个单元。根据问题来决定,因为从0-9一共10类。随意设置为10。激活函数使用softmax。

主要贡献:

- 局部感受野(local receptive fields),局部连接

- 权值共享(参数共享)

- 下采样(sub-sampling),pooling层

三、总结

LeNet-5是一个简单的卷积神经网络,相较于传统的神经网络其参数更少,性能也更优。是卷积神经网络的一个开端。最后的损失函数我们使用了均方差损失函数。如果对神经网络有一定的了解,应该可以了解整个神经网络的运行过程。到这里这篇文章就完事了。我们只是为了来记录LeNet-5的网络结构。并没有细讲网络的具体知识。如有不懂,想深入讨论。可以加我联系方式一起学习。

友情链接:

代码实现:https://github.com/guoyuantao/CNN_Model/tree/master/CNN_on_cifar_ByPytorch

联系方式:2391855138(加好友请备注)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?