经典神经网络

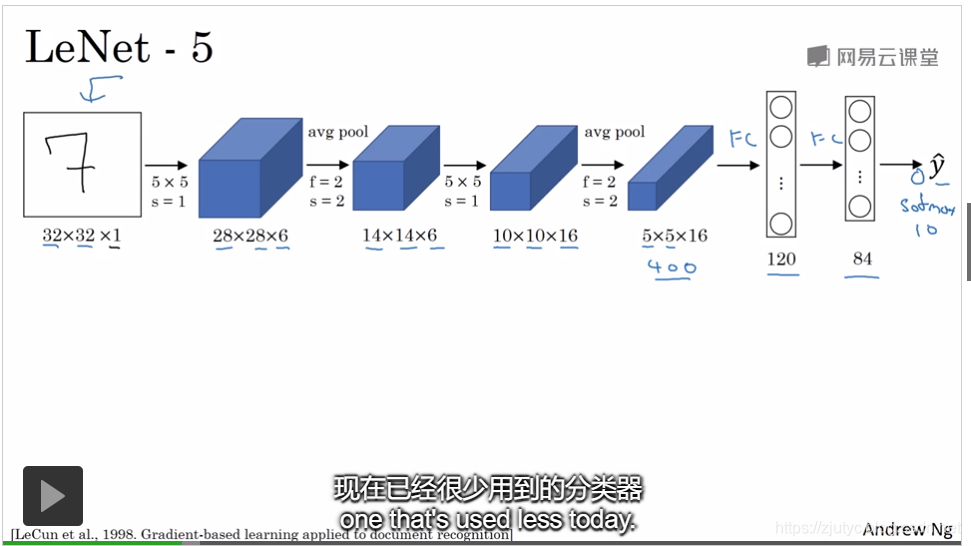

LeNet-5: 手写体数字识别

LeNet-5网络的论文:Lecun et al.,1998 Gradient-based learning applied to document recognition

吴恩达老师建议阅读第二和第三部分

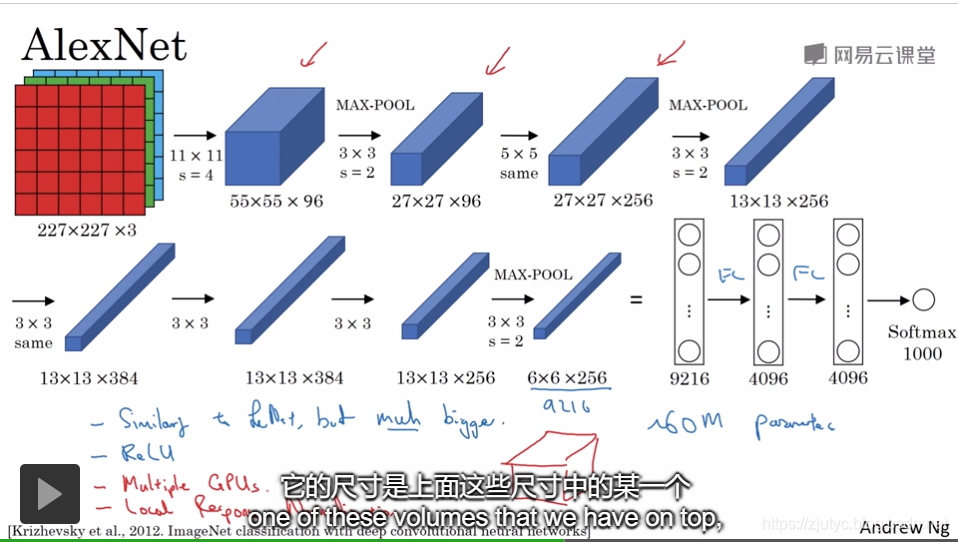

AlexNet

说明:

- 上图为AlexNet的神经网络结构

- 如图所示,通过5x5卷积核以stride=2进行卷积运算后,输入特征由27x27x96得到输出特征27x27x256,根据笔记一中公式可以推得:该处进行了padding操作,且padding的大小经过计算为15。

- 该网络需要训练的参数大约为60 million

- 根据吴恩达老师所说,改网络提出来的时候GPU的运算速度相对来说比较慢,所以Alex想了一种复杂的方法将不同的层拆分到在不同的GPU上进行训练,然后通过某种方法用于GPU之间的数据交换,从而提升训练速度,具体情况可以查询相关资料进行了解。

- 相比于LeNet-5,该网络使用RELU函数作为激活函数。

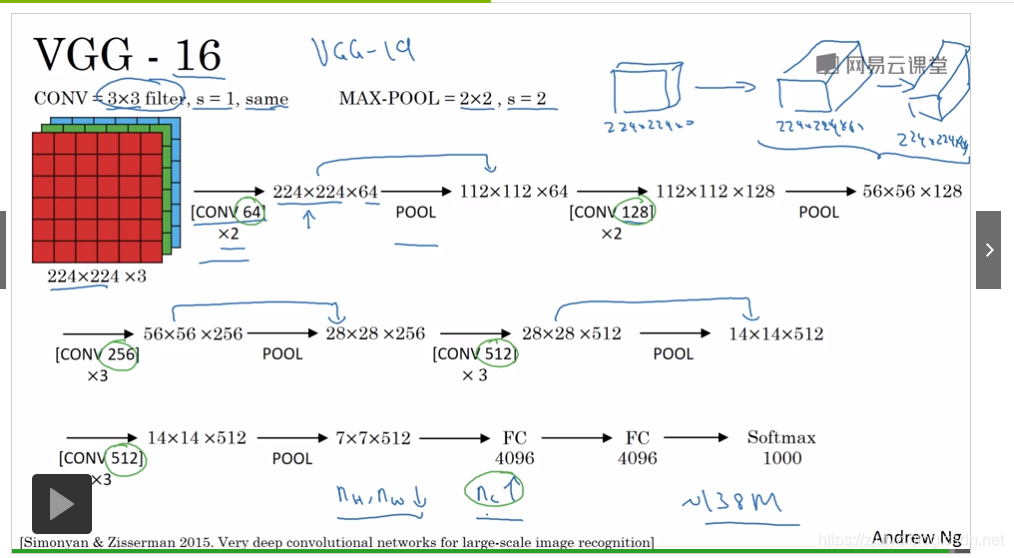

VGG-16:专注于构建卷积层的网络

说明:

- 卷积核的选择如图所示:3x3,stride=1,padding is same as stride,so it’s 1; 池化单元的信息:2x2,stride=2

- [CONV 64]表示有64个卷积核核输入特征图进行卷积计算,x2表示,该卷积计算进行了两次,具体计算过程如由上图所示

- 如图网络结构所示:经过padding的卷积计算使得输出特征单元与输入特征单元具有相同的大小,经过池化单元使得输出特征单元的大小为输入特征单元的一半

- 由图观察可知,通道数在每次卷积过程中都成倍增加

- 该网络的训练参数为138 million

- 其他需要了解请搜索左下角文献:Very deep convolutional networks for large-scale image recognition

9272

9272

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?