作者:徐瑞龙,量化分析师

博客专栏:

https://www.cnblogs.com/xuruilong100

前文推送:

时间序列预测是一类比较困难的预测问题。

与常见的回归预测模型不同,输入变量之间的“序列依赖性”为时间序列问题增加了复杂度。

一种能够专门用来处理序列依赖性的神经网络被称为 递归神经网络(Recurrent Neural Networks、RNN)。因其训练时的出色性能,长短记忆网络(Long Short-Term Memory Network,LSTM)是深度学习中广泛使用的一种递归神经网络(RNN)。

在本篇文章中,将介绍如何在 R 中使用 keras 深度学习包构建 LSTM 神经网络模型实现时间序列预测。

文章的主要内容:

如何为基于回归、窗口法和时间步的时间序列预测问题建立对应的 LSTM 网络。

对于非常长的序列,如何在构建 LSTM 网络和用 LSTM 网络做预测时保持网络关于序列的状态(记忆)。

问题描述

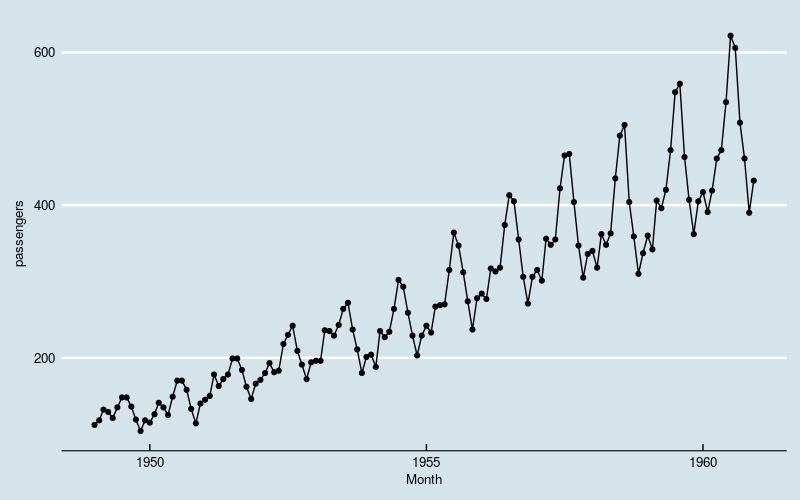

“航班旅客数据”是一个常用的时间序列数据集,该数据包含了 1949 至 1960 年 12 年间的月度旅客数据,共有 144 个观测值。

下载链接:international-airline-passengers.csv

长短记忆网络

长短记忆网络,或 LSTM 网络,是一种递归神经网络(RNN),通过训练时在“时间上的反向传播”来克服梯度消失问题。

LSTM 网络可以用来构建大规模的递归神经网络来处理机器学习中复杂的序列问题,并取得不错的结果。

除了神经元之外,LSTM 网络在神经网络层级(layers)之间还存在记忆模块。

一个记忆模块具有特殊的构成,使它比传统的神经元更“聪明”,并且可以对序列中的前后部分产生记忆。模块具有不同的“门”(gates)来控制模块的状态和输出。一旦接收并处理一个输入序列,模块中的各个门便使用 S 型的激活单元来控制自身是否被激活,从而改变模块状态并向模块添加信息(记忆)。

一个激活单元有三种门:

遗忘门(Forget Gate):决定抛弃哪些信息。

输入门(Input Gate):决定输入中的哪些值用来更新记忆状态。

输出门(Output Gate):根据输入和记忆状态决定输出的值。

每一个激活单元就像是一个迷你状态机,单元中各个门的权重通过训练获得。

LSTM 网络回归

时间序列预测中最简单的思路之一便是寻找当前和过去数据 与未来数据

与未来数据

之间的关系,这种关系通常会表示成为一个回归问题。

下面着手将时间序列预测问题表示成一个回归问题,并建立 LSTM 网络用于预测,用 t-1 月的数据预测 t 月的数据。

首先,加载相关 R 包。

library(keras)

library(dplyr)

library(ggplot2)

library(ggthemes)

library(lubridate)神经网络模型在训练时存在一定的随机性,所以要为计算统一随机数环境。

set.seed(7)画出整体数据的曲线图,对问题有一个直观的认识。

dataframe <- read.csv(

'international-airline-passengers.csv')

dataframe$Month <- paste0(dataframe$Month,'-01') %>%

ymd()

ggplot(

data = dataframe,

mapping = aes(

x = Month,

y = passengers)) +

geom_line() +

geom_point() +

theme_economist() +

scale_color_economist()

图1

数据体现出“季节性”,同时存在线性增长和波动水平增大的趋势。

<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

560

560

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?