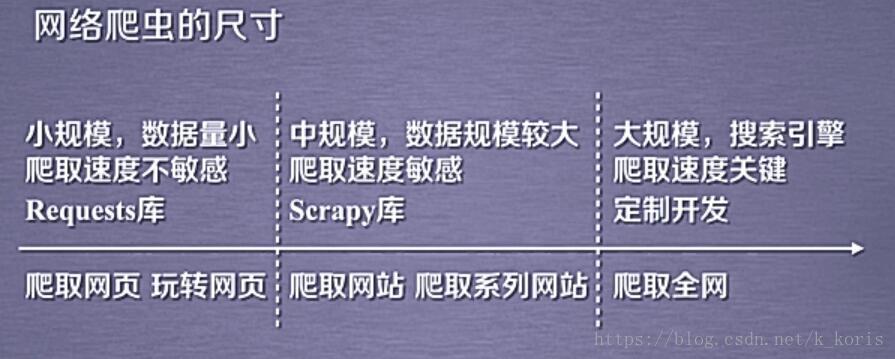

网络爬虫的尺寸大致分为3种:

而第一种大致占到了90%。由于网络爬虫的存在,服务器会因为网络爬虫造成很大的资源开销,比如一个普通人一定时间内访问上十次,而爬虫可能会访问十万次或者百万次。如果一个服务器性能较差,可能会承受不来这个规模的访问。因此网络上对爬虫有一定的制约,对于一些不友好的爬虫,甚至可能会涉及到触犯到法律。

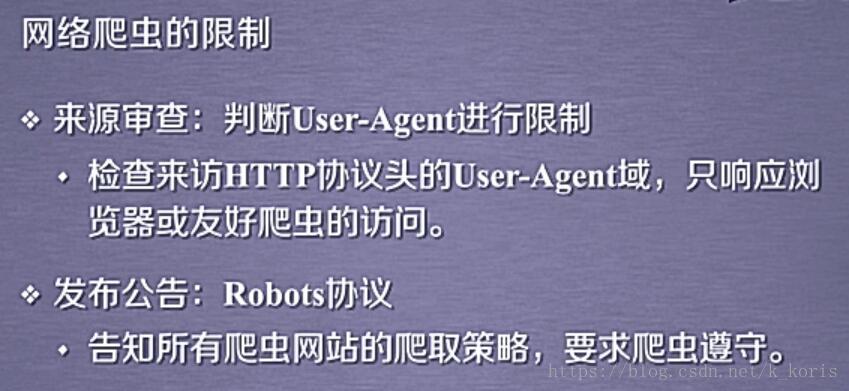

现在一般的网站都会对爬虫做出限制,大致分为两种:

现在说一下第二种,Robots(Robots Exclusion Standard )协议,也叫机器人协议。

作用:告知爬虫网页上哪些内容可以爬取,哪些不行。

形式:在网站根目录下放置robots.txt文件。

比如我们用代码去获取京东的robots协议:

imp

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1126

1126

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?