本文将介绍 ComfyUI 的主要界面,包括:工作流区域、操作面板、基础操作和快捷键,并详细介绍了文生图工作流的各节点的作用及连接。

文章内容包含大量的图例,希望能够帮助新手同学快速入门。

一、界面介绍

ComfyUI 的界面主要由工作流绘制区域和右侧的操作面板组成。

1.1 工作流区域

工作流绘制区域是 ComfyUI 的主要界面,用于节点的添加、编辑、删除和连接。

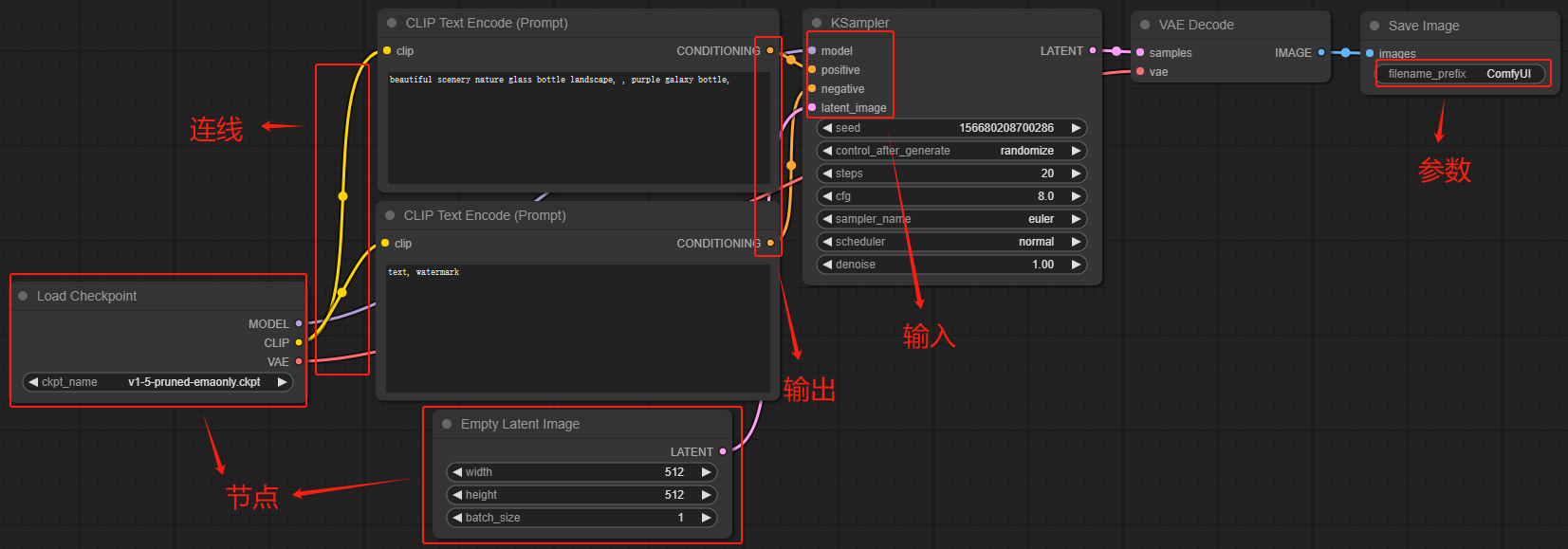

一个工作流主要由以下部分组织:

- 节点(Node):节点是工作流的主要组成部分,它是一个个的矩形块,例如:Load Checkpoint(加载检测点)、CLIP Text Encode(提示词编码器)、KSampler(采样器)、VAE Decode(VAE解码器)、Save Image(保存图片)等。

- 连线(Edge):连线用于表示连接节点的输入和输出的线。

- 输入(Input):输入为节点左侧的文本和点,是连接的输入端。

- 输出(Output):输出为节点右侧的文本和点,是连接的输出端。

- 参数(Parameter):参数用于设置节点中的字段,例如:ckpt_name(模型名称)、prompt(提示词)、seed(随机种子)等。

下图标记了一部分说明:

1.2 操作面板

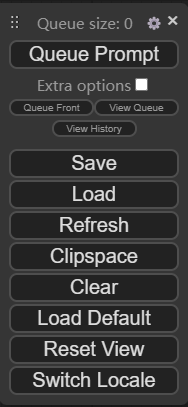

操作面板用于工作流的执行、保存、清空、加载、设置等操作。

操作面板各按钮功能介绍:

- Queue Prompt(提示词队列):当我们配置好工作流后,可以点击此按钮来加入队列并执行。

- Queue size(队列大小):下面执行+待执行的队列数。

- Extra options(扩展选项):用于设置批次数量和自动执行选项。

- Queue Front(执行队列):用于执行队列生成图片。

- View Queue(显示队列):显示当前队列情况。

- View History(显示历史):用于显示生成的图片历史。

- Save(保存):可以将当前工作流保存至磁盘,文件为 JSON 类型。

- Load(加载):可以加载磁盘上的工作流。

- Clear(清空):清空当前工作流。

- Load Default(加载默认):加载默认工作流,即文生图工作流。

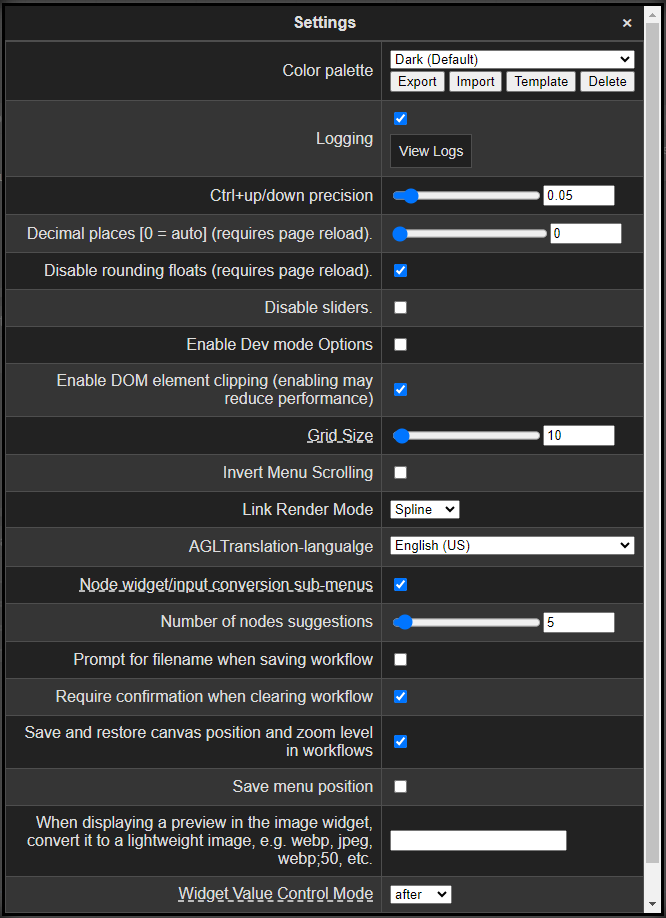

点击右上角的”齿轮“按钮,可以打开设置界面:

设置界面主要用于设置调解板、查看日志、网格大小等信息。

1.3 基础操作

还有一些基础操作,可以帮助我们更好的使用 ComfyUI。

- 在控制处按住鼠标左键,可以拖动整个画布。

- 在节点上按住鼠标左键,可以拖动节点。

- 使用鼠标滚轴可以放大和缩小画布。

- 按住输入或输出的点进行拖拽,可以连接两个节点。只能连接相同类型的输入和输出。

下面列出了一些常用的快捷键:

| 快捷键 | 说明 |

|---|---|

| Ctrl + Enter | 将当前工作流排到队列尾部生成 |

| Ctrl + Shift + Enter | 将当前工作流排到队列首部生成。 |

| Ctrl + Z/Ctrl + Y | 撤销/重做 |

| Ctrl + S | 保存工作流 |

| Ctrl + O | 加载工作流 |

| Ctrl + A | 全选所有节点 |

| Alt + C | 折叠/展开选定节点 |

| Ctrl + M | 关闭/开启选定节点 |

| Ctrl + B | 绕过选定的节点(就像从图中删除节点并重新连线一样) |

| Delete/Backspace | 删除选定节点 |

| Ctrl + Backspace | 删除当前工作流 |

| Space | 按住并移动光标时移动画布 |

| Ctrl/Shift + 单击 | 多选节点 |

| Ctrl + C/Ctrl + V | 复制/粘贴选定的节点(不保持与未选定节点输出的连接) |

| Ctrl + C/Ctrl + Shift + V | 复制/粘贴选定的节点(保持与未选定节点输出的连接) |

| Shift + 拖动 | 同时移动多个选定节点 |

| Ctrl + D | 加载默认工作流 |

Alt + + | 画面放大 |

Alt + - | 画面缩小 |

| Ctrl + Shift + LMB + Vertical drag | 画面放大/缩小 |

| Q | 切换队列的可见性 |

| H | 切换历史记录的可见性 |

| R | 刷新工作流 |

| 双击 LMB | 打开节点快速搜索面板 |

二、文生图工作流

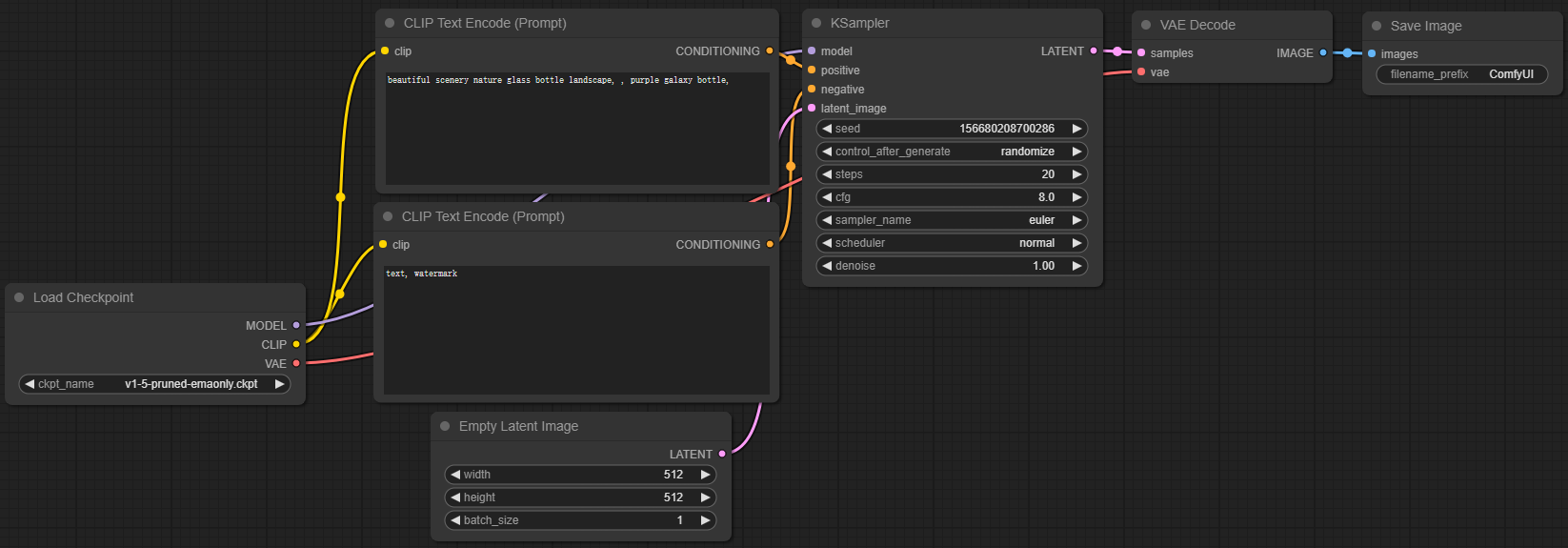

学习 ComfyUI 的最好的方式就是通过示例。因此,本节将学习 ComfyUI 的文生图工作流,了解每个节点的作用,以及它们该如何连接。

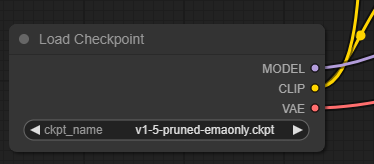

2.1 Load Checkpoint(加载模型)

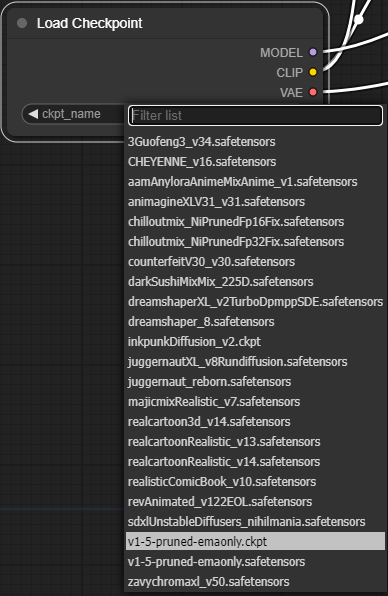

【Load Checkpoint】节点用于选择大模型。点击【ckpt_name】可以显示可用的模型列表。

大模型列表:

如果点击【ckpt_name】没有任何反应,你可能没有安装模型或者未配置 Stable Diffusion WebUI 的地址,可以在《ComfyUI 本地部署指南》中进行操作。

【Load Checkpoint】节点有三个输出部分:

- model(模型):潜在空间中的噪声预测模型。连接到采样器,在这里完成逆向扩散过程。

- CLIP:语言模型对正向提示词和负责提示词进行预处理。连接到提示词,因为提示词需要经过 CLIP 模型处理后才有用。

- VAE:VAE(Variational AutoEncoder,变分自动编码器)在像素和潜在空间之间转换图像。连接 VAE 解码器,将图像从潜在空间转换为像素空间。

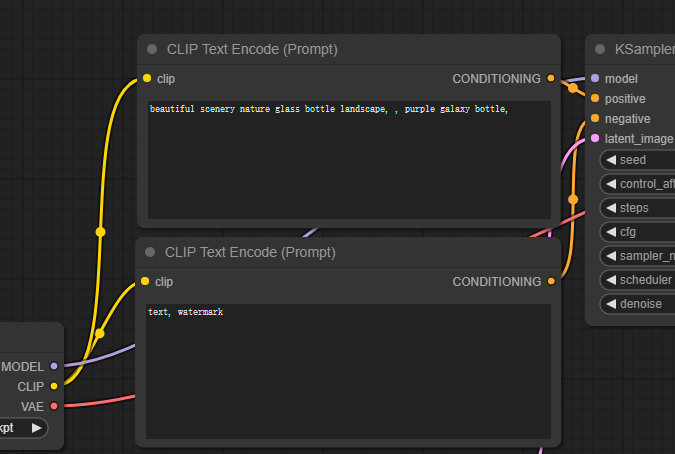

2.2 CLIP Text Encode(CLIP 文本编码)

【CLIP Text Encode】节点用于输入正向提示词和负向提示词。该节点获取提示词并将输入到 CLIP 语言模型中。CLIP 是 OpenAI 的语言模型,将提示词中的每个单词转换为

embeddings。

【CLIP Text Encode】节点的输入部分连接【Load Checkpoint】节点;输出部分连接【KSampler】的【positive】或【negative】。

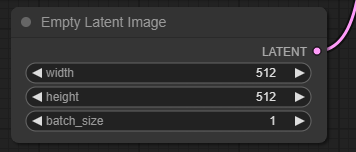

2.3 Empty Latent Image(潜在空间图像)

【Empty Latent Image】节点可以设置潜在空间图像的像素大小和批次大小。文本到图像的过程从潜在空间中的随机图像开始。潜在空间图像的大小和像素空间中的实际图像成正比。因此,如果想改变图像的大小,就要改变潜在空间图像大小。

【Empty Latent Image】节点只有一个输出项,用于连接【KSample】节点的【latent_image】。

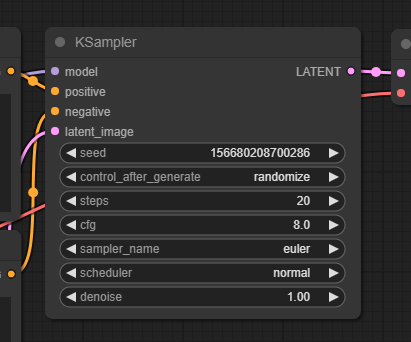

2.4 KSample(采样器)

【KSample】节点是 Stable Diffusion 中图像生成的核心。采样器将随机图像进行逐步降噪,来生成与提示词相匹配的图像。

【KSample】节点主要有以下参数:

- seed(随机种子):随机种子值控制清晰图像的初始噪声,从而控制最终图像的组成。

- control_after_generate(生成后操作):表示每次生成图片后,随机种子将如何变化。

- fixed(固定):保持种子不变;

- increment(增量):增加

1; - decrement(减量):减少

1; - randomize(随机):随机值。

- steps(采样步数):采样步骤数。更多内容参见《采样器和采样步数》。

- cfg(提示词相关性):CFG(Classifier Free Guidance)表示为无分类器信息引导规模。CFG 是控制稳定扩散应遵循文本提示的紧密程度的设置,即提示词相关性。更多内容参见《生成参数》。

- sampler_name(采样器名称):用于选择采样器。更多内容参见《采样器和采样步数》。

- scheduler(调度程序):控制噪声水平在每个步骤中如何变化。

- denoise(降噪):降噪过程应消除多少百分比的初始噪声。

1表示全部。

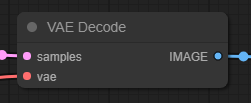

2.5 VAE Decode(VAE 解码)

【VAE Decode】节点使用提供的 VAE 将潜在空间图像解码回到像素空间图像。

【VAE Decode】节点有两个输入项,【samples】连接要解码的潜在图像的采样器,vae 连接解码清晰图像的 VAE;还有一个输出项,【IMAGE】解码后的图像。

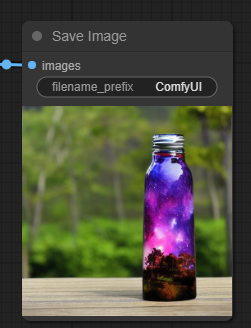

2.6 Save Image(保存图片)

【Save Image】节点用于保存图像,即将生成的图像保存到磁盘中。

【filename_prefix】参数为文件名的前缀。

点击【Queue Prompt】后,会生成图片:

图片会被保存到 ComfyUI\output 目录中。

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

需要的可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1995

1995

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?