下载安装spark

下载地址http://spark.apache.org/downloads.html

下载安装anaconda

下载地址https://www.anaconda.com/download/#macos

路径配置

cd

open .bash_profile将下面的语句添加到新打开的.bash_profile文件中。

export PATH="/Applications/anaconda3/bin:$PATH"

export SPARK_PATH="/Users/****/Downloads/spark-2.3.1-bin-hadoop2.7"

export PATH=$SPARK_PATH/bin:$PATH注意: “spark_path”等具体的路径需要根据具体的安装路径进行替换。然后,使用下面的命令使上面的修改立即生效。

source .bash_profile配置jupyter notebook

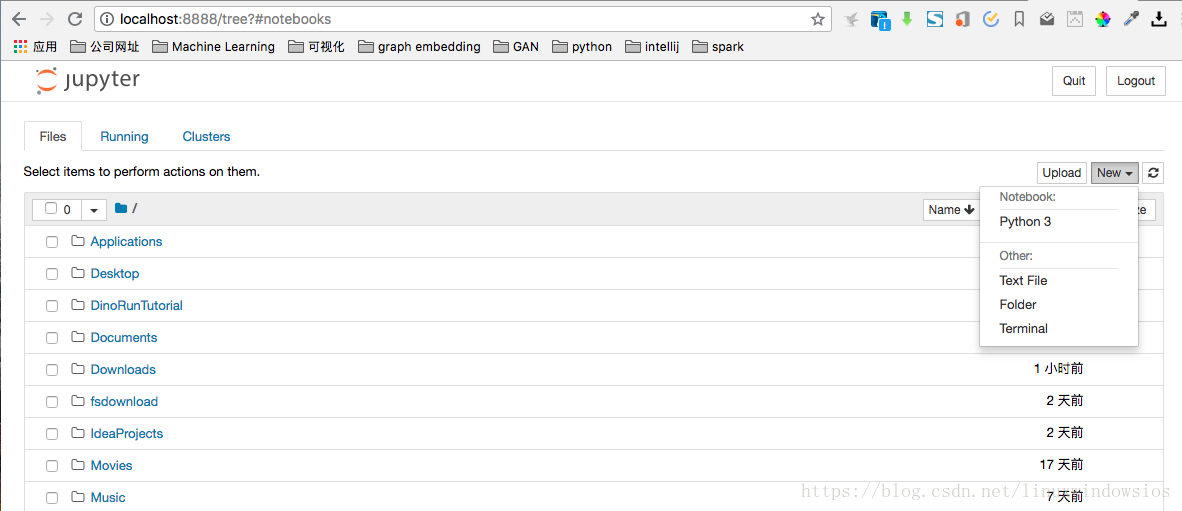

jupyter notebook启动jupyter notebook,然后新建一个python的notebook

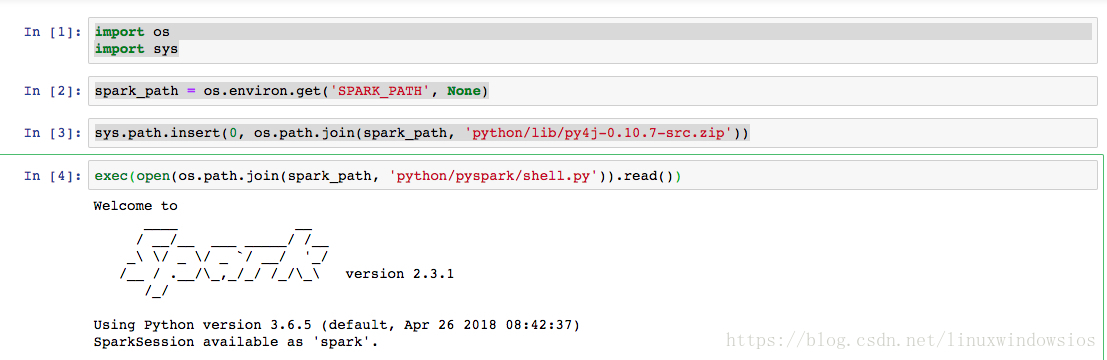

import os

import sys

spark_path = os.environ.get('SPARK_PATH', None)

sys.path.insert(0, os.path.join(spark_path, 'python/lib/py4j-0.10.7-src.zip'))

exec(open(os.path.join(spark_path, 'python/pyspark/shell.py')).read())注意: “py4j-0.10.7-src.zip”需要根据实际名称修改

执行完上面的代码,如果看到了如下的画面说明成功了。

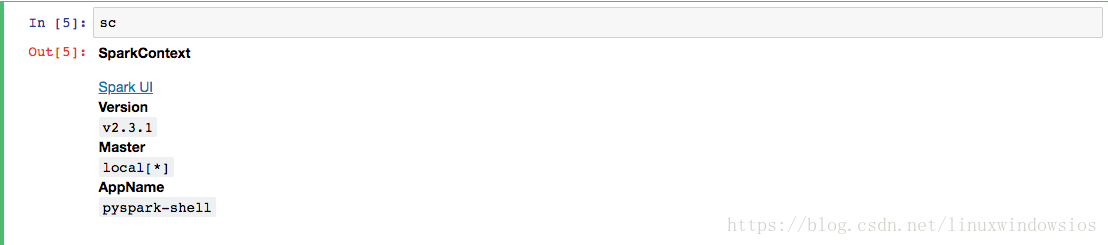

sc输入sc,查看相应的输出。

166

166

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?