pyspark底层浅析

pyspark简介

pyspark是Spark官方提供的API接口,同时pyspark也是Spark中的一个程序。

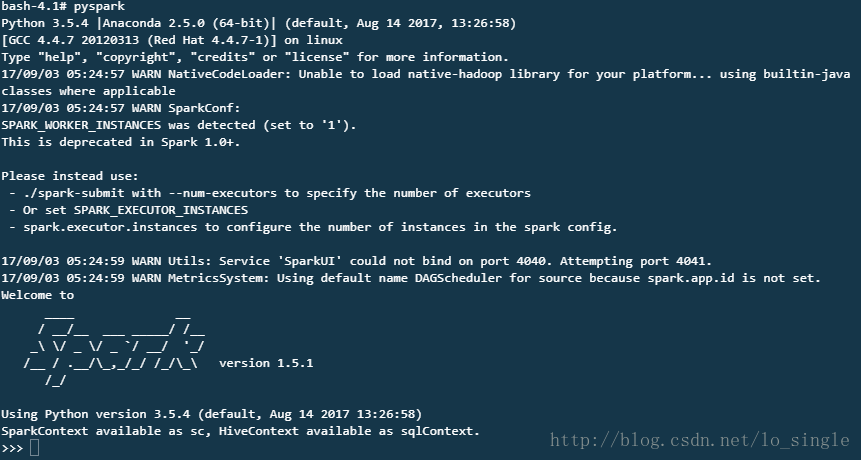

在terminal中输入pyspark指令,可以打开python的shell,同时其中默认初始化了SparkConf和SparkContext

在编写Spark应用的.py文件时,可以通过import pyspark引入该模块,并通过SparkConf对Spark的启动参数进行设置。不过,如果你仅完成了Spark的安装,直接用python指令运行py文件并不能检索到pyspark模块。你可以通过pip等包管理工具安装该模块,也可以直接使用pyspark(新版本已不支持)或spark-submit直接提交.py文件的作业。

pyspark program

这里指的是spark中的bin/pyspark,github地址 。

实际上pyspark只不过解析了命令行中的参数,并进行了python方面的设置,然后调用spark-submit

exec "${SPARK_HOME}"/bin/spark-submit pyspark-shell-main --name "PySparkShell" "$@"在较新一些的版本如Spark2.2中,已经不支持用pyspark运行py脚本文件,一切spark作业都应该使用spark-submit提交。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3162

3162

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?