下午被一个问题困扰了好一阵,最终使用另一种方式解决。

在开始之前假设你已经成功安装一切所需,整怀着一腔热血想要抓取某网站。一起来have a try。

1. 前期基础准备。

Oh,不能在准备了,直接来。

(1) 创建项目。

输入:

以上创建项目w3school。这时会产生w3school文件夹,文件夹下文件如下:

其中scrapy.cfg目的配置文件。主要改写的是w3school中的三个文件以及其中spiders中需要编写的爬虫。

一个一个来。

(2) 在items.py中定义Item容器。也就是编写items.py内容。

所谓Item容器就是将在网页中获取的数据结构化保存的数据结构,类似于Python中字典。下面为items.py中代码。

上面定义了自己的W3schoolItem类,它继承自scrapy的Item(这里没有显示定义W3schoolItem的__init__()方法,也正因为如此,python也会为你自动调用基类的__init__(),否则必须显式在子类的__init__()中调用基类__init__())。

之后声明W3schoolItem中元素并使用Field定义。到此items.py就OK了。

(3) 在pipelines.py中编写W3schoolPipeline实现对item的处理。

在其中主要完成数据的查重、丢弃,验证item中数据,将得到的item数据保存等工作。代码如下:

其中的process_item方法是必须调用的用来处理item,并且返回值必须为Item类的对象,或者是抛出DropItem异常。并且上述方法将得到的item实现解码,以便正常显示中文,最终保存到json文件中。

注意:在编写完pipeline后,为了能够启动它,必须将其加入到ITEM_PIPLINES配置中,即在settings.py中加入下面一句:

2.编写爬虫。

爬虫编写是在spider/文件夹下编写w3cshool_spider.py。

先上整个程序在慢慢解释:

(1)需要注意的是编写的spider必须继承自scrapy的Spider类。

属性name即spider唯一名字,start_url可以理解为爬取入口。

(2)parse方法。

parse()是对scrapy.Spider类的override。

(3)网页中的数据提取机制。

scrapy使用选择器Selector并通过XPath实现数据的提取。关于XPath 推荐w3school的教程。

小工具:

关于网页代码中意向信息的查找可以借助几个工具:

第一个——Firefox插件Firebug。

第二个——Firefox插件XPath。可以快速的在网页中对xpath表达式的正确性进行验证。

第三个——scrapy shell.关于其使用可以查看教程。

分析:

在这里我提取的是http://www.w3school.com.cn/xml/xml_syntax.asp网页中下图部分。

即“XML 基础”下所有目录结构的名字、链接和描述。使用Firebug找到次部分对应的代码块后就可以使用XPath执行信息提取。Xpath表达式如上面代码中所示。

上面还涉及到了对item中信息的编码,是为了中文信息在json文件中的正确显示。

(4)在parse方法中还使用到了log功能实现信息记录。使用log.mes()函数即可。

3.执行。

一切就绪。进入到项目目录下,执行:

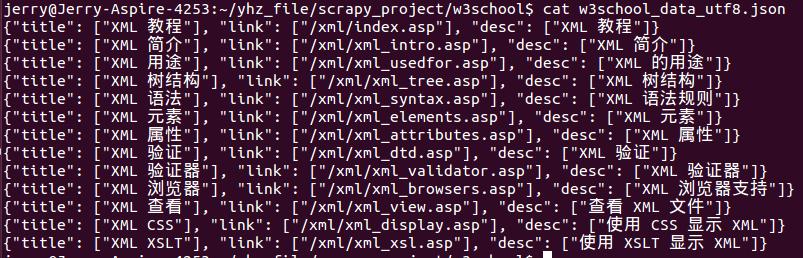

在目录下生成log和w3school_data_utf8.json文件。

查看生成的json文件:

OK。这就实现了针对 http://www.w3school.com.cn/xml/xml_syntax.asp中导航条部分的提取。

原文连接:http://blog.csdn.net/u012150179/article/details/32911511

328

328

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?