1.梯度下降算法

梯度下降算法的核心思路和公式推导,可以详见前面的文章:梯度下降算法的核心思路和公式推导

如果代价函数是凸函数,用梯度下降算法一定可以求得最优解。

2.梯度下降的三种方式

在ML中,梯度下降有三种方式:

1)批量梯度下降(Batch Gradient Descent,BGD)

2)随机梯度下降(Stochastic Gradient Descent,SGD)

3)小批量梯度下降(Mini-Batch Gradient Descent,MBGD)

每种方式都有优缺点~

梯度下降算法的核心是迭代更新计算θ,直到最新的θ不再变化,最新的θ就是最优θ,保证代价函数取得最小值,假设函数的拟合度最优~

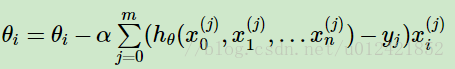

迭代更新计算θ的公式:

假设我们一共有n个样本数据集,其中m<=n,其中m表示我们用m个样本进行训练计算θ。

1)当m=n时,每次更新计算θ时,用全部的n个样本数据集进行训练计算θ,这就是批量梯度下降方式BGD

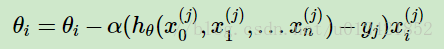

2)当m=1时,每次更新计算θ时,从n个样本中随机选择一个样本进行训练计算θ,这就是随机梯度下降方式SGD

下面公式表示用n个样本中的第j个样本数据集进行训练,计算θ:

因为每次只用一个样本数据集决定梯度方向,梯度方向变化较大,得到的θ可能不是最优θ~,但是训练速度会很快。

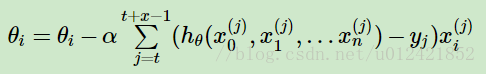

3)当1<m<n时,每次更新计算θ时,从n个样本中随机选择m个样本进行训练计算θ,这就是小批量梯度下降方式MBGD

下面公式表示用x个子样本数据集进行训练,第一个子样本数据集是t。可以通过调整子样本个数x来调优MBGD。

一般情况取x=10。

2.1批量梯度下降(BGD)

训练对象:训练全部的样本数据集

缺点:样本数据集很大时,训练慢

优点:可以得到全局最优θ

优点:方便并行实现

2.2随机梯度下降(SGD)

缺点:不是全局最优θ

缺点:不易并行实现

优点:训练快

2.3小批量梯度下降(MBGD)

将BGD和SGD的缺点降低到最小,又结合了BGD和SGD的优点。

3如何选择使用BGD SGD MBGD

1)样本数据集小--->使用批量梯度下降法(BGD)

2)样本数据集大--->使用随机梯度下降法(SGD)

3)在线------------>使用随机梯度下降法(SGD)

4)一般实际情况--->使用小批量梯度下降法(MBGD)

4梯度下降算法的调优方法(目的:加快收敛速度)

当选择好了使用BGD、SGD、MBGD其中一个梯度下降方式后,对下降梯度算法需要进行调优,那么应该从哪些方面进行调优?

4.1学习速率(Learning Rate)α调优

在θ迭代结算公式中,其中的偏导数的系数α是学习速率(Learning Rate),且α>0。

1)固定的α,α太大的话,导致迭代次数变少(因为θ增量变大),学习速率变快,训练快。但是α不是越大越好,如果α太大的话,会导致梯度下降算法在图形的上坡和下坡上面来回震荡计算,严重的结果可能无法收敛;

2)固定的α,α太小的话,导致迭代次数变多(因为θ增量变小),学习速率变慢,训练慢。但是α不是越小越好,如果α太小的话,会导致梯度下降算法在图形迭代到最优点处整个过程需要训练很长时间,导致训练太慢,虽然可以取得最优θ。

3)变化的α,当梯度大的时候,学习速率变大,梯度小的时候,学习速率变小。则学习速率和梯度是一个正相关,可以提高下降算法的收敛速度。α和梯度的正相关有一个比例系数,称为Fixed Learning Rate。Fixed Learning Rate一般取0.1或者0.1附件的值,可能不是最好但是一定不会太差~

4.2选取最优的初始值θ

首先,初始值θ不同,获得的代价函数的最小值也可能不同,因为每一步梯度下降求得的只是当前局部最小而已。所以需要多次进行梯度下降算法训练,每次初始值θ都不同,然后选取代价函数取得的最小值最小的那组初始值θ。

4.3特征数据归一化处理

样本不相同,特征值的取值范围也一定不同。特征值的取值范围可能会导致迭代很慢。所以就要采取措施减少特征值取值范围对迭代的影响,这个措施就是对特征数据归一化。

数据归一化方法有:1)线性归一化,2)均值归一化。一般图像处理时使用线性归一化方法,比如将灰度图像的灰度数据由[0,255]范围归一化到[0,1]范围。如果原始数据集的分布近似为正态(高斯)分布,那么可以使用均值归一化对数据集进行归一化,归一化为:均值为0,方差为1的数据集。

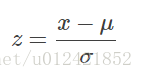

这里面采用均值归一化,均值归一化的公式如下所示:

其中μ是原始数据集的均值,σ是原始数据的标准差,求出来的归一化数据的特点是:均值为0,方差为1的数据集。

经过特征数据归一化后,梯度下降算法会在期望值为0,标准差为1的归一化特征数据上进行迭代计算θ,这样迭代次数会大大加快~

相关参考:https://blog.csdn.net/u012421852/article/details/79562067

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?