概括

《Are Transformers Effective for Time Series Forecasting?》是由 Sasha H. Zohren, Markus L. L. Luebke, Yan Liu 和 Dengyong Zhou 等人于 2021 年发表的论文,主要讨论了 Transformer 模型是否适用于时间序列预测问题。论文中系统地评估了 Transformer 在时间序列任务中的表现,并与传统的时间序列预测方法进行了对比。

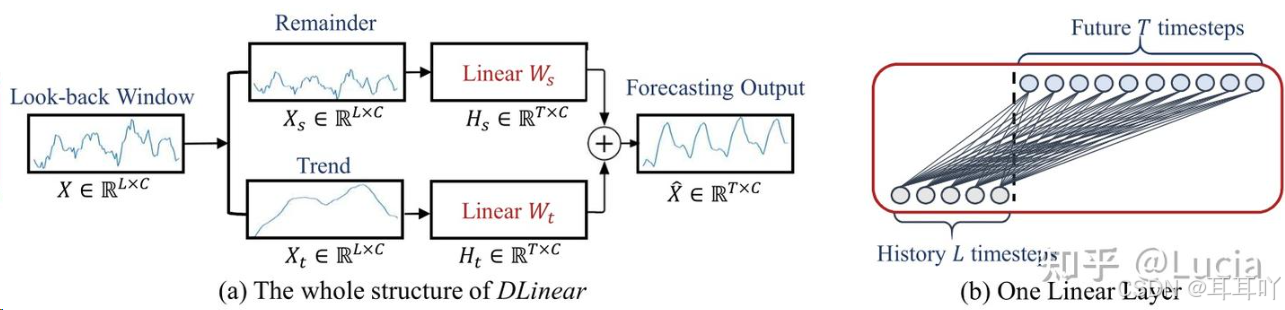

主要流程:

分解季节性和趋势成分分解季节性和趋势成分,使用series_decomp方法

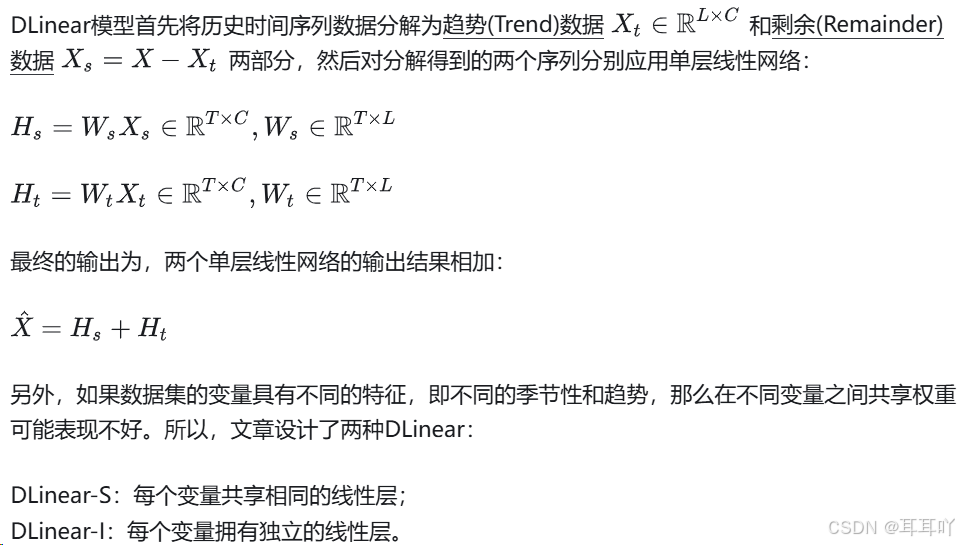

如果 individual=True,则每个通道都会有一个独立的季节性和趋势性线性层(通过 self.Linear_Seasonal[i] 和 self.Linear_Trend[i])。seasonal_output 和 trend_output 的形状是 [Batch, Channels, Pred_len],其中 Pred_len 是预测的时间步长。在循环中,针对每个通道 (i),分别应用对应的线性层,生成季节性和趋势性输出。

如果individual=False,则季节性和趋势性部分共享相同的线性层(即 self.Linear_Seasonal 和 self.Linear_Trend 分别作用于所有通道)。seasonal_output 和 trend_output 的形状是 [Batch, Channels, Pred_len]。

合并季节性和趋势性成分

返回最终结果并调整维度顺序

主要内容:

nn.ModuleList():

这里使用 ModuleList() 是为了确保每个通道(channel)都有一个独立的线性层。ModuleList() 是 PyTorch 提供的一个容器,能够管理多个子模块(例如线性层),并确保它们正确地注册到模型中。

对于每个通道:

- nn.Linear(self.seq_len, self.pred_len): 为每个通道

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1388

1388