今天的爬虫实战是爬取百度贴吧

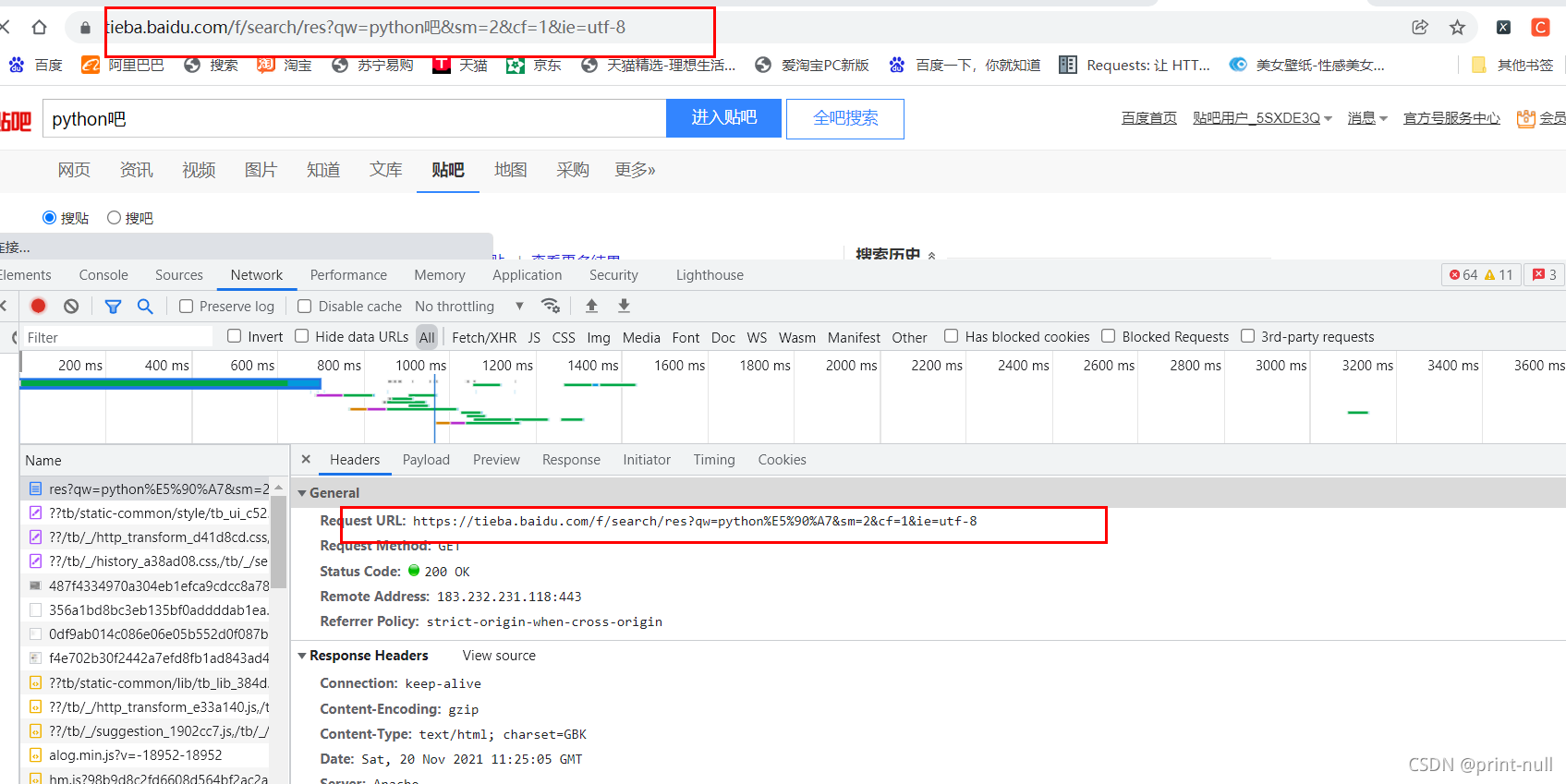

爬虫五部曲,目标链接,分析网页,发起请求,解析,保存

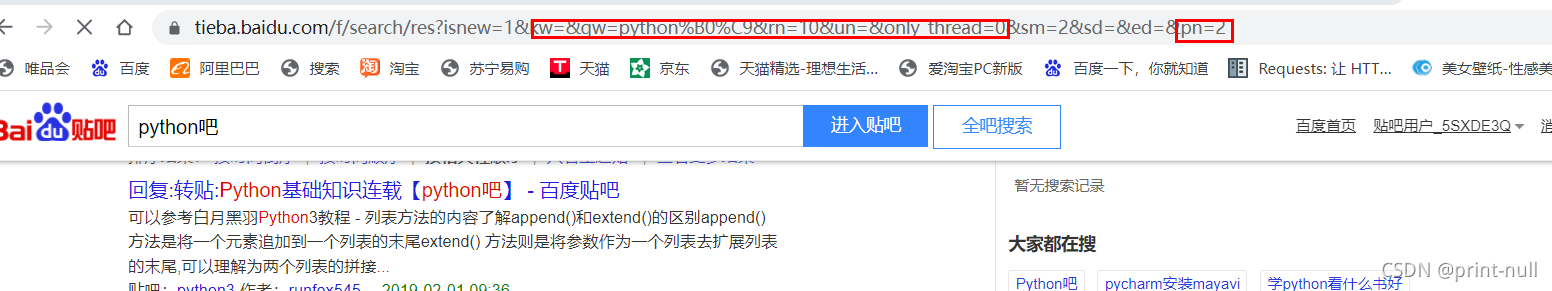

kw后面就是我们输入要进入的贴吧,pn就是翻页的值

在这里我们本次目的是把整个网页拿下来,我们就不用xpath了

直接上菜

from urllib import request,parse

import time

import random

#创建类

class Baidutieba(object):

def __init__(self):

'''基本常量'''

self.url = "https://tieba.baidu.com/f?kw={}&pn={}"

self.headers

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2525

2525

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?