文章目录

- LLaMA大模型及其衍生模型

-

- 1. LLaMA

- 2. stanford_alpaca

- 3. ChatDoctor

- 4. alpaca-lora

- 5. Chinese-LLaMA-Alpaca

- 6. BELLE

- 大模型综述 A Survey of Large Language Models

关键词:大模型,LLaMA,Alpaca,Lora,Belle,模型训练,模型微调,指令微调

最近尝试在领域数据进行生成式大模型的再训练和微调,在调研和实验中整理了一些项目&论文的基本信息,后续会持续完善和补充。

LLaMA大模型及其衍生模型

1. LLaMA

项目地址 : https://github.com/facebookresearch/llama

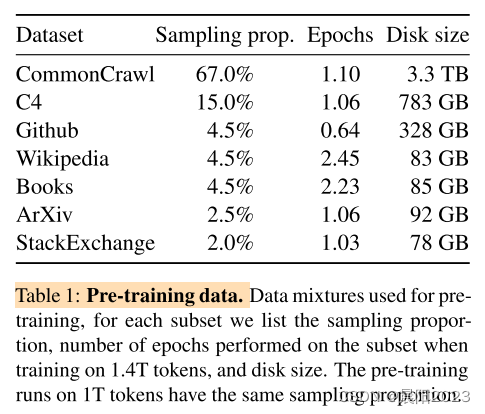

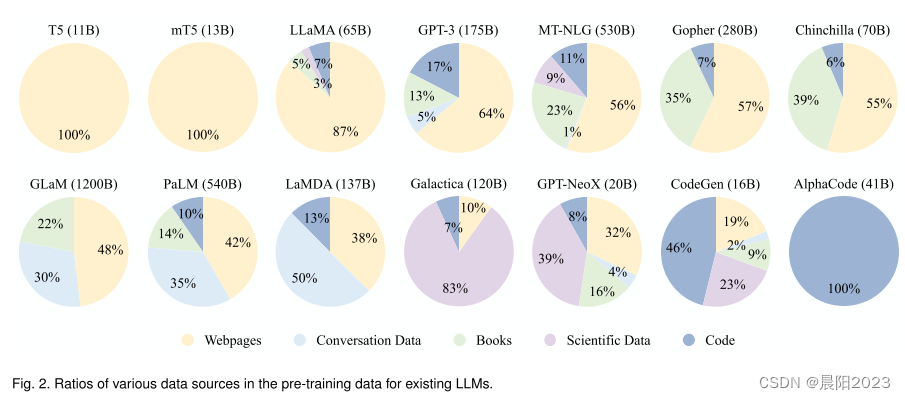

LLaMa语料数据如下,对各类语料又做了「去重、筛选」等,每种数据的处理方式有差别,具体见论文。语料中不包含中文数据。

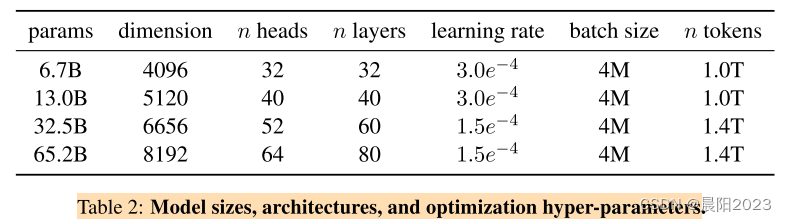

模型参数 :1.4T tokens, 2 epochs, 训练耗时65B模型: 2048 * 80G A100 * 21day,其他参数见下表:

相对于之前的大模型,LLaMa做了三点改进:

- GPT3在每层transformer之后做正则化,调整为在每层transformer之前做正则化,正则化采用RMSNorm;

- 相比PaLM,在激活函数上,使用SwiGLU替换ReLU非线性激活函数;

- 相比GPTNeo,在位置编码上,使用RoPE替代绝对位置编码;

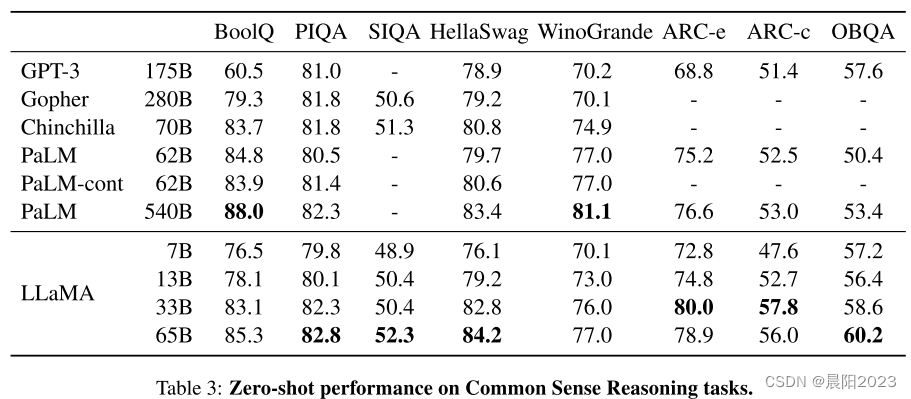

LLaMA相对其他大模型在零样本常识推理任务上的性能对比:

结论

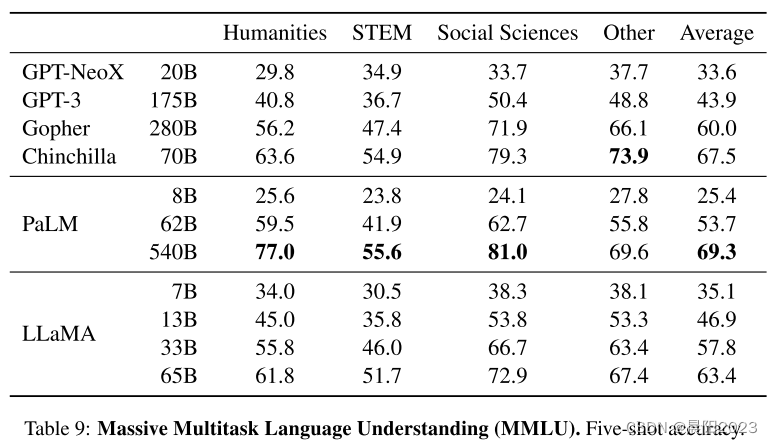

:在其他零样本、小样本任务上与各大模型进行性能对比,结果显示,LLaMA-13B在大多数任务上能够赶上GPT3,但模型大小不足GPT3的十分之一。LLaMA-65B与Chinchilla-70B/PaLM-540B在多个任务也具有一定的竞争力。

更重要的是LLaMA是chatGPT之后首个被广泛用作底座模型的开源大模型,为后续基于llama的衍生模型做出了极大的贡献

2. stanford_alpaca

项目地址 :https://github.com/tatsu-lab/stanford_alpaca

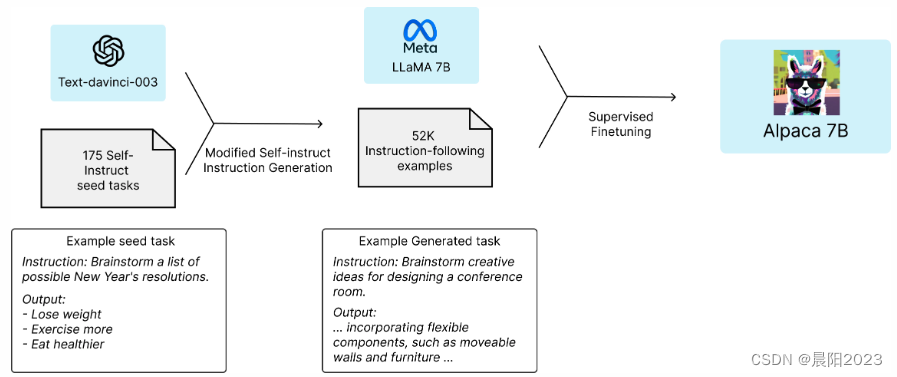

以llama做为底座模型,引入新的数据进行指令微调ISF,新数据采用self-instruct的方式有Text-

davinci-003进行生成,得到52k新数据进行微调训练。

本项目的贡献在于,提供了用于指令微调的数据生成方式,同时证明了ISF后模型效果的提升 ,其之后的很多项目均是基于这个思路。

3. ChatDoctor

本项目可以看着是standford-aplaca方法在医疗领域的衍生,其借助chatGPT对结构化知识库生成ISF数据集的方法在后续项目的多被借鉴。

项目地址 :

基础模型 :llama-7b

指令样本构造 :Standford Alpaca 52k数据,700类疾病知识库借助ChatGPT生成的5k数据

指令样本量 :52k + 5k

任务评测 :对比ChatGPT在医学内容上进行提问,评估内容输出的准确性,ChatGPT 87%,ChatDocter 91%

模型发布 :ChatDocktor,模型在stanford alpaca的基础上进行再训练

![image2023-4-12_14-23-7.png]

4. alpaca-lora

项目地址 : https://github.com/tloen/alpaca-lora

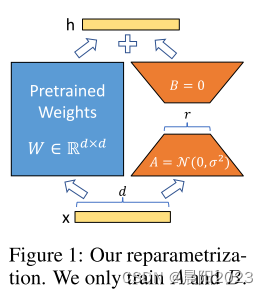

Alpaca-Lora (羊驼-Lora),在stanford-alpaca的基础上,使用 Lora (Low-rank Adaptation)

技术对模型进行指令微调,相当于是对模型进行轻量化训练,使得对显存的占用和训练时长都大幅度降低。在大模型训练高资源高成本的情况下,使用lora技术,牺牲少部分性能却使得大模型训练变得可行,在之后的项目中被广泛用到。

LoRa结构:在模型的Linear层的旁边,增加一个「旁支」,训练更新旁支参数替代模型参数。

5. Chinese-LLaMA-Alpaca

项目地址 : https://github.com/ymcui/Chinese-LLaMA-Alpaca

该项目值得被重点推荐和学习,ymcui在Bert时代[Chinese-BERT-wwm](https://github.com/ymcui/Chinese-

BERT-wwm)亦是杰出之作。

该项目在LLaMA的基础上扩充了中文词表并使用了中文数据进行二次预训练,同时中文Alpaca模型进一步使用了中文指令数据进行精调。保姆级说明文档及量化版本可轻松部署本地PC。

预训练数据 :通用中文语料(bert-wwm,macbert,lert,pert等语料)13.6M行

指令微调样本数据 :200w数据,中英文翻译500k + pCLUE 300k + Alpaca 100k(中/英)

6. BELLE

项目地址 :

基础模型 :bloom-7b, llama-7b

指令样本构造 :Standford Alpaca方法,chatGPT self-instruct

指令样本量 :20万、60万、100万和200万样本

任务评测 :在Extract, Classification, Closed QA,

和Summarization任务上,增加数据能持续带来效果的提升,还未达到瓶颈。在Translation, Rewrite,

和Brainstorming任务上,几十万的数据量就能获得较好的效果。在Math, Code,

和COT任务上,模型效果较差,而且增加数据量已经无法带来效果的提升。 https://github.com/ZrrSkywalker/LLaMA-

Adapter

模型发布 :BLOOMZ-7B1-xx,LLAMA-7B-xx,xx表示不同的指令样本量

大模型综述 A Survey of Large Language Models

论文地址 :

4月份发表在arXiv上的大模型综述,包括了大模型的发展历程、各大模型的关键参数、训练语料的处理方法及数据类型,以及大模型训练的流程等,对于全面了解认识大模型很有帮助。

-

大模型发展历程:

- 各大模型关键信息 :

-

LLM语料从内容类型上可以分为六大类 :Books, CommonCrawl, Reddit links, Wikipedia, Code, and others.

语料数据包括了通用数据和专业数据,通用数据的多样性能提高模型的泛化性和语言理解能力,专业数据能够赋予LLM特定的任务解决能力。

高质量数据可能在很大程度上影响LLM的性能,因此需要对原始语料进行过滤,包括去除有噪声、冗余、不相关和潜在毒性的数据。

LLM训练前的数据处理流程:

---------END--------

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

11万+

11万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?