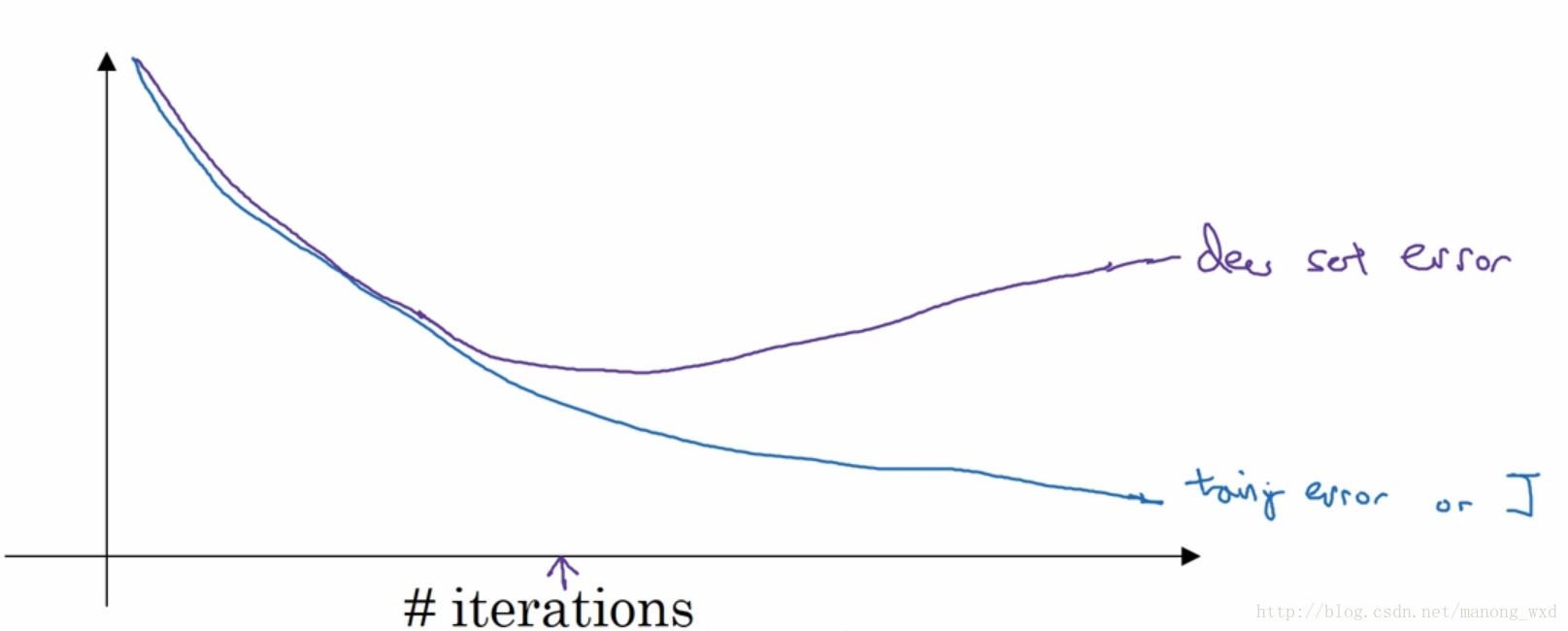

在训练中,我们希望在中间箭头的位置停止训练。而Early stopping就可以实现该功能,这时获得的模型泛化能力较强,还可以得到一个中等大小的w的弗罗贝尼乌斯范数。其与L2正则化相似,选择参数w范数较小的神经网络。

可以用L2正则化代替early stopping。因为只要训练的时间足够长,多试几个lambda。总可以得到比较好的结果。

Early stopping:

优点:只运行一次梯度下降,我们就可以找出w的较小值,中间值和较大值。而无需尝试L2正则化超级参数lambda的很多值。

缺点:不能独立地处理以上两个问题,使得要考虑的东西变得复杂。举例如下:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6289

6289

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?