今天了解了一下hadoop的大体安装过程,由于资金紧张,在我的破笔记本上装了一下hadoop

准备的三个东西:

1,Vmware 自己下载,这个网上很多。

2,centos 系统

3,Linuxjdk1.7以上

这三个都下载好以后。

虚拟机安装centos 系统 这儿就不说了,随便装一装就行了,顺便安装tools工具

1,登陆用户进入linux系统,然后在用户主目录创建一个文件夹,(任意地方),解压,这个下载解压版的,文件上传不上去,直接生成一个下载链接 下载 这个是64位的。我用的就是这个。

--用到的命令:解压(tar -zxvf 文件)(cp 拷贝 ).我解压到 /user/local 下 了

2,对java 进行环境配置!

进入配置文件 vi /etc/profiles 注意权限

进入到最下面 添加:

export JAVA_HOME=/user/local/jdk1.8.0_162

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$JAVA_HOME/bin:$PATH

3,:wq 保存,然后 source /etc/profile 加载到内存

4,java -version || javac -version 分别执行这两个命令。如果能出来版本就正确

坑: 如果是32位的jdk,会出现一个bash的错误。

--------------------------------------------------------------------------------------------------------

装hadoop

1,解压hadoop 下载hadoop 链接 Linux的64位的

2,tar -zxvf hadoop....tar.gz ~/dt/ -- 解压到这个目录 目录自己随意

3,开始配置环境hadoop 环境变量

export HADOOP_HOME=~/dt/hadoop2.5.6

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

4,、保存。然后执行/etc/profile文件(让配置生效):

source /etc/profile

5,测试 hadoop version

-------------------------------------------------------------------------------

如果你用普通用户无法使用sudo时,修改 /etc/sudoers 这个文件 找到 root ALL=(ALL) ALL 下面 加你的用户名即可

------------------------------------------------------------------------------

两个简单命令:

1,pi 用那个什么定律算pi

2,wordcount 统计一个文件相同的字一共有多少个

代码演示:

进入jar文件下

cd ~/dt/hadoop-2.7.3/share/hadoop/mapreduce/hadoop jar hadoop-mapreduce-examples-2.7.3.jar pi 10 10这个会有个坑,centos 会出现解析域名错误。 原因,

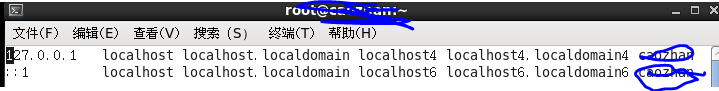

1,需要修改/etc/hosts 这个文件,将你的主机名添加到后面如下图:

加到这儿,蓝色标记,加你的主机名

2,看一看 /etc/sysconfig/network中的hostname 是不是你的主机名。就可以了

------------------------------------------------------------------------------------------------------

执行wordcount 命令

1,先进入到里面

cd hadoop-2.7.3/share/hadoop/mapreduce/

2,开始执行

hadoop jar hadoop-mapreduce-examples-2.7.3.jar wordcount aa.txt(这个文件是存在的) /user/aaa(这个文件夹不能存在)

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?