简要的实现实现Python爬虫爬取百度贴吧页面上的图片,下面的网页就是本篇博客所要爬的网页,当然看到的只是其中的一部分图片,是所要爬取的页面,

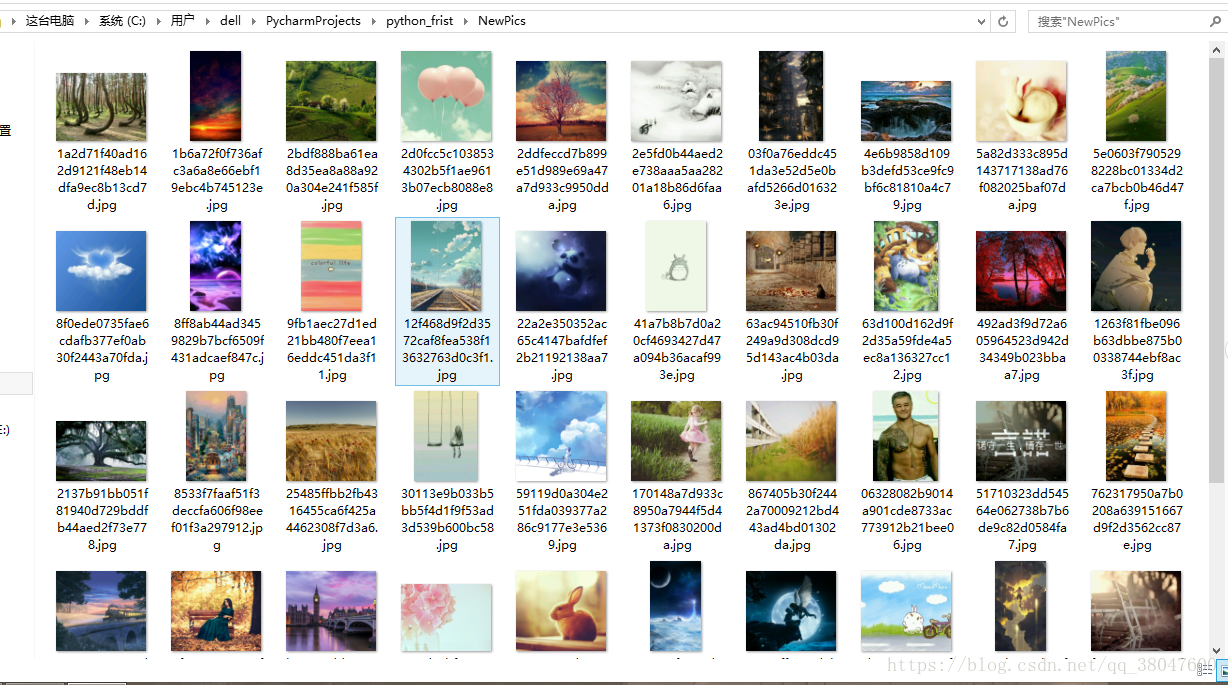

而下图则是最终的爬取的图片:

接下来就简要的讲讲爬取的整个过程:

首先你需要一个好的编程工具,博主所用的就是自己感觉比较好用的Pycharm工具,这是官网的下载网址Pycharm下载,大家可以按照自己的电脑配置进行下载,环境的搭建我就不细说了,网上都比较多,大家可以参考参考。

接下来就是爬虫代码的编写了,话不多说看代码吧:

import urllib.request

import re

import os

''' 这是需要引入的三个文件包 '''

def open_url(url):

req = urllib.request.Request(url)

req.add_header('User-Agent', 'mozilla/5.0 (windows nt 6.3; win64; x64) applewebkit/537.36 (khtml, like gecko) chrome/65.0.3325.181 safari/537.36')

'''User_Ahent是爬虫所需要模拟浏览器访问所需要的一些标识信息,如浏览器类型,操作系统等'''

page = urllib.request.urlopen(req)

html = page.read().decode('utf-8')

return html

def get_img(html):

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9555

9555

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?