RoBERTa模型是在BERT预训练模型的基础上改进了三点:

一、采用动态Masking机制,每次向模型输入一个序列时,都会生成一种新的遮盖方式

二、删除了Next Sentence Prediction(NSP)任务

三、增加了预训练过程的预料规模,扩大Batch Size的同时增加了训练时的步长

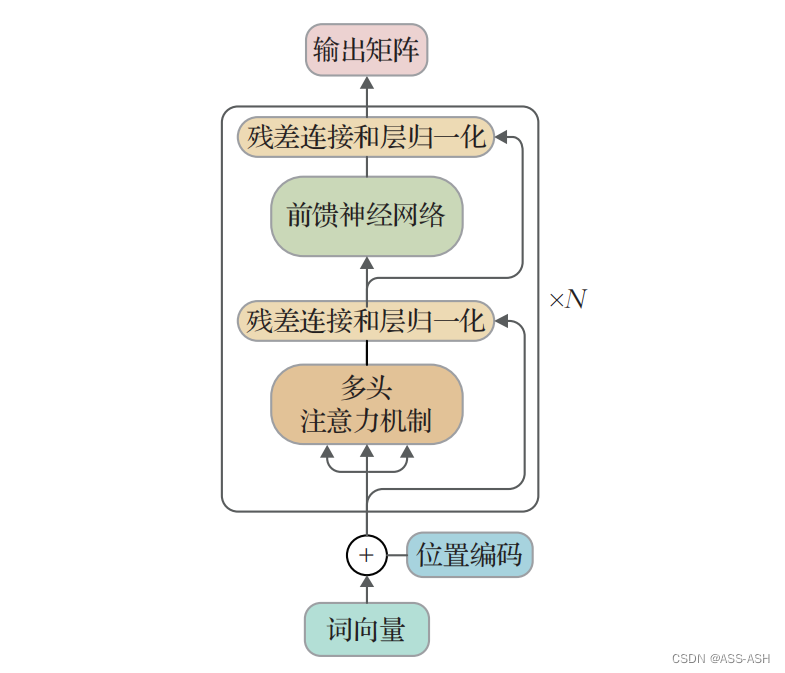

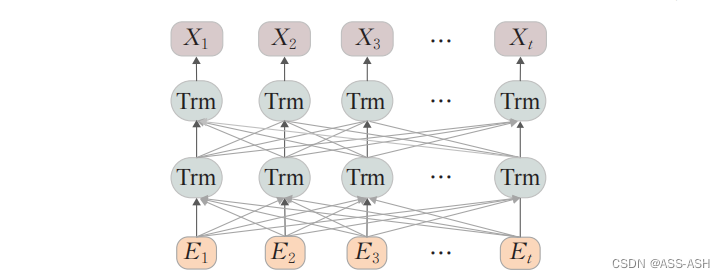

与BERT模型一致,RoBERTa模型同样使用多个双向Transformer模型的encoder部分堆叠组成主主体框架,能更彻底地捕捉文本中的双向关系

Transformer-encoder逻辑结构

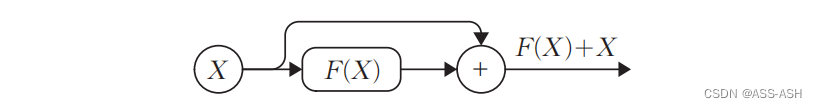

残差连接网络结构

RoBERTa层逻辑结构图

965

965

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?