1.搭建链接:

https://www.jianshu.com/p/30d45fa044a2

2.补充:

上面链接中,在spark-env.sh加上export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/hadoop-2.9.2/bin/hadoop classpath)

上面地址为自己hadoop安装地址,没有会报错(本人是这样)

上面链接中本人用的是:scp 压缩的spark文件 主机名:安装目录 进行文件传输的,使用作者的不知道保存到那里去了

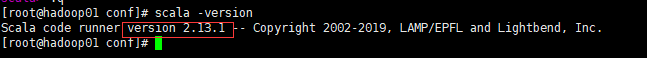

scala版本查看:

hadoop版本查看:

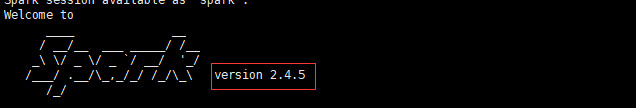

spark版本查看:(spark-shell运行)安装成功,直接显示

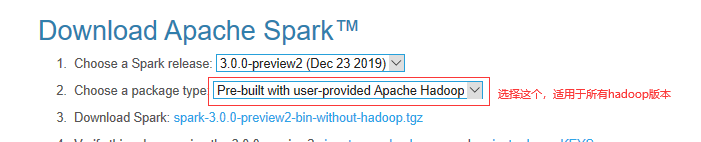

版本选择:

座右铭:站在别人的思想上,看见自己的不足,传播错误的经验,愿君不重蹈覆辙

由于受限于本人经验,难免不足,如有建议,欢迎留言交流

说明:如果喜欢,请点赞,您的鼓励是本人前进最好的动力

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?