一、简单的介绍一下scrapy 官方文档自带的代码比较多但是改的地方比较少,而第二种方发 代码量较少,但是改的地方较多。

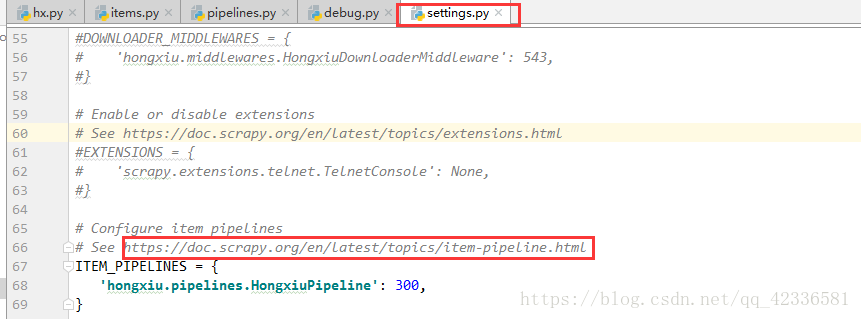

1、第一种方法;官方文档法。我们可以去settings中复制文档网址进官方文档进行复制粘贴。(pipeline中只需要修改三处,)

https://doc.scrapy.org/en/latest/topics/item-pipeline.html

import pymongo

class MongoPipeline(object):

collection_name = 'scrapy_items' # 这里的地方是连接的数据库表的名字

def __init__(self, mongo_uri, mongo_db):

self.mongo_uri = mongo_uri

self.mongo_db = mongo_db

@classmethod

def from_crawler(cls, crawler):

return cls(

mongo_uri=crawler.settings.get('MONGO_URI'), # get中有两个参数,一个是 配置的MONGO_URL ,另一个是localhost

mongo_db=crawler.settings.get('MONGO_DATABASE', 'items') # 这里的两个参数,第一个是数据库配置的.第二个是它的表的数据库的名字

)

def open_spider(self, spider):

self.client = pymongo.MongoClient(self.mongo_uri)

self.db = self.client[self.mongo_db]

def close_spider(self, spider):

self.client.close()

def process_item(self, item, spider):

self.db[self.collection_name].insert_one(dict(item))

return item2、接下来是settings 的配置。

MONGO_URL = 'localhost'

MONGO_DATABASE = 'item' # 数据库的名字.二、第二种方法是自己定义的mongodb数据库

1、这里只需定义pipelines,在settings中无需配置,代码如下。

import pymongo

class JobsPipeline(object):

def process_item(self, item, spider):

# 参数1 {'zmmc': item['zmmc']}: 用于查询表中是否已经存在zmmc对应的documents文档。

# 参数2 要保存或者更新的数据

# 参数3 True: 更新(True)还是插入(False, insert_one())

self.db['job'].update_one({'zmmc': item['zmmc']}, {'$set': dict(item)}, True) # job为连接数据库表的名字

return item

def open_spider(self, spider):

self.client = pymongo.MongoClient('localhost')

self.db = self.client['jobs'] # jobs 为连接数据库名字

1469

1469

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?