随机变量x的取值集合X={x1,x2,x3}

概率分布P(x)

P(x1)=0.2

P(x2)=0.3

P(x3)=0.5

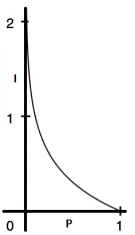

信息量

信息量是指信息多少的量度,概率越大信息量越少,概率越小信息越大。

I(x1)=-log(P(x1))=2.32

I(x2)=-log(P(x2))=1.73

I(x3)=-log(P(x3))=1

概率与信息量关系曲线

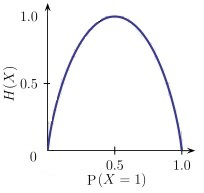

熵

表示信息量的期望。

H(x)=-∑P(x)log(P(x))=0.2*2.32 + 0.3*1.73 + 0.5*1=1.46

概率与熵关系曲线

交叉熵

用于度量两个概率分布间的差异性信息。

假设x有另一个单独概率分布Q(x)

Q(x1)=0.1 -log(Q(x1))=3.32

Q(x2)=0.2 -log(Q(x2))=2.32

Q(x3)=0.7 -log(Q(x3))=0.51

交叉熵:H(P,Q)=-∑P(x)log(Q(x))=0.2*3.32 + 0.3*2.32 + 0.5*0.51=1.57

可以把P(x)当作是目标值概率分布,把Q(x)当作是预测值概率分布,对于图像分类时目标概率P(x1)、P(x2)、P(x3)其中一个为1与另外两个为0。

相对熵

是两个概率分布间差异的非对称性度量。

KL(P||Q)=∑P(x)log(P(x)/Q(x))=H(P,Q)-H(P)=0.11

2501

2501

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?