考虑一个优化问题: min x f ( x ) \min_{x}f(x) minxf(x), 我们一般对 x x x求导,导数为0的点即为极值点。当遇到导数不好求出的时候,我们一般用梯度下降法或者牛顿法等迭代的方法。这些都是没有约束的最优化解法,当我们对自变量有一定约束的时候应该如何求解是本文要讨论的问题。

1、等式约束

求解如下有等式约束的最小化问题: min x f ( x ) \min_xf(x) xminf(x) s . t . h ( x ) = 0 s.t. \quad h(x)=0 s.t.h(x)=0

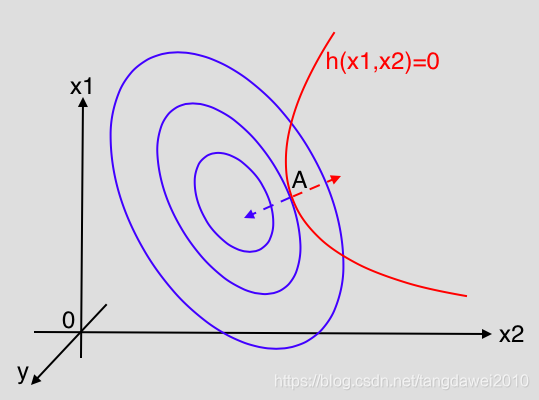

假设 x x x是二维空间向量,那么 y = f ( x ) y=f(x) y=f(x)是三维空间中的一个曲面。如图所示,蓝色曲线为等高线,红色部分是约束 h ( x ) = 0 h(x)=0 h(x)=0。满足 f ( x ) f(x) f(x)最小的 x x x的值必须在红色曲线上,所以 x x x要么是等高线与 h ( x ) = 0 h(x)=0 h(x)=0的交点,要么是切点。但是交点是不可能的,因为如果是交点,则一定还有另一条等高线与之相交并等到更接近最小值的 x x x, 因此最接近最小值的 x x x一定是两条曲线的切点,即在这个点两条曲线有相同的切线,因此法向量方向相同,可以得出:

∇ f ( x ) = λ ∇ h ( x ) , λ ≥ 0 \nabla f(x)=\lambda \nabla h(x), \lambda \geq0 ∇f(x)=λ∇h(x),λ≥0

我们也可以写为:

∇ f ( x ) + α ∇ h ( x ) = 0 \nabla f(x)+\alpha \nabla h(x)=0 ∇f(x)+α∇h(x)=0

加上我们的约束条件: h ( x ) = 0 h(x)=0 h(x)=0, 我们只需要解如下方程组即可得到 x x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?