一、简介

对于spark的优化并不只是从程序入手,而是Spark 优化主要集中在内存、网络IO、和磁盘IO三个方面。即就是driver、executor 的内存和shuffle 的设置,文件系统的配置,集群的搭建,集群和文件系统的搭建。通过对spark的优化,解决了资源的限定、以及性能的提升。

二、常见的优化方法

1、repartition(重分区) and coalesce(合并)

我们都知道在spark Shuffle阶段,会使用repartiton() 函数创建一系列新的分区,可是在使用repartition()重新分区的过程是非常消耗性能的操作。所以spark 提供了优化后函数coalese(), 其避免了数据的移动。但是只有在确保RDD分区的数量减少时,才能使用coalese()来代替repartition()函数。为了安全起见,在考虑使用coalese()函数时,在Java/Scala 语言中使用 rdd.partitions.size()`来确保shuffe过程中合并的分区比当前分区更少。

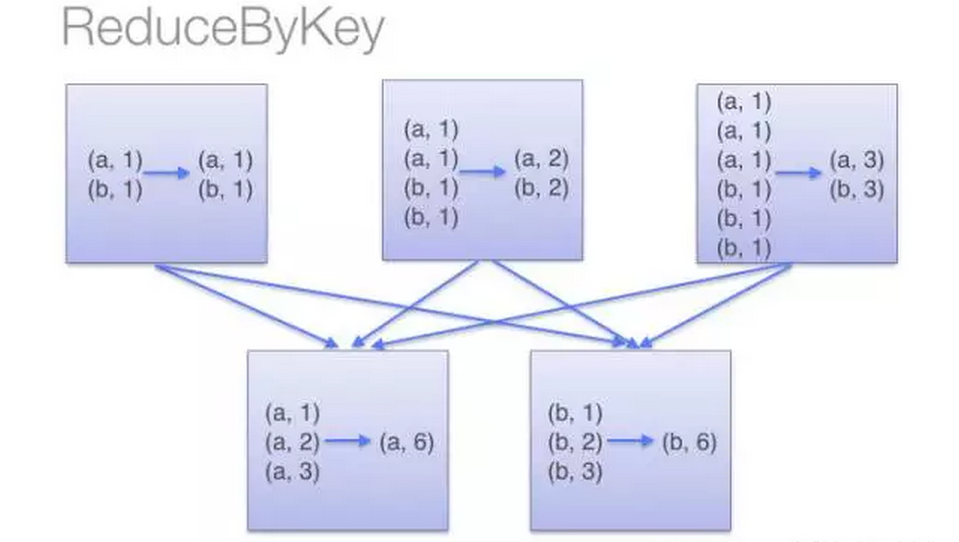

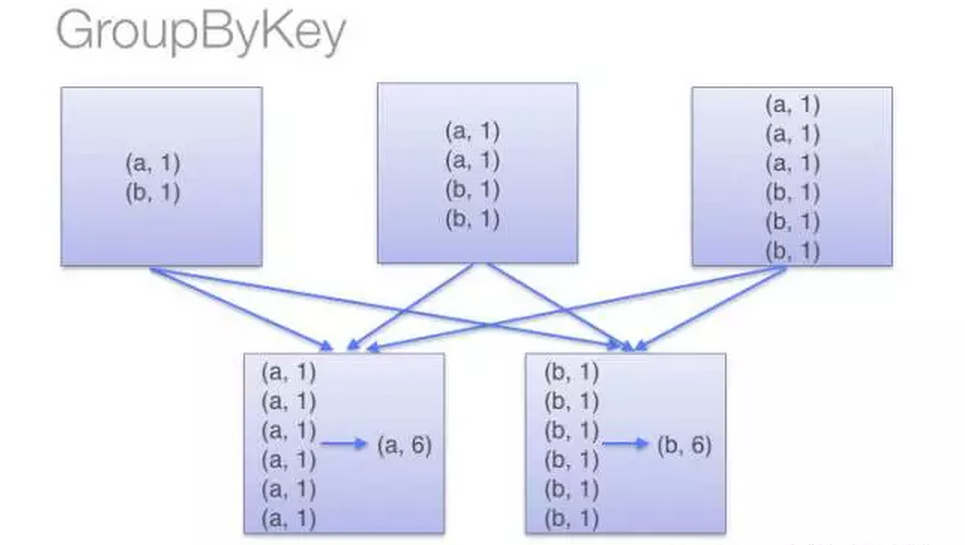

2、使用ReduceByKey 代替GroupByKey 能够减少网络IO 的消耗

ReduceByKey的数据处理原理如图1所示:

图1 ReduceByKey 的处理原理图

GroupByKey的数据处理原理如图2 所示:

图2 GroupByKey 的处理原理图

3、使用Kryo序列化

spark 应用程序中,在对 RDD 进行 shuffle 和 cache 时,数据都是需要被序列化才可以存储的,此时除了 IO 外,数据序列化也可能是应用程序的瓶颈。这里推荐使用 kryo 序列库,在数据序列化时能保证较高的序列化效率。

sc_conf = SparkConf()

sc_conf.set("spark.serializer", "org.apache.spark.serializer.KryoSerializer")4、尽量避免使用会产生shuffle 操作的转换或动作

如果有可能的话,要尽量避免使用会产生shuffle 操作的转换或动作。因为Spark作业运行过程中,最消耗性能的地方就是shuffle过程。shuffle过程,简单来说,就是将分布在集群中多个节点上的同一个key,拉取到同一个节点上,进行聚合或join等操作。比如reduceByKey、join等算子,都会触发shuffle操作。

shuffle过程中,各个节点上的相同key都会先写入本地磁盘文件中,然后其他节点需要通过网络传输拉取各个节点上的磁盘文件中的相同key。而且相同key都拉取到同一个节点进行聚合操作时,还有可能会因为一个节点上处理的key过多,导致内存不够存放,进而溢写到磁盘文件中。因此在shuffle过程中,可能会发生大量的磁盘文件读写的IO操作,以及数据的网络传输操作。磁盘IO和网络数据传输也是shuffle性能较差的主要原因。

因此在我们的开发过程中,能避免则尽可能避免使用reduceByKey、join、distinct、repartition等会进行shuffle的算子,尽量使用map类的非shuffle算子。这样的话,没有shuffle操作或者仅有较少shuffle操作的Spark作业,可以大大减少性能开销。

275

275

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?