| Time Limit: 1000MS | Memory Limit: 10000K | |

| Total Submissions: 98268 | Accepted: 47634 |

Description

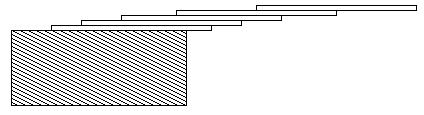

How far can you make a stack of cards overhang a table? If you have one card, you can create a maximum overhang of half a card length. (We're assuming that the cards must be perpendicular to the table.) With two cards you can make the top card overhang the bottom one by half a card length, and the bottom one overhang the table by a third of a card length, for a total maximum overhang of 1/2 + 1/3 = 5/6 card lengths. In general you can make n cards overhang by 1/2 + 1/3 + 1/4 + ... + 1/(n + 1) card lengths, where the top card overhangs the second by 1/2, the second overhangs tha third by 1/3, the third overhangs the fourth by 1/4, etc., and the bottom card overhangs the table by 1/(n + 1). This is illustrated in the figure below.

Input

Output

Sample Input

1.00 3.71 0.04 5.19 0.00

Sample Output

3 card(s) 61 card(s) 1 card(s) 273 card(s)

Source

//二分法查找的应用

#include <iostream>

using namespace std;

int zero(double x) //在精度范围内,若X是小于0的负实数,则返回-1;

{ //若x是大于0的正实数,则返回1;若x为0,则返回0

if(x<-(1e-8))

return -1;

return x>1e-8;

}

int main()

{

int i;

double a[300];

double sum=0;

for(i=2;sum<=5.20;i++)

{

sum+=(double)1/i;

a[i]=sum;

}

double flag;

cin>>flag;

while(flag!=0.00)

{

while(zero(flag)) //二分法在a表中查找不小于x的最少卡片数

{

int l,r;

l=0; //设定查找区间的左右指针

r=i;

while(l+1<r){

int mid=(l+r)/2; //计算查找的中间指针

if(zero(a[mid]-flag)<0) //若中间元素值小于x,则在右区间找

l=mid; //否则在左区间找

else r=mid;

}

cout<<r-1<<" card(s)"<<endl;

cin>>flag;

}

}

return 0;

}

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?