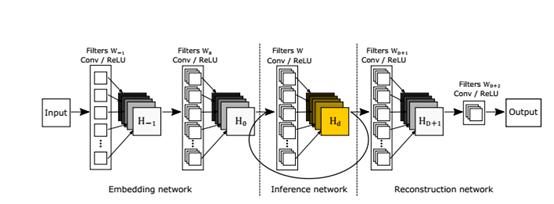

本文与之前的SRCNN不同,采用的是递归卷积网络。对于图像复原问题的操作问题,深度学习处理的时候时不使用pooling层。如果增加网络的深度,将增加更多的参数,则会导致两个问题:一是容易过拟合,二是模型过大,难以存储和重现。因此使用递归神经网络,然而由于梯度消失/爆炸导致不易收敛。因此提出了两种解决方法:一是每层的递归层都是监督式的;二是类似于残差网络,采用skip connection 结构。具体的结构图如下图所示:

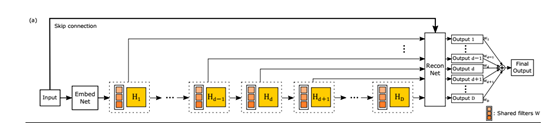

主要分为三个部分,第一部分是Embedding network,相当于SRCNN中的特征提取,二是Inference network,相当于特征的非线性变换,第三个是Reconstruction network,即特征图重建。其中的Inference network是一个递归网络,即数据循环地通过该层多次。将这个循环进行展开,就等效于使用同一组参数的多个串联的卷积层,如下图所示:

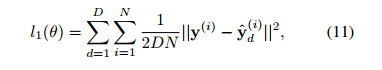

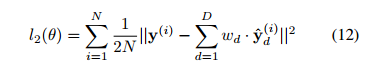

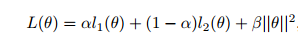

其中的H_1到H_D是D个共享参数的卷积层。DRCN将每一层的卷积结果都通过同一个Reconstruction Net得到一个重建结果,从而共得到D个重建结果,再把它们加权平均得到最终的输出。另外,受到ResNet的启发,DRCN通过skip connection将输入图像与H_d的输出相加后再作为Reconstruction Net的输入,相当于使Inference Net去学习高分辨率图像与低分辨率图像的差,即恢复图像的高频部分。最终的目标函数是一个多目标优化问题。除了每一个递归层的监督产生的误差还有最终效果的误差。

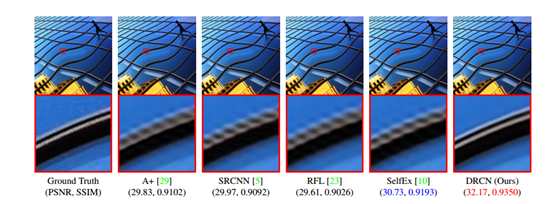

实验结果如下图所示:

参考:

http://cv.snu.ac.kr/research/DRCN/

https://zhuanlan.zhihu.com/p/25532538

586

586

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?