逻辑回归:

逻辑回归的因变量可以是二分类的,也可以是多分类的,但是二分类的更为常用,也更加容易解释,多类可以使用softmax方法进行处理。实际中最为常用的就是二分类的logistic回归。

hypothesis representation:

我们可以想到利用假设函数

y=h

θ

(x)

来预测分类,而普通的

h

θ

(x)

函数存在函数值大于1和小于0的情况,于是我们要构造特殊函数使

0≤h

θ

(x)≤1

。

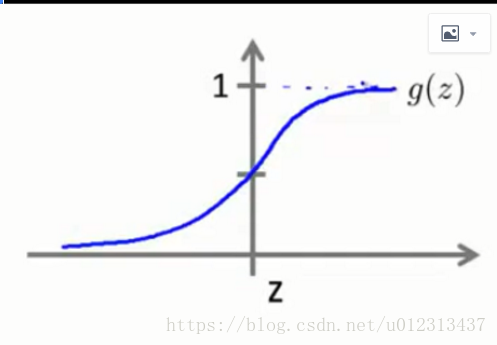

通常将z大于0时即g(z)大于0.5时预测y为1

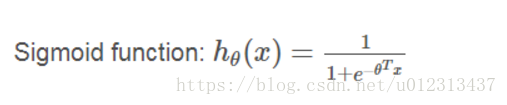

logistic function(Sigmoid function):

y=h

θ

(x)=g(θ

T

x)

假设函数代表了一种概率含义

h

θ

(x)=P(y=1|x;θ)

当x时y为1的概率

P(y=1|x;θ)+P(y=0|x;θ)=1

function g = sigmoid(z)

g = zeros(size(z));

g=1./(1+exp(-z));

end

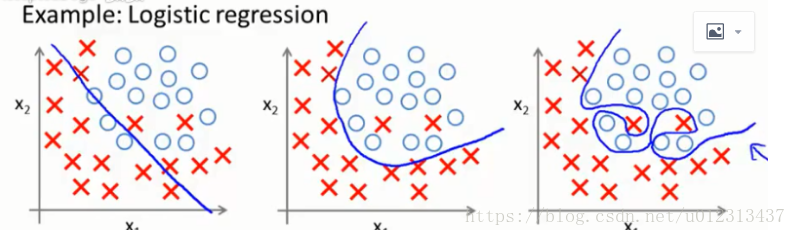

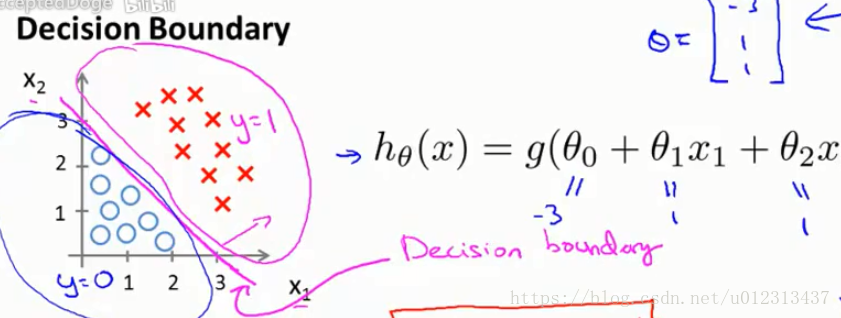

decision boundary (决策边界):

函数z将图像区域划分为两部分z大于0时g(z)大于0.5预测为1,反之预测为0.

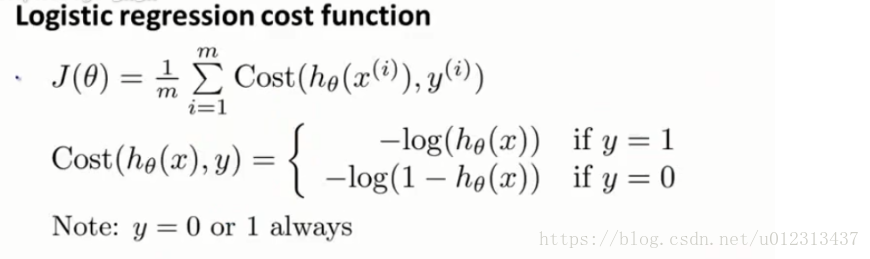

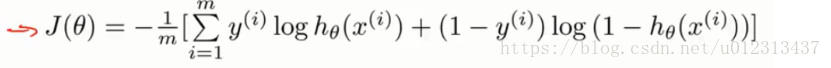

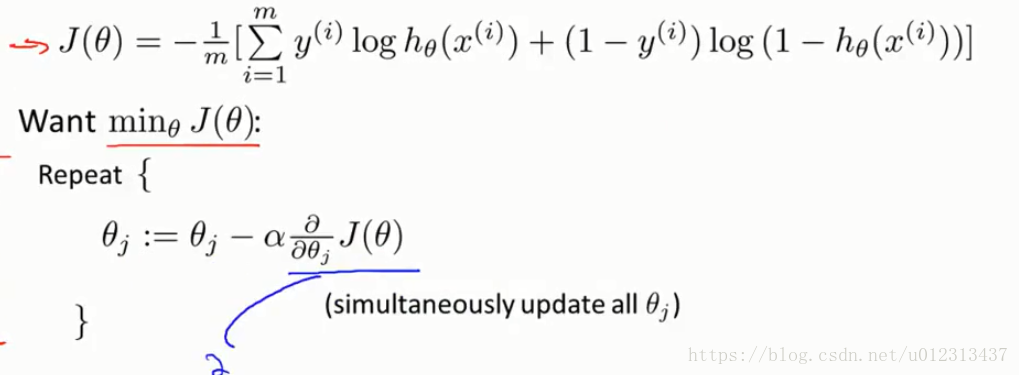

Cost Function :

将该公式简化为一个十字

Gradient Descent :

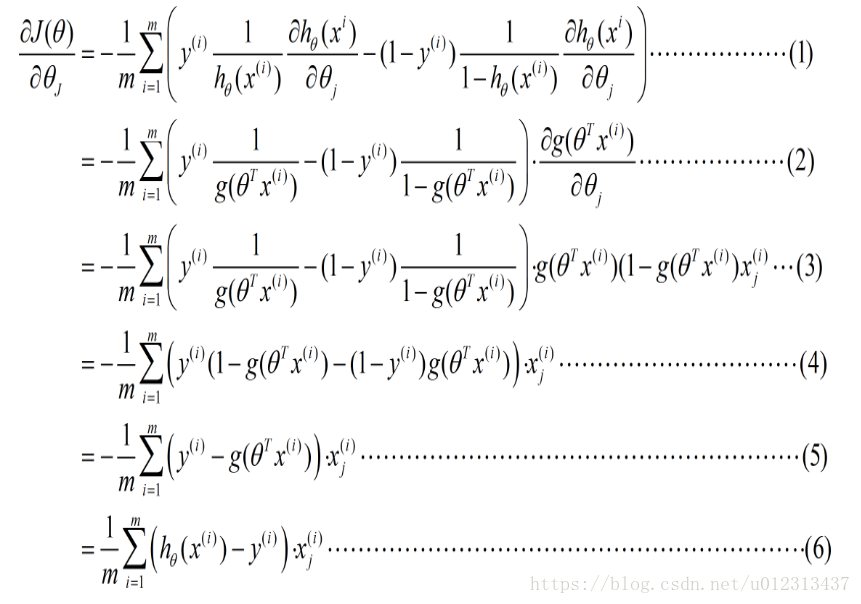

j的偏导推导过程如下

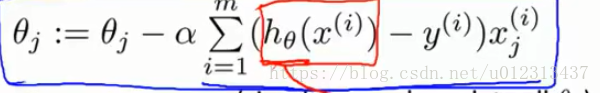

将上式带入梯度函数可得

function [J, grad] = costFunction(theta, X, y)

J = 0;

grad = zeros(size(theta));

J = 1/m*(-y'*log(sigmoid(X*theta)) - (1-y)'*(log(1-sigmoid(X*theta))));

grad = 1/m * X'*(sigmoid(X*theta) - y);

end

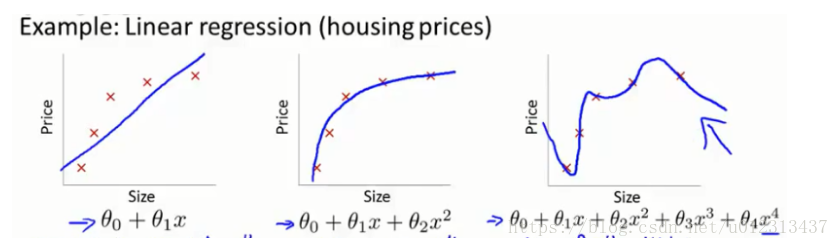

Overfitting and Underfitting

第一种称之为欠拟合,也叫高偏差,

第三种称之为过拟合,也叫高方差,在过拟合中,假设函数很好的匹配了训练集,但并不能很好的匹配测试集。

两种解决过拟合的方法:

1减少特征数。

包括人工选择和模型选择算法

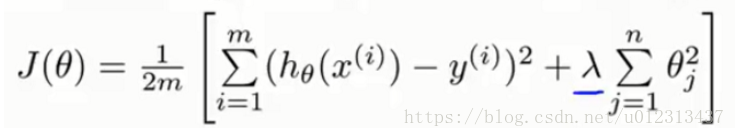

2正则化

保留所有特征

是部分theta尽量小

其中lamda为惩罚参数 过低会导致过拟合,过高会导致欠拟合

6830

6830

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?