先说结论:在CNN中,没有放缩和旋转的功能。

1. 什么是Spatial Transformer Layer

因为有pooling层的原因,所以有一点translation的功能。在下图中,通常情况下左右两个对于CNN来说是不一样的。

那么,Spatial Transformer Layer的功能是,想要学习一个层,能够对左图中的图片进行旋转和缩放。

2. How to work?

学习过程中,平移本质上来说就是调整权重的过程。

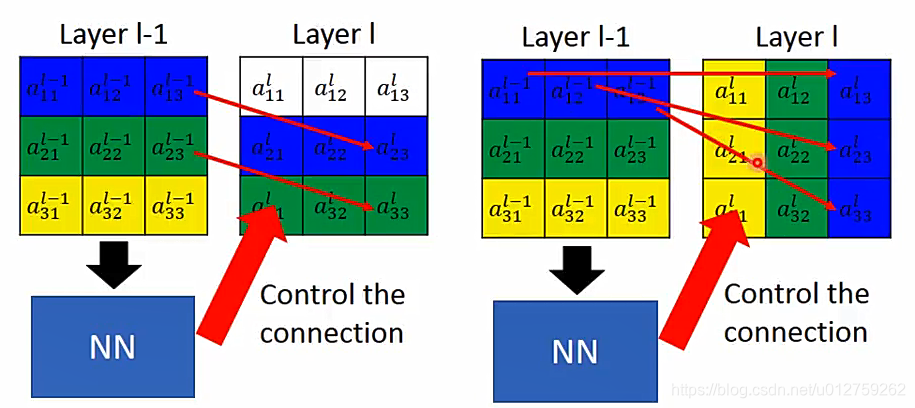

上图中,权重相同的颜色代表相同的权值。其目标是进行向下平移,具体公式如下:

举个栗子:

- 向下平移:把 a l 3 l − 1 a_{l3}^{l-1} al3l−1移动到 a l 23 a_{l}^{23} al23的位置,此时, a l 23 a_{l}^{23} al23与 a l 3 l − 1 a_{l3}^{l-1} al3l−1相对应, a l 23 a_{l}^{23} al23与左图中其他位置的连接权重均为0

- 向右旋转:把 a l 3 l − 1 a_{l3}^{l-1} al3l−1移动到 a l 33 a_{l}^{33} al33的位置,此时, a l 33 a_{l}^{33} al33与 a l 3 l − 1 a_{l3}^{l-1} al3l−1相对应, a l 33 a_{l}^{33} al33与左图中其他位置的连接权重均为0

那么,怎么实现这种变换呢?

通过一个全连接层实现:

2.1.1 对图片进行平移:

首先把图片中的每一个像素坐标化,矩阵

[

2

2

2

2

]

\begin{bmatrix} 2 &2 \\ 2 &2 \end{bmatrix}

[2222]

的作用是将其放大,

[

0

0

]

\begin{bmatrix} 0 \\ 0 \end{bmatrix}

[00]的作用是控制其是否进行平移操作。

2.1.2 对图片进行缩小

2.1.3 对图片进行旋转

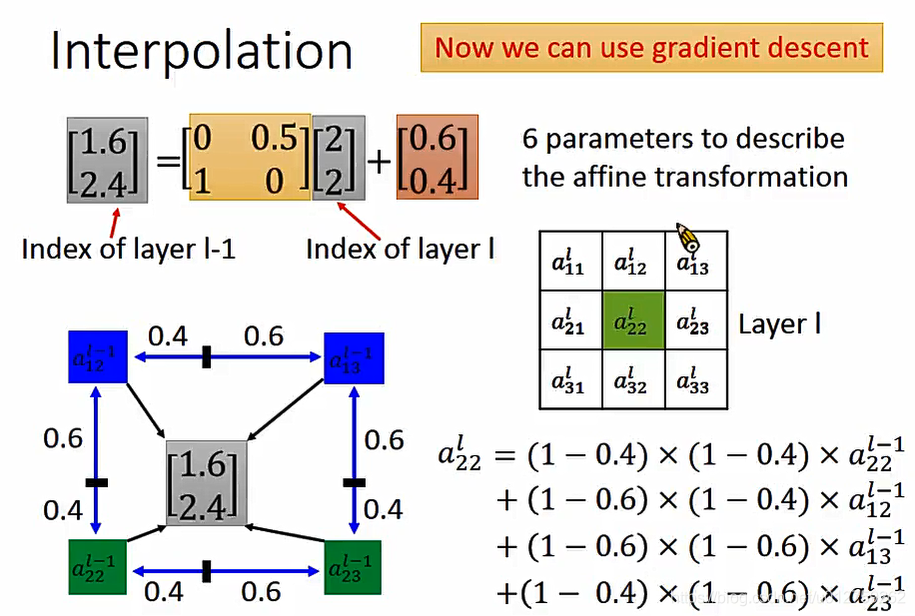

综上,Spatial Transformer Layer需要六个参数

但是,实际上在计算的过程中,如果

a

,

b

,

c

,

d

,

e

,

f

a,b,c,d,e,f

a,b,c,d,e,f的值如果是小数呢?在这样的情况下是没有办法进行可微分的操作的。因此,需要采用一种方法Interpolation操作。

3243

3243

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?