以前都是直接在linux上运行的,昨天配置eclipse连接hadoop,可以正常连接hdfs,但是运行mapreduce的时候就一直有错误,今天终于解决了。我也不知道为什么有这么多错误,我只写我能运行的步骤。

1. 我的hadoop是2.6版本的,就下hadoop-eclipse-plugin-2.6.0.jar,然后放到eclipse插件位置,重启eclipse。

2.在eclipse-window-perspective-open perspective-other,选择map/reduce。

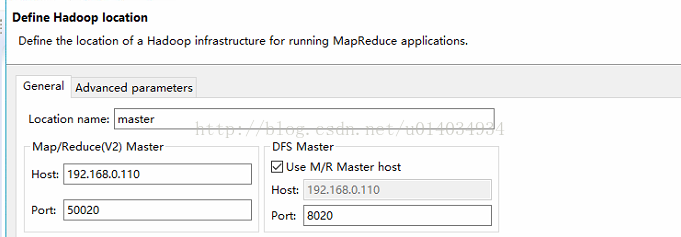

然后在map/reduce Locations中右键选择new hadoop location。

我的hadoop ha配置为:

<property>

<name>dfs.nameservices</name>

<value>myha</value>

</property>

<property>

<name>dfs.ha.namenodes.myha</name>

<value>nn1,nn2</value>

</property>

<property>

<name>dfs.namenode.rpc-address.myha.nn1</name>

<value>master:8020</value>

</property>

<property>

<name>dfs.namenode.rpc-address.myha.nn2</name>

<value>node1:8020</value>

master对应192.168.0.110。当然host是有配置的。user name的话我的就是自己计算机用户,我把权限关闭了:

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

3.window-perferences-hadoop map/reduce中选择hadoop目录。

hadoop目录就是把linux中的hadoop拉倒本地后的目录,我的是D:/hadoop。

然后下载了hadoop.dll和winutils.exe 64位的包,解压后的文件放到本地hadoop目录的bin目录下。

然后把hadoop.dll放到c:/windows/system32中。配置环境变量Path中加入hadoop目录的bin目录。

4.创建项目之后,把core-site.xml,hdfs-site.xml放到resource文件夹,创建mapreduce就可以运行了

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?