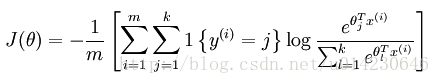

Caffe中的softmax loss可以看成最大似然估计

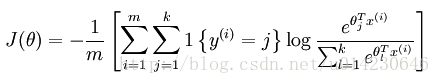

也可以从信息论的角度解释:即最小化估计分布与真实分布的差异。

学习Caffe(五)浅析softmax cross entropy loss与sigmoid cross entropy loss

最新推荐文章于 2023-12-28 21:58:13 发布

Caffe中的softmax loss可以看成最大似然估计

也可以从信息论的角度解释:即最小化估计分布与真实分布的差异。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?