PRML第二章啃到高斯分布的时候就开始不知所云了,看了这篇BlogPRML Chapter 2.3 The Gaussian Distribution之后,觉得讲的很清晰,可惜作者没有写完,于是转过去看了“Methods of Multivariate Analysis ”的第三章。这里是对这些基础知识点的一个记录,用来日后复习。

单变量和双变量

单变量的均值和方差

变量y的n个观察量

y 1 ,y 2 ,y 3 ,...,y n

,那么样本均值:

y ¯ =1n ∑ i=1 n y i

样本均值 y ¯ 永远不会等于变量y的总体均值 μ ,尽管随着样本数量的增加 y ¯ 会无限接近 μ 。 y ¯ 是 μ 的无偏估计量,因为 E(y ¯ )=μ,var(y ¯ )=σ 2 n

样本方差: s 2 =∑ n i=1 (y i −y ¯ )n−1

同理 s 2 是总体方差 σ 2 的无偏估计量

双变量的协方差和相关性

协方差

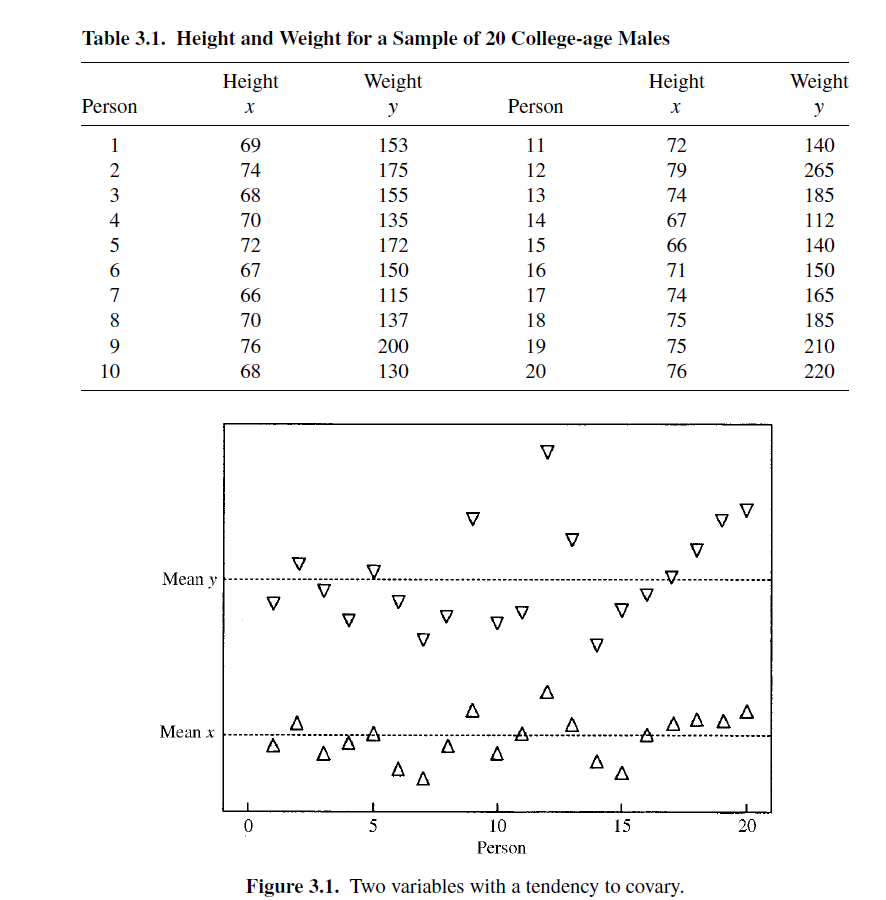

协方差表示两个变量之间的关系,下图中是一些身高和体重的样本数据

如果把样本用下边的图表示出来,可以发现当身高高于平均值的时候往往体重也会高于平均值,这两者之间可能存在一些相关

两个随机变量x和y之间的关系:

E(x+y)=E(x)+E(y)

E(xy)=E(x)E(y)x和y相互独立

如果变量x和y的联合概率密度可以表示为 p(x,y)=p(x)p(y) 那么变量x和y相互独立,二者相互独立也就是彼此不会相互影响

如果x和y相互独立,那么二者的协方差 σ xy =0 ;反之, 如果x,y的协方差 σ xy =0 则不能说明二者相互独立

σ xy =E(xy)−μ x μ y =E(x)E(y)−μ x μ y −μ x μ y =μ x μ y −μ x μ y =0

样本协方差:

s xy =∑ n i=1 (x i −x ¯ )(y i −y ¯ )n−1

s xy =∑ n i=1 x i y i −nx ¯ y ¯ n−1

s xy 永远也不会等于 σ xy ,前者是后者的无偏估计量

样本协方差矩阵只衡量二者之间的线性关系

两组样本的样本协方差为0表示这两组样本正交

相关性

从上边可以看出,如果把变量x和y的样本同时乘以一个系数,那么二者的协方差也会发生变化,由此可以看出协方差与尺度相关,于是引入总体相关性:

ρ=corr(x,y)=σ xy σ x σ y =E[(x−μ x )(y−μ y )]E(x−μ x ) 2 − − − − − − − − − √ E(y−μ y ) 2 − − − − − − − − − √

样本相关性:

r xy =s xy s x s y =∑ n i=1 (x i −x ¯ )(y i −y ¯ )∑ n i=1 (x i −x ¯ ) 2 ∑ n i=1 (y i −y ¯ ) 2 − − − − − − − − − − − − − − − − − − − − − − √

仔细看一下:这个式子是和两个向量之间的cos夹角是一致的,所以相关性衡量的也就是两个向量之间的cosine距离

cosθ=a ⃗ T b ⃗ (a ⃗ T a ⃗ )(b ⃗ T b ⃗ ) − − − − − − − − − √ =a ⃗ T b ⃗ ⏐a ⃗ ⏐⏐b ⃗ ⏐ =r xy

多变量

均值

向量

y ⃗

表示一个变量,对变量

y ⃗

取样n次:

y=⎛ ⎝ ⎜ ⎜ ⎜ ⎜ y i1 y i2 ...y ip ⎞ ⎠ ⎟ ⎟ ⎟ ⎟

整个数据矩阵:

Y=⎛ ⎝ ⎜ ⎜ ⎜ ⎜ y T 1 y T 2 ...y T n ⎞ ⎠ ⎟ ⎟ ⎟ ⎟ =⎛ ⎝ ⎜ ⎜ ⎜ ⎜ y 11 y 12 ...y 1p y 21 y 22 ...y 2p ............y n1 y n2 ...y np ⎞ ⎠ ⎟ ⎟ ⎟ ⎟

y ¯ T =1n j T Yy ¯ =1n Y T j

j是一个全1的向量

未完待续。。。

774

774

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?