我们在上一章中应用层HTTP的协议,这一章中,我们自顶而下,进入到我们下一层--传输层,来了解一下传输层的两种协议,其中包括我们最重要的TCP协议

再谈端口号

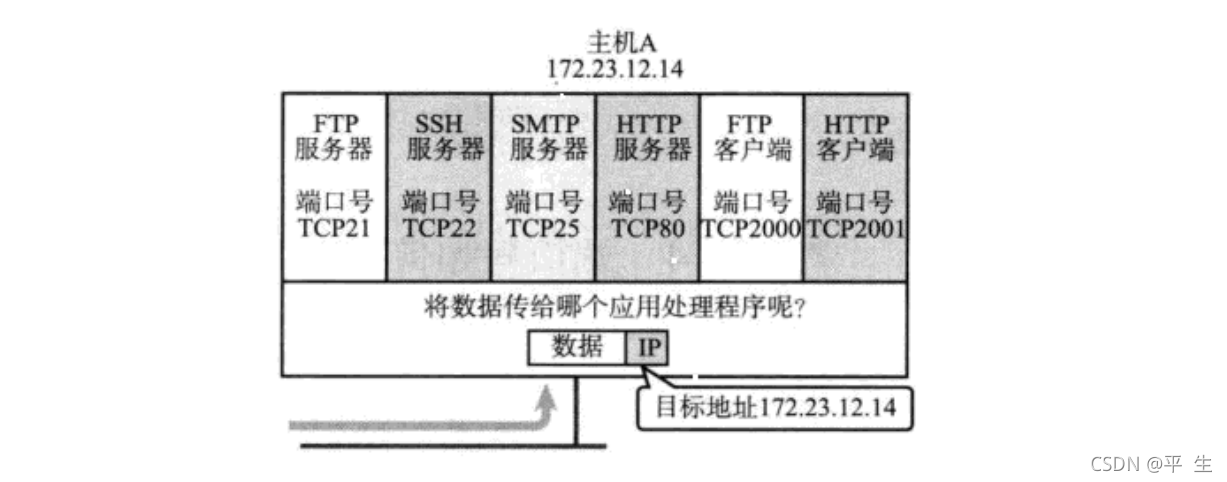

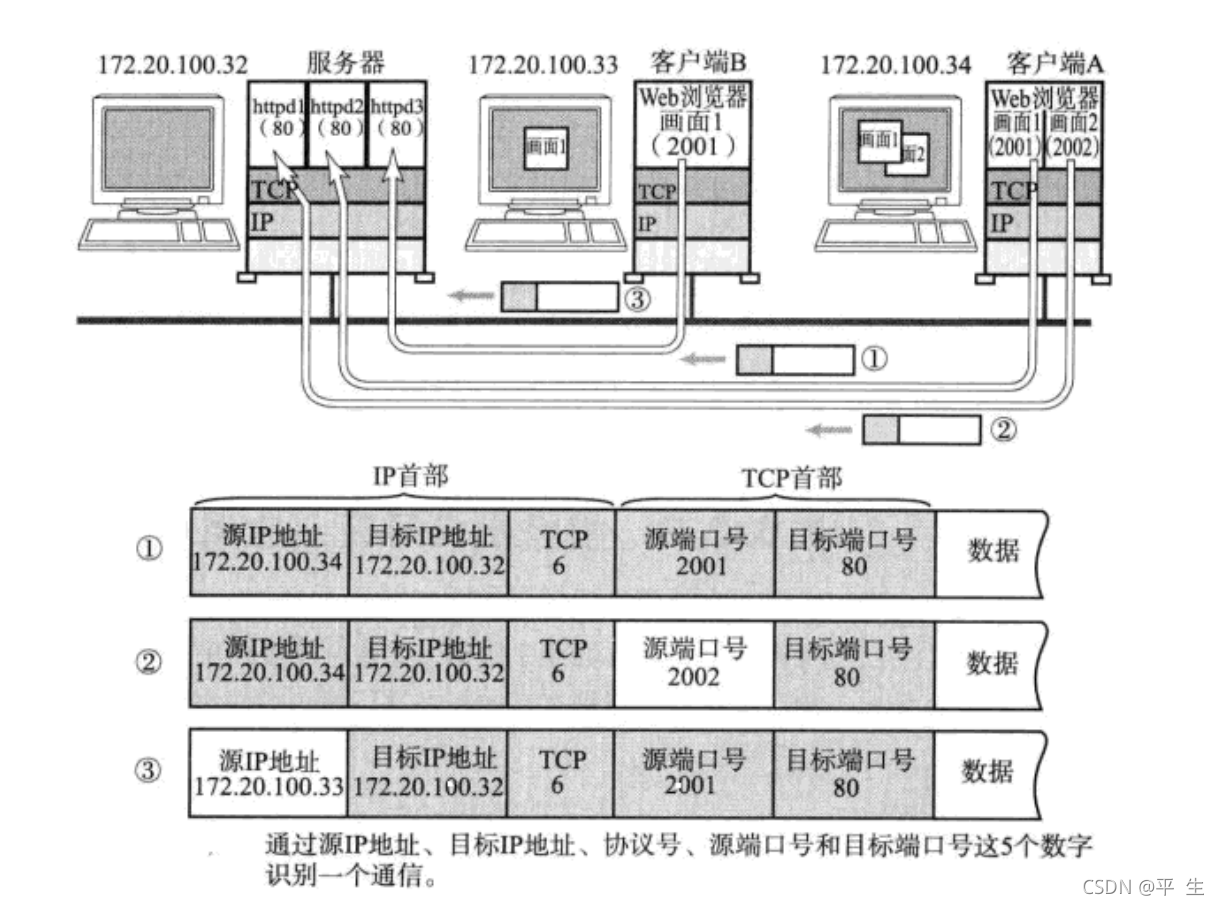

我们在这里对五元组来进行简单的介绍:端口号:标识另一台主机的一个进程,我们的内核通过哈希算法来对端口号与pid进行匹配源IP:发送数据的主机IP目的IP:最终接收数据的主机IP源端口号:发送数据主机中发送数据的进程目的端口号:最终接收数据主机中要接收数据的进程注意:源IP,目的IP,源端口号与目的端口号在传输过程中保持不变,只有MAC地址(表示网卡)会变

端口号范围划分

0 - 1023: 知名端口号 , HTTP, FTP, SSH 等这些广为使用的应用层协议 , 他们的端口号都是固定的1024 - 65535: 操作系统动态分配的端口号 . 客户端程序的端口号 , 就是由操作系统从这个范围分配的.

认识知名端口号

ssh 服务器 , 使用 22 端口ftp 服务器 , 使用 21 端口telnet 服务器 , 使用 23 端口http 服务器 , 使用 80 端口https 服务器 , 使用 443

我们这些服务器都是非常常用的,为了我们使用方便,人们约定一些常用的服务器,都是用以上这些固定的端口号

我们若想查看知名端口号,可以输入以下命令cat/etc/services

注意:我们自己写一个程序使用端口号时,需要避开这些知名端口号

网络的命令

netstat 是一个用来查看网络状态的重要工具 .语法 : netstat [ 选项 ]功能 :查看网络状态常用选项 :n 拒绝显示别名,能显示数字的全部转化成数字l 仅列出有在 Listen ( 监听 ) 的服務状态p 显示建立相关链接的程序名t (tcp) 仅显示 tcp 相关选项u (udp) 仅显示 udp 相关选项a (all) 显示所有选项,默认不显示 LISTEN 相关

在查看服务器的进程 id 时非常方便 .语法 : pidof [ 进程名 ]功能 :通过进程名 , 查看进程 id

ifconfig

作用:用于显示或者设置网络设备

telnet

作用:连接服务

UDP协议

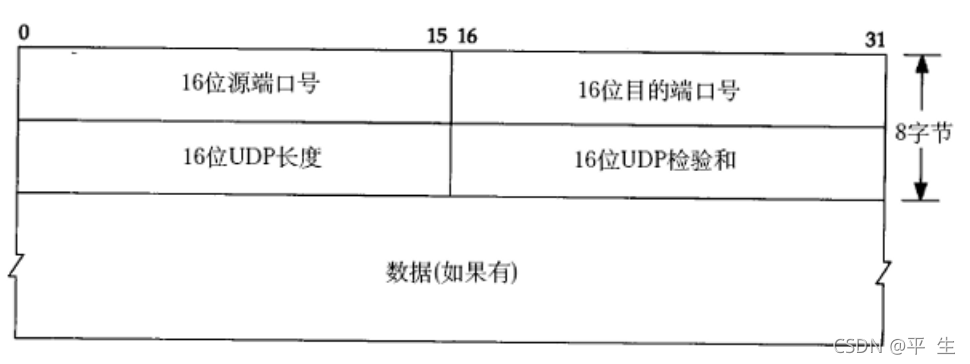

UDP协议端格式

16 位 UDP 长度 , 表示整个数据报 (UDP 首部 +UDP 数据 ) 的最大长度 ;如果校验和出错 , 就会直接丢弃

16位源端口号:发送数据的进程

16位目的端口号:接收数据的进程

16位UDP校验和:校验数据是否出错

我们通过之前的学习我们知道,在网络数据传输阶段,每经过一层都需要将报头与数据分离,而后交付给上层,那么在我们UDP中,数据是如何进行分离与交付的呢?

其实,我们通过UDP的结构就可以看出,UDP的报头定长为8个字节,我们可以将报头的16位UDP长度减去8来进行分离,余下的部分就是我们的数据,而后我们通过识别目的端口号去匹配应用层进程进行交付

UDP的特点

无连接 : 知道对端的 IP 和端口号就直接进行传输 , 不需要建立连接 ;不可靠 : 没有确认机制 , 没有重传机制 ; 如果因为网络故障该段无法发到对方 , UDP 协议层也不会给应用层返回任何错误信息;面向数据报 : 不能够灵活的控制读写数据的次数和数量

面向数据报

如果发送端调用一次 sendto, 发送 100 个字节 , 那么接收端也必须调用对应的一次 recvfrom, 接收 100 个字节; 而不能循环调用 10 次 recvfrom, 每次接收 10 个字节

UDP的缓冲区

UDP 没有真正意义上的 发送缓冲区 . 调用 sendto 会直接交给内核 , 由内核将数据传给网络层协议进行后续的传输动作;UDP 具有接收缓冲区 . 但是这个接收缓冲区不能保证收到的 UDP 报的顺序和发送 UDP 报的顺序一致 ; 如果缓冲区满了, 再到达的 UDP 数据就会被丢弃 ;

UDP使用注意事项

我们注意到 , UDP 协议首部中有一个 16 位的最大长度 . 也就是说一个 UDP 能传输的数据最大长度是 64K( 包含 UDP 首部).然而 64K 在当今的互联网环境下 , 是一个非常小的数字 .如果我们需要传输的数据超过 64K, 就需要在应用层手动的分包 , 多次发送 , 并在接收端手动拼装

基于UDP的应用层协议

NFS: 网络文件系统TFTP: 简单文件传输协议DHCP: 动态主机配置协议BOOTP: 启动协议 ( 用于无盘设备启动 )DNS: 域名解析协议

TCP协议

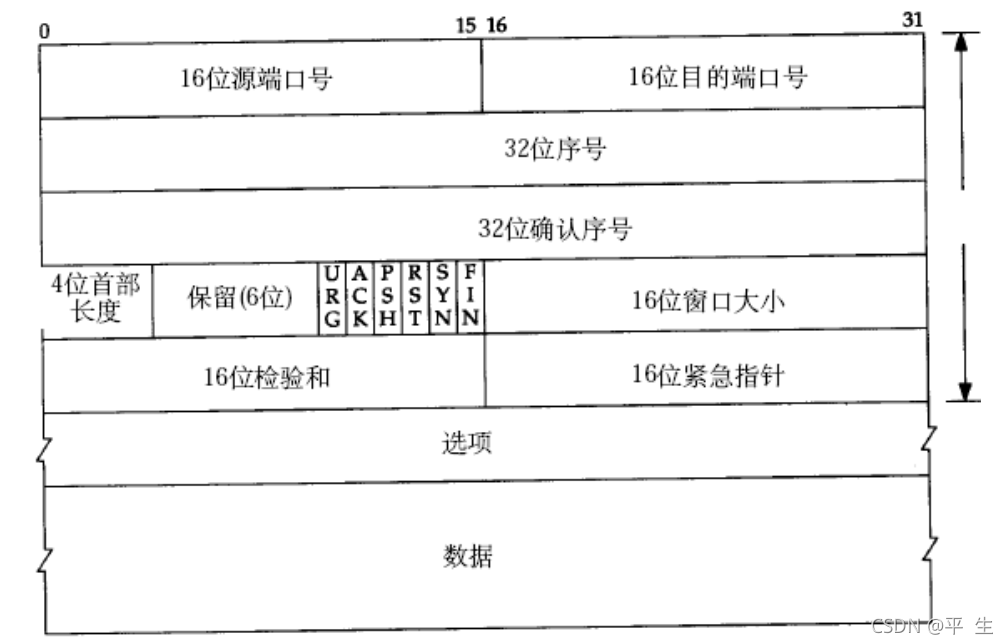

TCP协议段格式

我们可以看到,TCP协议相对于UDP协议而言要复杂的多,相对而言,因为其机制的复杂性,也使TCP协议进行传输数据时更加的安全可靠

16位端口号/目的端口号:表示数据从哪个进程来,到那个进程去

32位序列号:因为我们的TCP传输是按字节流以字节为单位发送数据,所以我们发送数据时是大量的数据同时发送,但是我们的不同的数据可能会因为各种原因到达服务器的顺序不同,如果服务器按照到达顺序来对数据进行接收的话,则可能会因为数据顺序错误而导致最终数据错误,所以我们的TCP为了保证数据有序,会将发送的字节进行数据编号,接收方在接收到顺序之后,虽然可能接受的顺序是错误的,但是只要根据序列号进行重新排列,就可以对数据顺序进行复原,随后放到缓冲区中进行下一步,我们的序列号保证了数据的有序性

32位确认序号:我们的确认序号是指接收端在收到数据后向发送方确认应答时,返回确认序号中的序号,确认序号会在原始的序号上+1,目的是告诉发送方再次序列号之前的数据我收到了,下一回你发送的数据应该从这里开始

注意:我们的发送端进行数据的发送时,一次会发很多数据,会有许多的序列号,但是在接收端接收到数据时,只会应答一个确认的序列号,其实理论上都应该应答,但是由于内核中是采用滑动窗口的方式来进行高效确认的,所以我们只需要传最新的一条确认序列号就可以了,当确认序列号返回最新的序列号时,则代表之前的都已经收到,可以大大增加效率

为什么我们会同时有序列号与确认序列号呢?都采用一种序列号不就好了吗?

事实上,原因在于我们的TCP是一种全双工的传输方式,在传输的同时也可以进行接收数据,我们如果都使用序列号,那么此时接收方与发送方都需要对这个序列号进行修改,就会很麻烦,而我们采用两种序列号,当发送数据时,只需要关心序列号即可,当接收数据时,只需要关心确认序列号即可,这样就可以同时兼顾发送与接收的操作

4位首部长度:表示TCP报头有多少个32bit位(4字节),由于当前位只有4位,所以TCP最大长度为15*4=60字节,最小长度为20位,多余20字节的使用选项空间

注意:我们的TCP因为是按照字节流读取的,所以正文长度无需知道,挨个字节读即可

6位标志位:

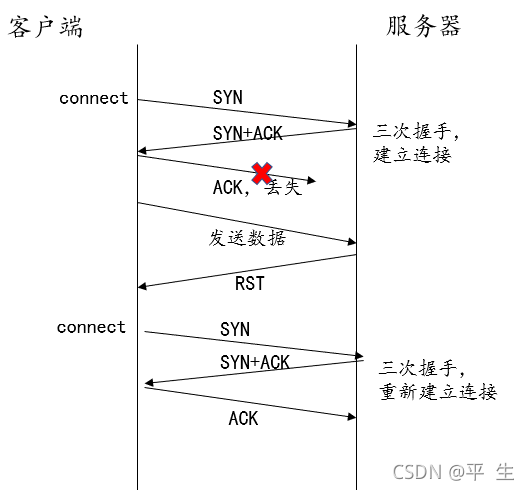

URG: 紧急指针是否有效ACK: 确认号是否有效PSH: 提示接收端应用程序立刻从 TCP 缓冲区把数据读走RST: 对方要求重新建立连接 ; 我们把携带 RST 标识的称为 复位报文段比如:当我们三次握手建立连接最后一次ACK丢失时,客户端认为已经建立链接,进行数据的传输 ,服务器因为没有收到链接,所以会给客户端发送一个RST响应,当客户端收到RST响应时,则知道了自己并未成功建立连接,而后重新进行连接 但是当客户端在中途断开连接,服务器发送数据,客户端认为未连接,向服务器发送RST,此时服务器就会认为不需要进行链接了,自动断开连接SYN: 请求建立连接 ; 我们把携带 SYN 标识的称为 同步报文段FIN: 通知对方 , 本端要关闭了 , 我们称携带 FIN 标识的为 结束报文段

但是当客户端在中途断开连接,服务器发送数据,客户端认为未连接,向服务器发送RST,此时服务器就会认为不需要进行链接了,自动断开连接SYN: 请求建立连接 ; 我们把携带 SYN 标识的称为 同步报文段FIN: 通知对方 , 本端要关闭了 , 我们称携带 FIN 标识的为 结束报文段16位窗口:我们可以设想这样一种情况,因为我们的数据都是先存放在缓冲区的,发送方不断发送数据,接收方处理数据的速度较慢,接收方缓冲区就会被慢慢填满,而此时如果发送方继续发送数据,数据则会丢失,这样显然是不行的,所以我们会进行流量控制,发送方发送数据时会将自己(发送方)的剩余接受量填入到16位窗口中,如果超过了高水位线,则会通知对方将数据发送的慢一点,这里有一个值得注意的点,缓冲区剩余空间填的是发送方的,因为对方会有应答ACK,这里面存的是对方的剩余接受量,相互发送自己的完成数据的的交互

16位检验和:发送端填充CRC校验,接收端如果校验有问题,就会认为数据是有问题的,进行重传,这其实是为了提高安全性

CRC校验:其实就是对数据进行一层模运算的验证,这个模运算不会出现余数,若出现余数,则证明错误

16位紧急指针:插队型数据,紧急数据会被优先执行,6位标志位中的URG标识位如果为1,则说明该数据较为紧急,不过只能标识一字节的数据

选项:我们知道,报头最少为20字节,剩余的部分则为选项选项最多有40字节

由上面这些结构我们可以发现TCP解决了最重要的两个问题:

1.丢包:确认应答ACK与确认序号解决

2.乱序:32位序号解决

tcp协议特点

有链接:我们不仅需要知道对方的IP地址与端口号,还需要建立连接

可靠:TCP协议中具有确认机制与重传机制,会对数据进行检测,若错误或丢失,则会进行重传

面向字节流:数据是以字节流的形式发送的,减少了整段数据损失的可能性

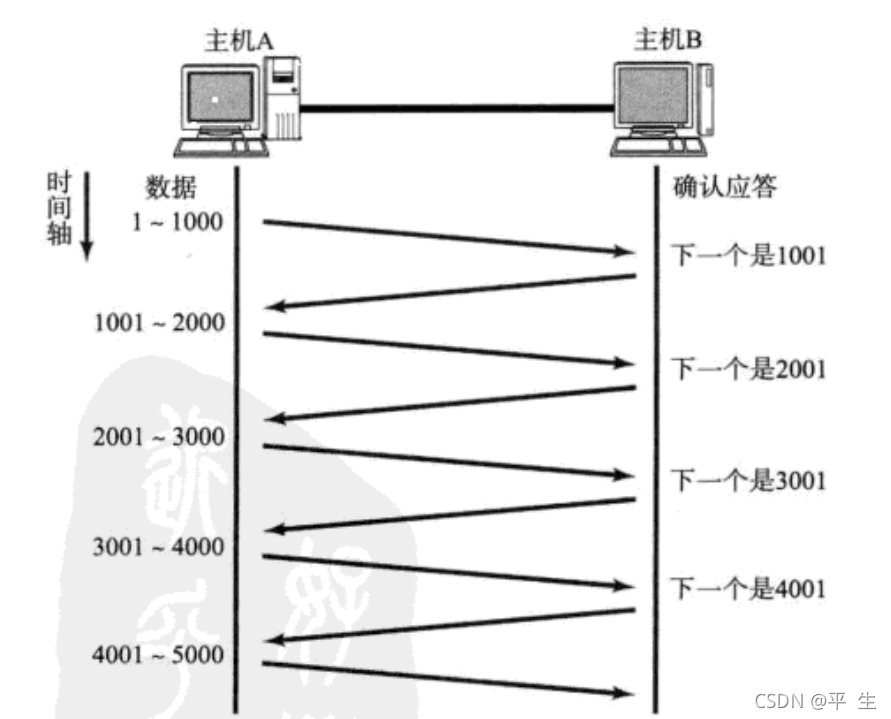

确认应答(ACK)机制

TCP将每个字节的数据都进行了编号. 即为序列号

每一个ACK都带有对应的确认序列号, 意思是告诉发送者, 我已经收到了哪些数据; 下一次你从哪里开始发

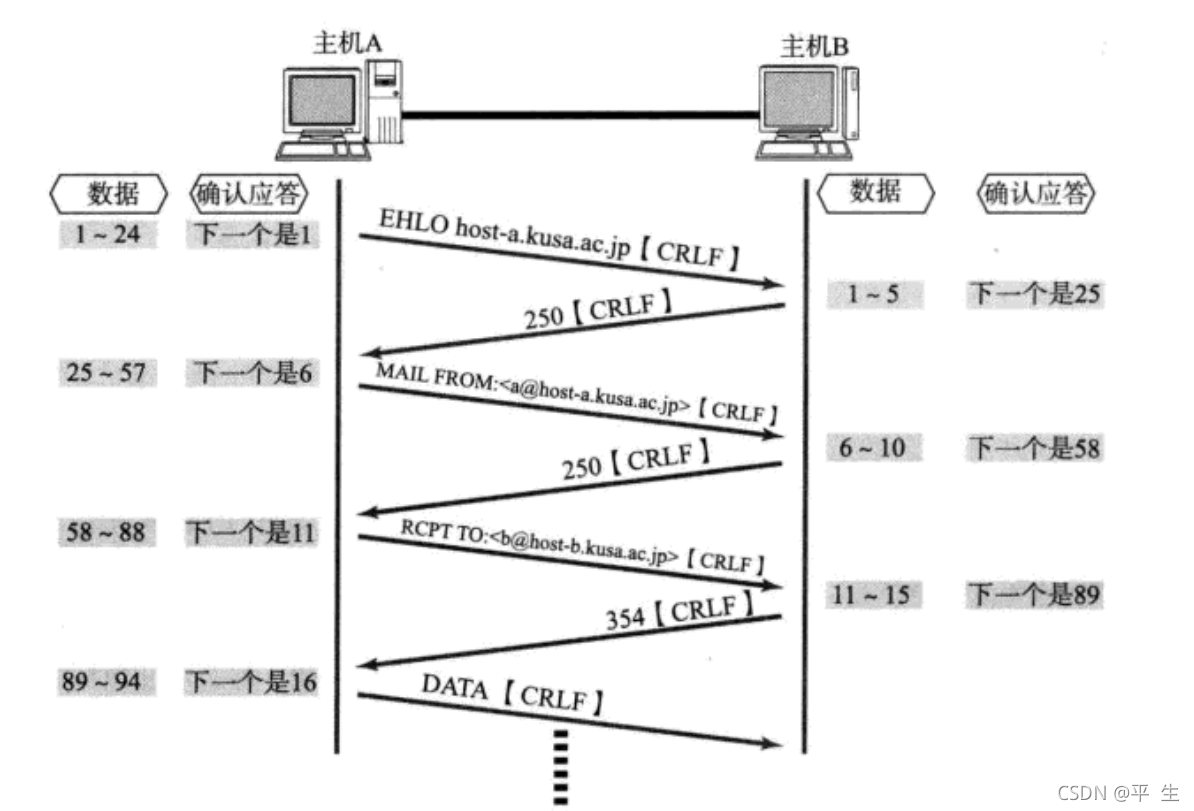

其实我们的客户端与服务器在发送数据后,是不能知道自己发送的数据是否成功的,那么我们为了保证数据发送的安全性,确保数据不会丢失,所以我们的服务器与客户端采用了ACK应答机制来确保数据的成功发送

我们的客户端在给服务器发送数据,当客户端成功接收到数据,则会再给客户端发送一条信息,就是我们的ACK应答,并告知下一个数据字段的起始位置,当客户端接收到ACK时,就知道自己上一条信息成功发送了,再根据ACK提供的下段序列号,来进行下一次数据的传输

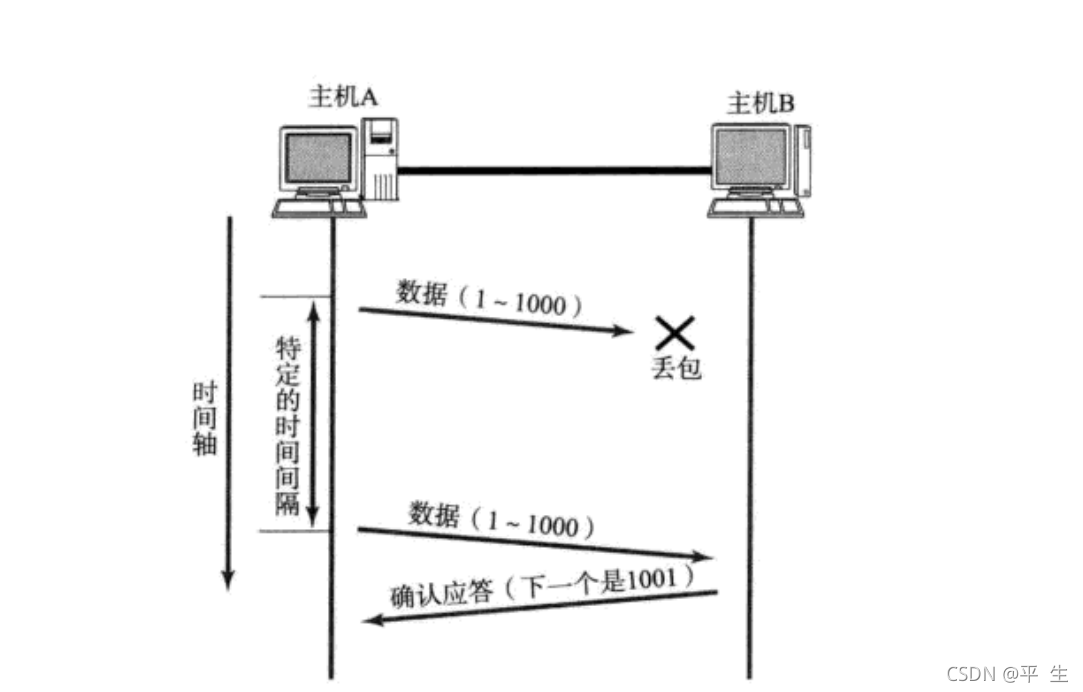

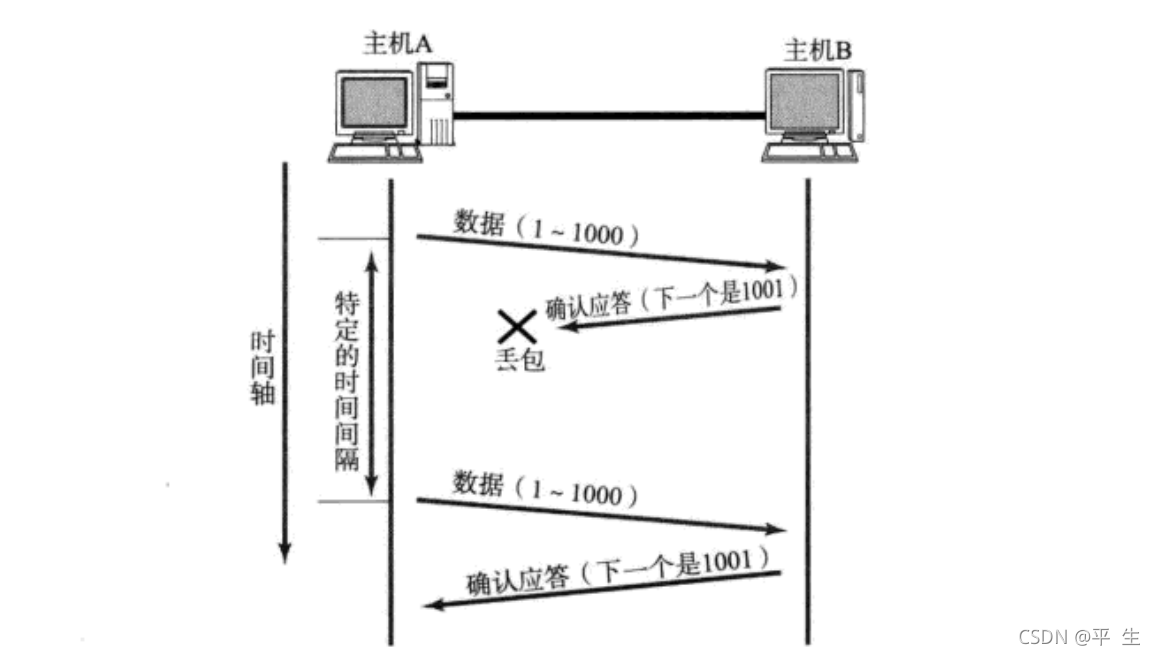

超时重传机制

主机 A 发送数据给 B 之后 , 可能因为网络拥堵等原因 , 数据无法到达主机 B;如果主机 A 在一个特定时间间隔内没有收到 B 发来的确认应答 , 就会进行重发

最理想的情况下 , 找到一个最小的时间 , 保证 " 确认应答一定能在这个时间内返回 ".但是这个时间的长短 , 随着网络环境的不同 , 是有差异的 .如果超时时间设的太长 , 会影响整体的重传效率 ;如果超时时间设的太短 , 有可能会频繁发送重复的包 ;

Linux 中 (BSD Unix 和 Windows 也是如此 ), 超时以 500ms 为一个单位进行控制 , 每次判定超时重发的超时时间都是500ms 的整数倍 .如果重发一次之后 , 仍然得不到应答 , 等待 2*500ms 后再进行重传 .如果仍然得不到应答 , 等待 4*500ms 进行重传 . 依次类推 , 以指数形式递增 .累计到一定的重传次数 , TCP 认为网络或者对端主机出现异常 , 强制关闭连接

连接管理机制

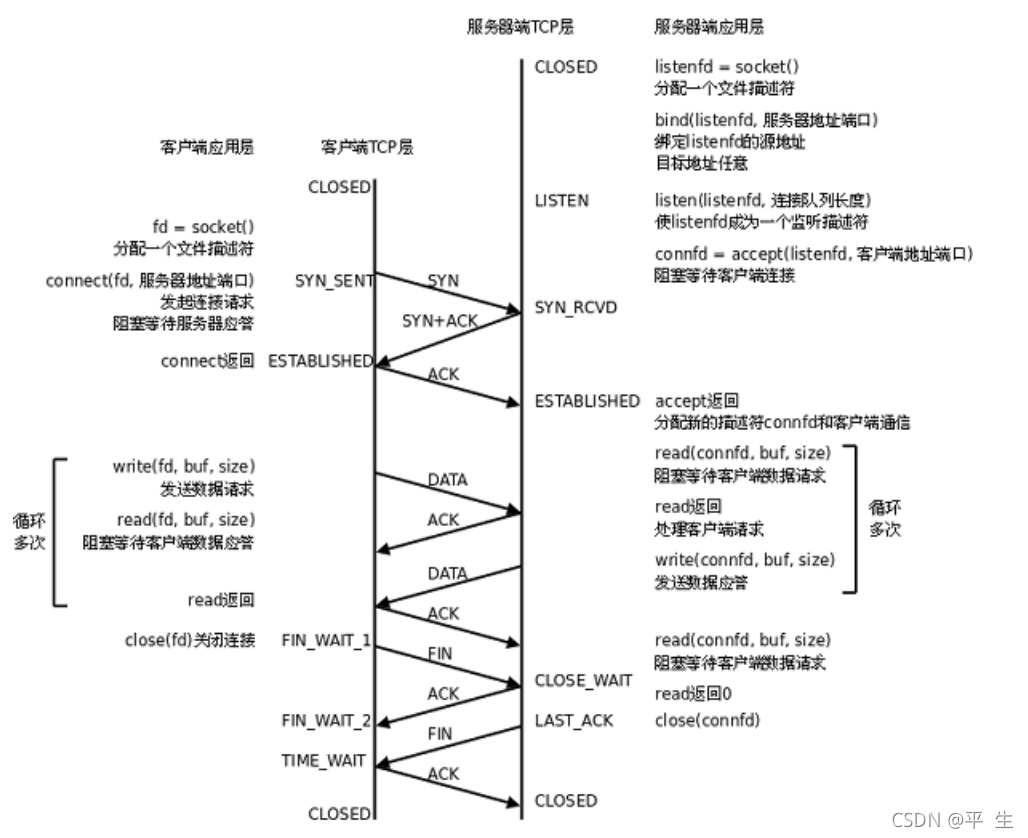

我们根据上图来对数据的建立连接与断开连接进行复盘

客户端调用connect系统向服务器端建立连接。

客户端和服务端状态变化:

服务器必须是从CLOSED->LISTEN(监听)等待客户端连接,调用(listen接口)。

客户端发起连接(调用connect接口),状态由CLOSED->SYN_SENT(同步发送),发送同步报文SYN。

服务器接到连接请求状态由LISTEN->SYN_RCVD(同步发送),将该连接放入内核等待队列中,并向客户端发送SYN+ACK压缩报文。

客户端收到响应,状态由SYN_SENT->ESTABLISHED(连接建立),可以开始发送或者接收数据,并向服务器发送ACK应答报文。

服务器接到响应,状态由SYN_RCVD->ESTABLISHED(连接建立),可以进行发送和接收数据。至此,连接建立完成。

客户端发起断开连接请求,客户端状态由ESTABLISHED->FIN_WAIT1,服务器发送结束报文段(FIN)。

服务器端收到客户端的关闭请求,服务器端状态由ESTABLISH->CLOSE_WAIT,并返回确认报文段(ACK)。

客户端收到服务器的响应,客户端状态由FIN_WAIT1->FIN_WAIT2。

服务器发起断开连接请求,服务器状态由CLOSE_WAIT->LAST_ACK,进入CLOSE_WAIT后说明服务器准备关闭连接(需要处理完之前的数据),当服务器真正调用close关闭连接时,服务器发送FIN,此时服务器会进入LAST_ACK状态,等待最后一个ACK到来。

客户端收到服务器的断开连接请求,状态由FIN_WAIT2->TIME_WAIT,向服务器端发送ACK。

服务器收到客户端的响应,状态由LAST_ACK->CLOSED,断开连接,释放连接资源。

客户端最后状态由TIME_WAIT->CLOSED,等待2*MSL(报文最大生存时间),最后进入CLOSED,断开连接,释放连接资源。

这里我们有两个问题需要关注一下:

1:为什么一定是三次握手才建立连接?

其实我们逆向的想一想就可以理解的,当一次握手完成,此时客户端认为连接完成,但无法确定服务器是否连接成功,当两次握手完成,服务器认为连接完成,顺便还为数据的传输准备了空间,资源,消耗了时间,但是这个ACK是可能在网络阻塞中丢失的,如果丢失,则服务器开辟的空间都会浪费,这大大的增加了服务器的连接成本,但是如果进行了3次握手,则有两个好处,1.最小成本完成全双工。2,不会使服务器进行误判,减少服务器无效资源开辟的浪费。其实按照道理来讲,我们不论建立多少次握手,在最后一个握手都是有可能丢失的,但是丢失握手的发送方都会认为连接成功建立,为其开辟资源,这里就有一个很重要的问题了,如果将锅甩给服务器,服务器在同时是可能与多个客户端进行连接通信等的,此时如果频繁出现丢包,服务器资源被大量浪费,就会产生问题,但是我们将最后一次ACK换到客户端这边,即使最后一次发送丢失了,也不会影响服务器,更加安全

2.为什么是4次挥手才断开连接?

因为发送端需要断开连接,接收端也需要断开连接,由确认应答机制,每一次断开链接都需要进行两次数据的传输

CLOSING状态:同时关闭

当一端发送了FIN没有收到相应的ACK,但是收到对方的FIN,并相应ACK,在收到ACK之前,该端就会处于CLOSING状态,直到收到ACK,才会处于TIME_WAIT状态

由于超时重传机制,在未收到ACK的一段时间后,会重传FIN,但是超过一定次数还是没有收到ACK则会直接断开连接

四次挥手TIME_WAIT状态

TIME_WAIT状态是主动发起断开的那一方会进入的

TIME_WAIT状态形成的时机:是在发送端主动发起断开连接,发送完FIN收到ACK后进入的状态

TIME_WAIT的作用:1.等待数据的消散。2.保证最后一次ACK被对方收到,进而让服务器释放连接的资源

我们最后一次挥手时发送的ACK可能会丢失在网络中,导致服务器不能完全断开连接,我们是需要保证服务器可以正常进行运转的,

假设客户端主动发起的连接,进入TIME_WAIT状态,此时服务器没有收到ACK,由于超时重传机制,会重传FIN,如果仍然没有收到ACK(1种可能,网络状况不好,FIN丢失或者阻塞在网络。另外一种情况,TIME_WAIT等待时间过了,客户端已经断开连接),服务器发送FIN到达一定次数会直接断开连接

TCP中规定当主动断开连接的一方处于TIME_WAIT状态时,会等待两个MSL(报文最大生存时间),才会回到CLOSE状态,原因是为了等待最后一个ACK顺利到达,如果丢失,服务器则会重新发送,客户端就会收到FIN,虽然也可能丢失,但是连续两次丢失的概率会小的很多。

TIME_WAIT状态解决:我们可以试想这样一种情景,

服务器需要处理非常大量的客户端的连接 ( 每个连接的生存时间可能很短 , 但是每秒都有很大数量的客户端来请求).这个时候如果由服务器端主动关闭连接 ( 比如某些客户端不活跃 , 就需要被服务器端主动清理掉 ), 就会产生大量TIME_WAIT 连接 .由于我们的请求量很大 , 就可能导致 TIME_WAIT 的连接数很多 , 每个连接都会占用一个通信五元组 ( 源 ip,源端口, 目的 ip, 目的端口 , 协议 ). 其中服务器的 ip 和端口和协议是固定的 . 如果新来的客户端连接的 ip 和端口号和TIME_WAIT 占用的链接重复了 , 就会出现问题

四次挥手CLOSE_WAIT状态

CLOSE_WAIT状态转变为LAST_ACK,需要应用层调用close接口关闭套接字,如果进程一直属于CLOSE_WAIT状态,则说明应用层之间有bug,未关闭套接字,需要对代码进行加上close关闭接口

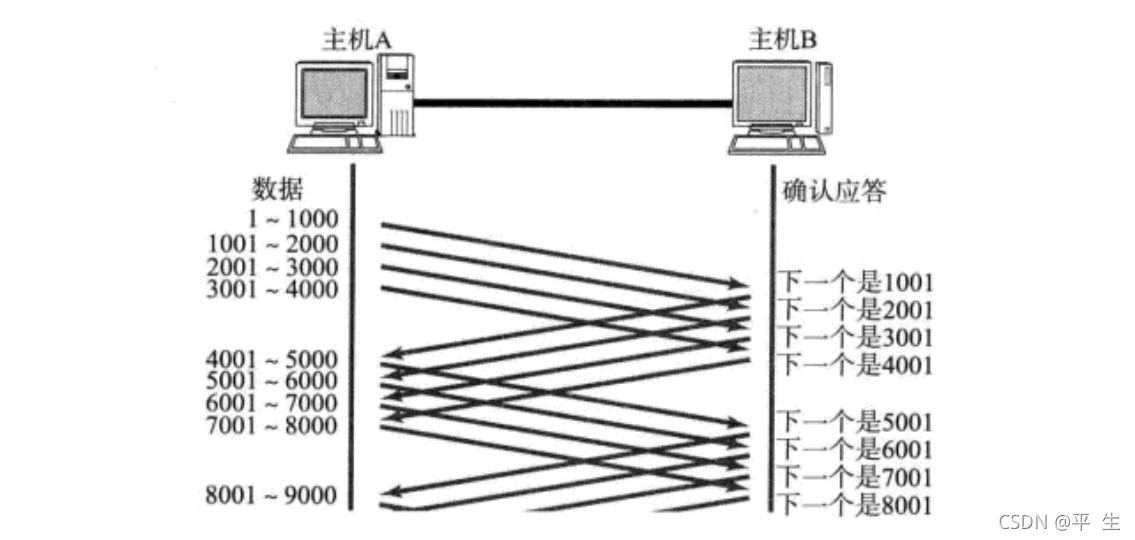

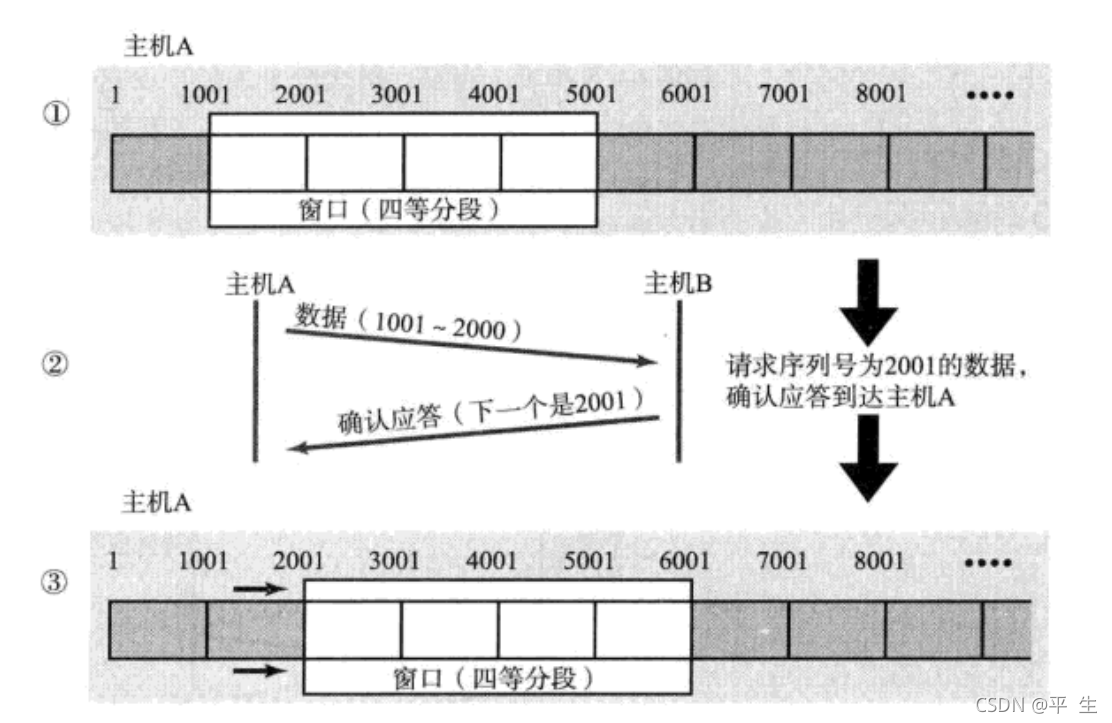

滑动窗口

窗口大小指的是无需等待确认应答而可以继续发送数据的最大值 . 上图的窗口大小就是 4000 个字节 ( 四个段).发送前四个段的时候 , 不需要等待任何 ACK, 直接发送 ;收到第一个 ACK 后 , 滑动窗口向后移动 , 继续发送第五个段的数据 ; 依次类推 ;操作系统内核为了维护这个滑动窗口 , 需要开辟 发送缓冲区 来记录当前还有哪些数据没有应答 ; 只有确认应答过的数据, 才能从缓冲区删掉 ;窗口越大 , 则网络的吞吐率就越高 ;

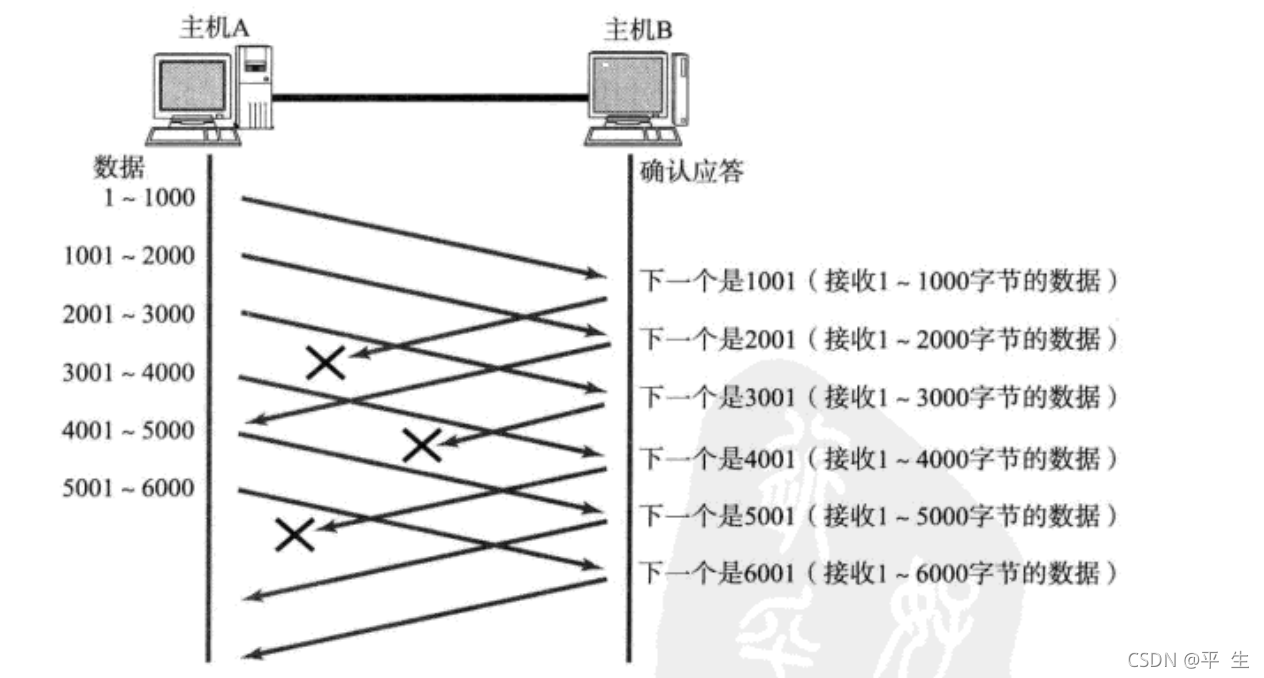

那么如果出现了丢包, 如何进行重传? 这里分两种情况讨论

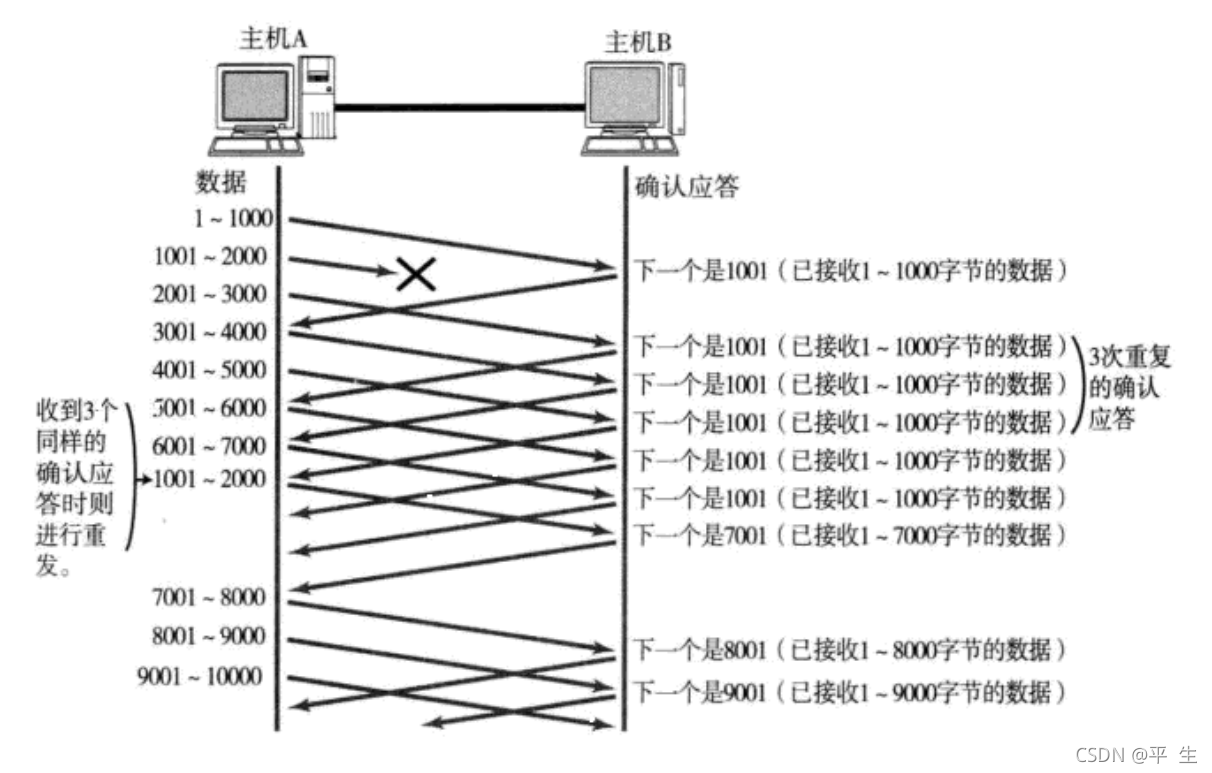

这种情况下, 部分ACK丢了并不要紧, 因为可以通过后续的ACK进行确认;

当某一段报文段丢失之后 , 发送端会一直收到 1001 这样的 ACK, 就像是在提醒发送端 " 我想要的是 1001"一样;如果发送端主机连续三次收到了同样一个 "1001" 这样的应答 , 就会将对应的数据 1001 - 2000 重新发送 ;这个时候接收端收到了 1001 之后 , 再次返回的 ACK 就是 7001 了 ( 因为 2001 - 7000) 接收端其实之前就已经收到了, 被放到了接收端操作系统内核的 接收缓冲区 中

与超时重传机制的区别:

- 超时重发没有收到响应一段时间会重发数据。很明显快重发效率更高,拿为什么还需要有超时重发。

- 当发送报文数小于3时,快重发不起效。

流量控制

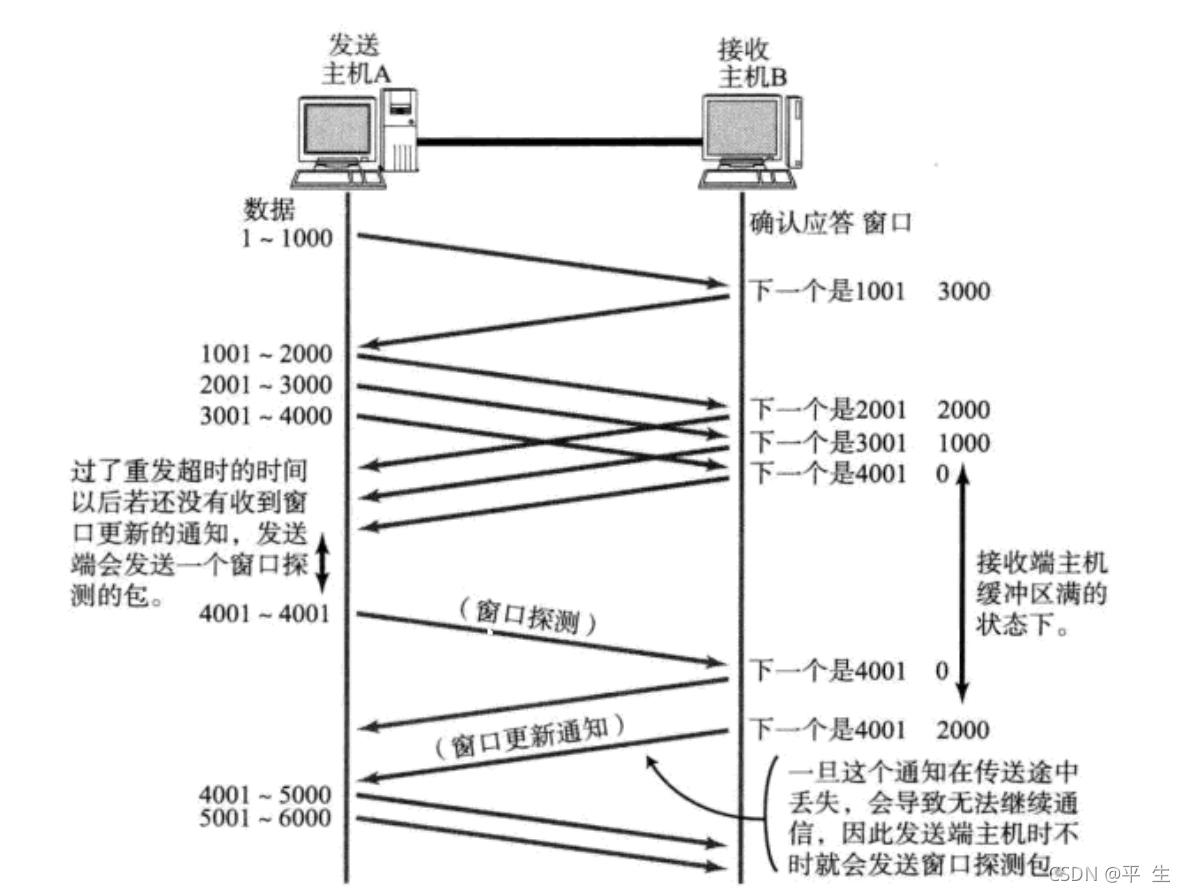

接收端将自己可以接收的缓冲区大小放入 TCP 首部中的 " 窗口大小 " 字段 , 通过 ACK 端通知发送端 ;窗口大小字段越大 , 说明网络的吞吐量越高 ;接收端一旦发现自己的缓冲区快满了 , 就会将窗口大小设置成一个更小的值通知给发送端 ;发送端接受到这个窗口之后 , 就会减慢自己的发送速度 ;如果接收端缓冲区满了 , 就会将窗口置为 0; 这时发送方不再发送数据 , 但是需要定期发送一个窗口探测数据段, 使接收端把窗口大小告诉发送端

接收端如何把窗口大小告诉发送端呢 ? 回忆我们的 TCP 首部中 , 有一个 16 位窗口字段 , 就是存放了窗口大小信息 ;那么问题来了 , 16 位数字最大表示 65535, 那么 TCP 窗口最大就是 65535 字节么 ?实际上 , TCP 首部 40 字节选项中还包含了一个窗口扩大因子 M, 实际窗口大小是 窗口字段的值左移 M 位 ;

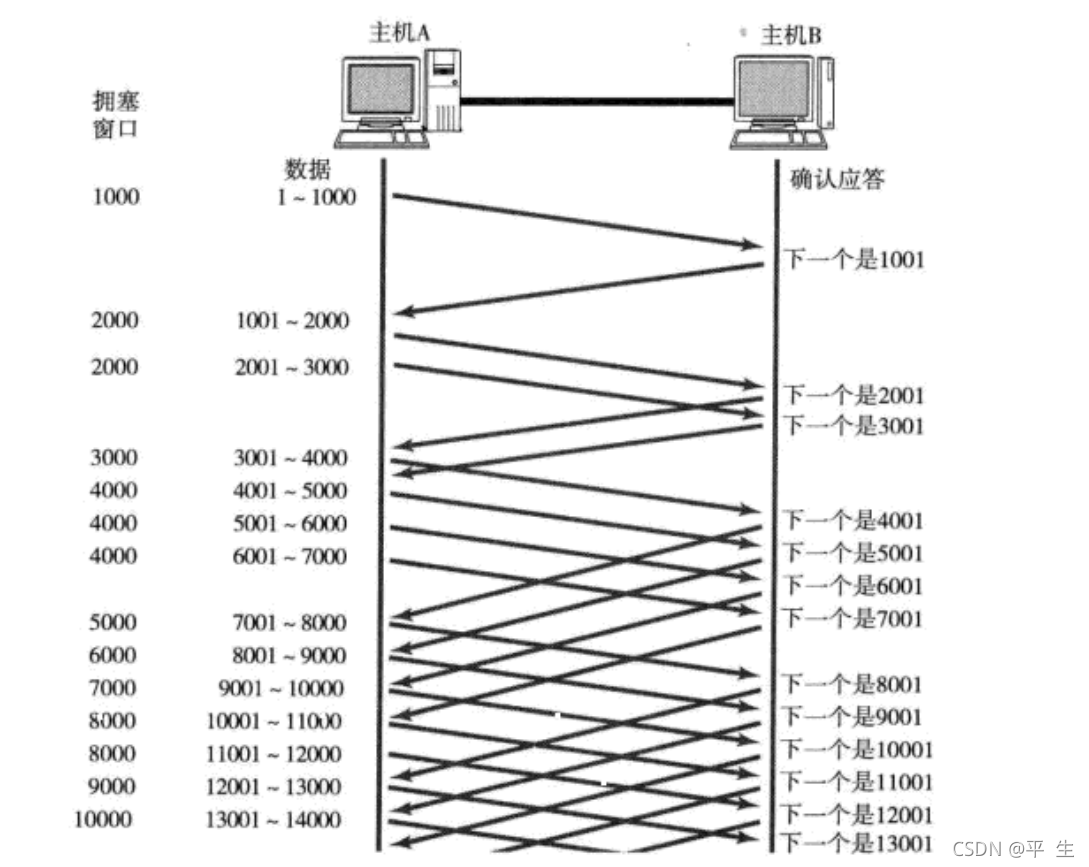

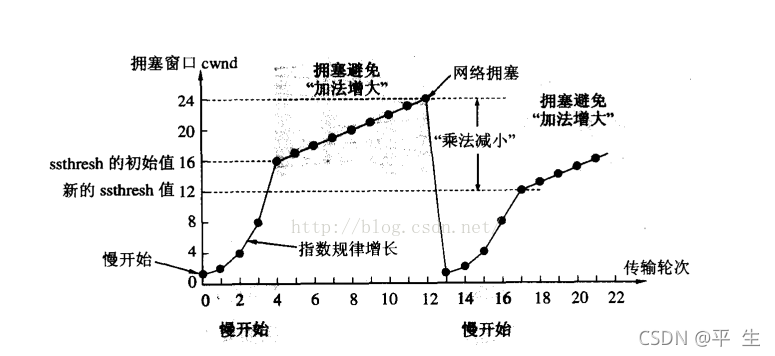

拥塞控制

此处引入一个概念程为 拥塞窗口发送开始的时候 , 定义拥塞窗口大小为 1;每次收到一个 ACK 应答 , 拥塞窗口加 1;每次发送数据包的时候 , 将拥塞窗口和接收端主机反馈的窗口大小做比较 , 取较小的值作为实际发送的窗口

为了不增长的那么快 , 因此不能使拥塞窗口单纯的加倍 .此处引入一个叫做慢启动的阈值当拥塞窗口超过这个阈值的时候 , 不再按照指数方式增长 , 而是按照线性方式增长

当 TCP 开始启动的时候 , 慢启动阈值等于窗口最大值 ;在每次超时重发的时候 , 慢启动阈值会变成原来的一半 , 同时拥塞窗口置回 1;少量的丢包 , 我们仅仅是触发超时重传 ; 大量的丢包 , 我们就认为网络拥塞 ;当 TCP 通信开始后 , 网络吞吐量会逐渐上升 ; 随着网络发生拥堵 , 吞吐量会立刻下降 ;拥塞控制 , 归根结底是 TCP 协议想尽可能快的把数据传输给对方 , 但是又要避免给网络造成太大压力的折中方案

延迟应答

假设接收端缓冲区为 1M. 一次收到了 500K 的数据 ; 如果立刻应答 , 返回的窗口就是 500K;但实际上可能处理端处理的速度很快 , 10ms 之内就把 500K 数据从缓冲区消费掉了 ;在这种情况下 , 接收端处理还远没有达到自己的极限 , 即使窗口再放大一些 , 也能处理过来 ;如果接收端稍微等一会再应答 , 比如等待 200ms 再应答 , 那么这个时候返回的窗口大小就是 1M;

数量限制 : 每隔 N 个包就应答一次 ;时间限制 : 超过最大延迟时间就应答一次

捎带应答

捎带应答:允许主机在ACK中加入数据进行应答

面向字节流

粘包问题

首先要明确 , 粘包问题中的 " 包 " , 是指的应用层的数据包 .在 TCP 的协议头中 , 没有如同 UDP 一样的 " 报文长度 " 这样的字段 , 但是有一个序号这样的字段 .站在传输层的角度 , TCP 是一个一个报文过来的 . 按照序号排好序放在缓冲区中 .站在应用层的角度 , 看到的只是一串连续的字节数据 .那么应用程序看到了这么一连串的字节数据 , 就不知道从哪个部分开始到哪个部分 , 是一个完整的应用层数据包.

正是因为我们的TCP是按照字节流的,所以可能会出现粘包问题

粘包问题:因为读到的数据会按照TCP报头在缓冲区中排序,但是我们的应用层在读数据时是有可能对报文进行多读或漏读的

那么我们如何来解决粘包问题呢?

对于定长的包 , 保证每次都按固定大小读取即可 ; 例如上面的 Request 结构 , 是固定大小的 , 那么就从缓冲区从头开始按sizeof(Request) 依次读取即可 ;对于变长的包 , 可以在包头的位置 , 约定一个包总长度的字段 , 从而就知道了包的结束位置 ;对于变长的包 , 还可以在包和包之间使用明确的分隔符 ( 应用层协议 , 是程序猿自己来定的 , 只要保证分隔符不和正文冲突即可)

其实我们最主要的点就是要明确两个数据包间的边界就可以了

那么对于UDP而言,是否也有粘包问题呢?

对于 UDP, 如果还没有上层交付数据 , UDP 的报文长度仍然在 . 同时 , UDP 是一个一个把数据交付给应用层. 就有很明确的数据边界 .站在应用层的站在应用层的角度 , 使用 UDP 的时候 , 要么收到完整的 UDP 报文 , 要么不收 . 不会出现 " 半个" 的情况

所以我们的UDP并没有粘包问题

TCP异常情况

进程终止 : 进程终止会释放文件描述符 , 仍然可以发送 FIN. 和正常关闭没有什么区别 .机器重启 : 和进程终止的情况相同 .机器掉电 / 网线断开 : 接收端认为连接还在 , 一旦接收端有写入操作 , 接收端发现连接已经不在了 , 就会进行 reset. 即使没有写入操作, TCP 自己也内置了一个保活定时器 , 会定期询问对方是否还在 . 如果对方不在 , 也会把连接释放 .另外 , 应用层的某些协议 , 也有一些这样的检测机制 . 例如 HTTP 长连接中 , 也会定期检测对方的状态 . 例如 QQ, 在 QQ断线之后, 也会定期尝试重新连接

TCP/UDP对比

TCP 用于可靠传输的情况 , 应用于文件传输 , 重要状态更新等场景 ;UDP 用于对高速传输和实时性要求较高的通信领域 , 例如 , 早期的 QQ, 视频传输等 . 另外 UDP 可以用于广播

3480

3480

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?