1 SCHEDULER = "scrapy_redis.scheduler.Scheduler" # 使用scrapy-redis的调度器 2 ITEM_PIPELINES = { 3 'scrapy_redis.pipelines.RedisPipeline': 400, # 尽量将scrapy-redis的管道类设置为最高 4 # 'aiwanCrawl.pipelines.AiwancrawlPipeline': 300 自己的爬虫项目中的管道类 5 } 6 REDIS_HOST = 'redis的IP地址' 7 REDIS_PORT = 6379 8 REDIS_ENCODING = 'utf-8' 9 DUPEFILTER_CLASS = "scrapy_redis.dupefilter.RFPDupeFilter" # 使用scrapy-redis的过滤器类 10 SCHEDULER_PERSIST = True # 配置调度器是否要持久化, 也就是当爬虫结束了, 要不要清空Redis中请求队列和去重指纹的set。如果是True, 就表示要持久化存储, 就不清空数据, 否则清空数据 11 CONCURRENT_REQUESTS = 100 # 开启的线程数量 12 USER_AGENT = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64)AppleWebKit/537.36KHTML, like Gecko) Chrome/71.0.3578.98 Safari/537.36' 13 LOG_LEVEL = 'INFO' # 日志级别 14 ROBOTSTXT_OBEY = False # 是否遵循robots协议

将以上配置信息直接写在自己爬虫项目中的settings.py中最下面即可。。。

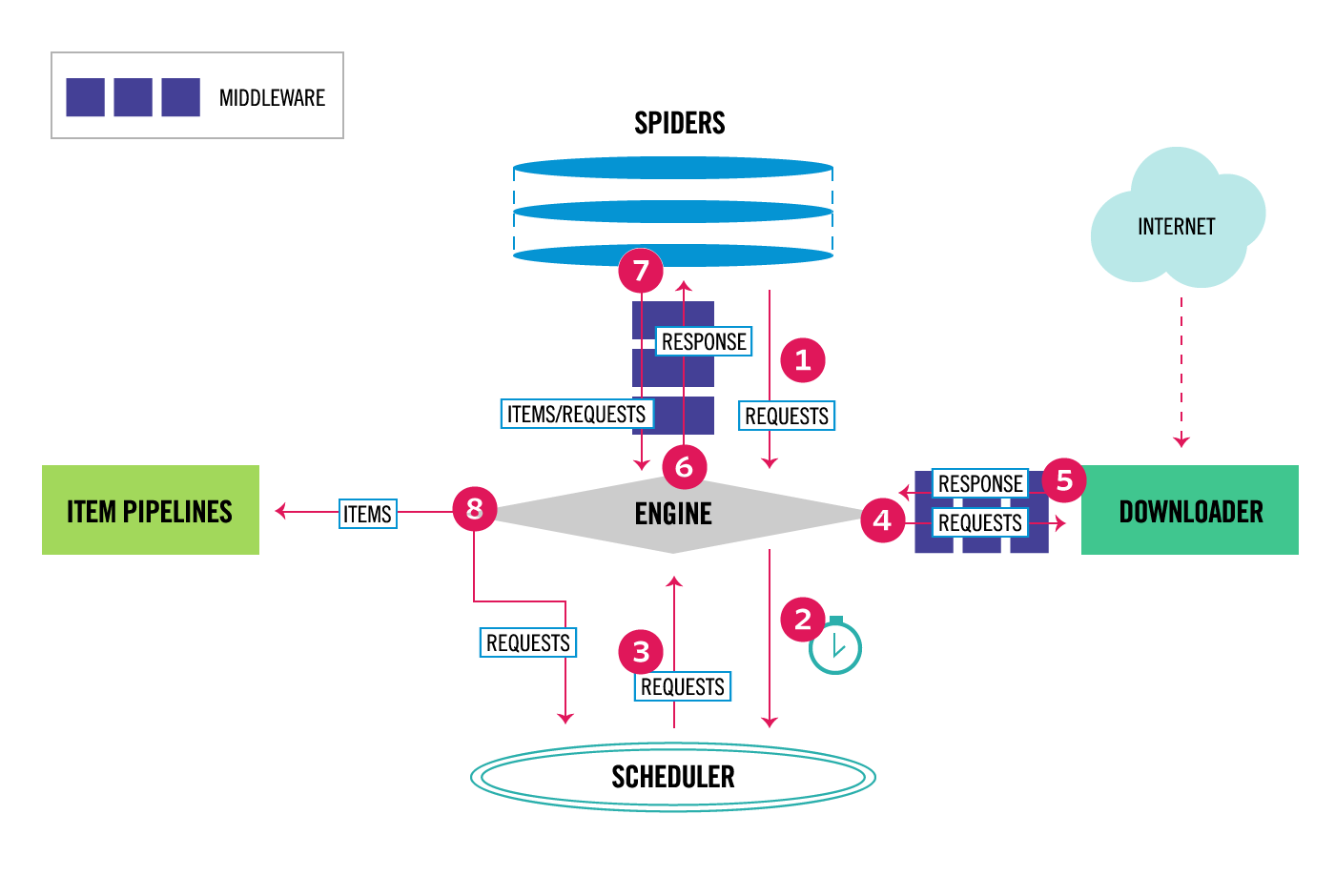

scrapy请求流程图:

219

219

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?