1. 全连接

- k 个输入;

- n 个神经元;

- 每个神经元都会学到一组权值向量,以和输入进行内积运算;

- n 个输出;

2. 卷积

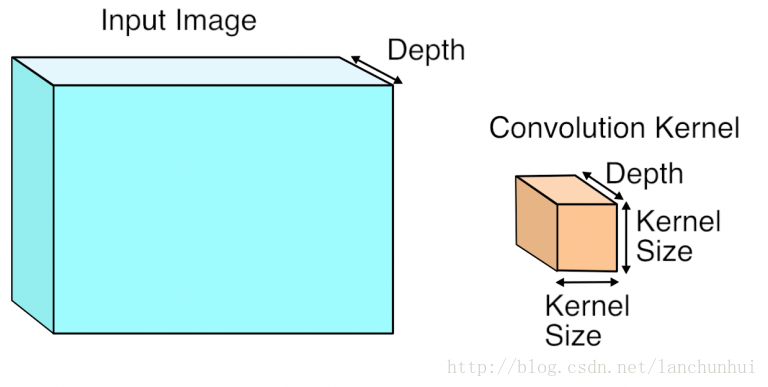

卷积操作对于高维(多个平面)的输入,单个卷积核的深度应和输入的深度(depth)保持一致:

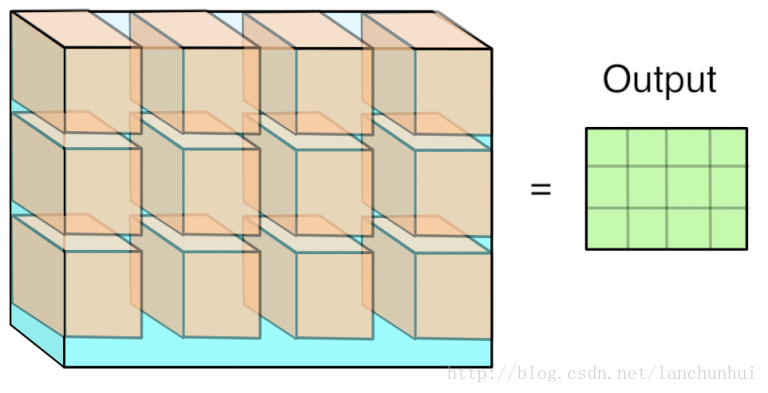

3 维卷积运算执行完毕,得一个 2 维的平面:

注,n 个3维卷积核以得到 n 个 feature maps;

3. 卷积操作中的矩阵乘法

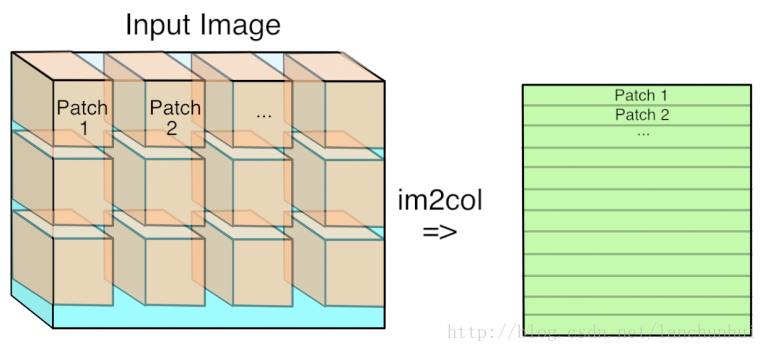

按 [kernel_height, kernel_width, kernel_depth] ⇒ 将输入分成 3 维的 patch,并将其展成一维向量;

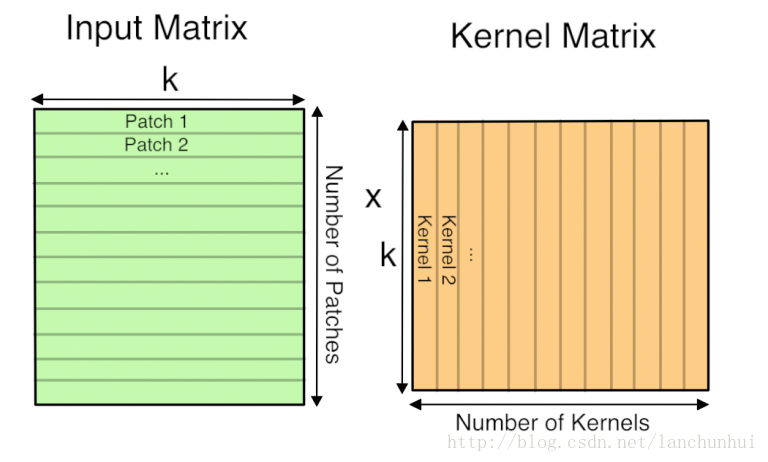

此时的卷积操作就可转化为矩阵乘法:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?