ELK7.2 服务操作实战演示

安装部署过程就不做阐述,自行部署。

1、主机信息:

客户端:192.168.19.139(system、tomcat日志)

ES:192.168.19.138:9200 192.168.19.139:9200

Redis:192.168.19.139:6379 12345

Logstash:192.168.19.138 192.168.19.139

2、软件版本:

elasticsearch-7.2.0

logstash-7.2.0

kibana-7.2.0-linux-x86_64

filebeat-7.2.0-linux-x86_64

3、数据流向示意图

客户端——logstash——redis——logstash——ES——kibana——nginx

Filebeat conf(in、out) conf(in、out) 浏览器 conf

4、操作步骤

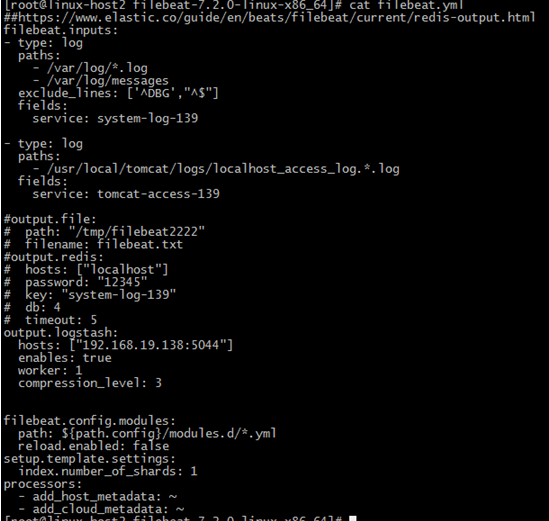

A、客户端配置,收集系统日志和tomcat访问日志

以上是filebeat文件配置

[root@linux-host2 filat-7.2.0-ux-x86_64]# ./filebeat -e -c filebeat.yml

启动命令,会有日志输入,如没有error信息输出,则展示正常。

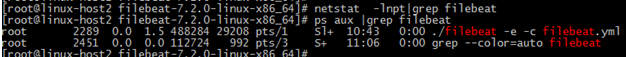

如下,无端口输出,只有进程。

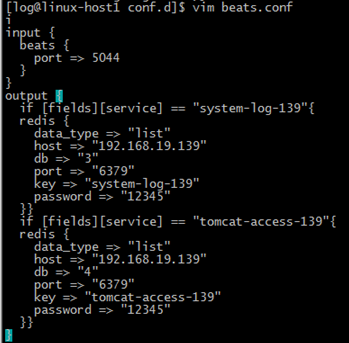

B、Logstash配置

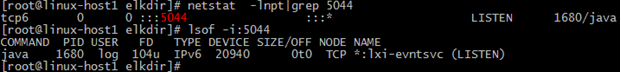

如上,filebeat客户端将数据转向192.168.19.138:5044端口,需要配置接收并输出到redis服务。

配置格式如上,将输出到redis。

[log@linux-host1 logstash-7.2.0]$ ./bin/logstash -f ./conf.d/beats.conf

启动方式,无报错信息即可。验证启动是否成功

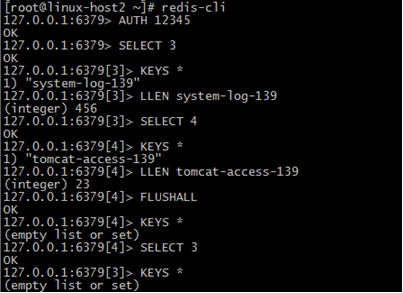

C、登录redis,确定有键值对和数据记录信息。

如下,有相关日志信息进来,正常。

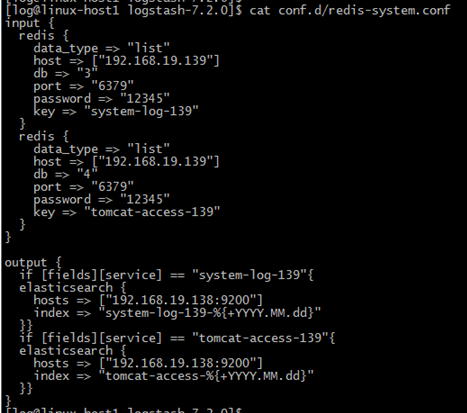

D、将redis日志输入,放到es存储中。

[log@linux-host1 logstash-7.2.0]$ ./bin/logstash -f ./conf.d/redis-system.conf

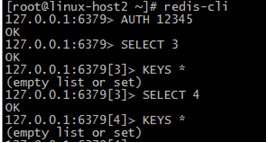

启动服务,确保打印信息无报错。Redis验证,无键值已全部被消费掉。

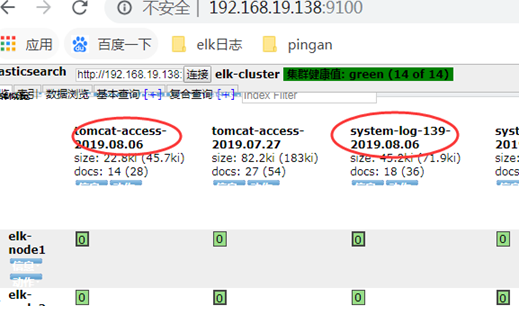

此时,可以登录elasticsearch-head,查看响应的索引输出。

正常显示如上,正常。

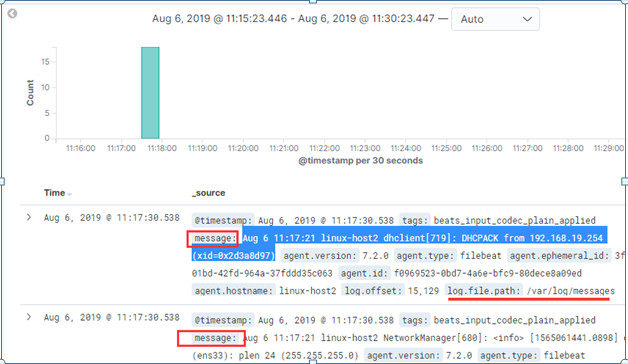

E、在kibana中创建索引信息,查看数据。

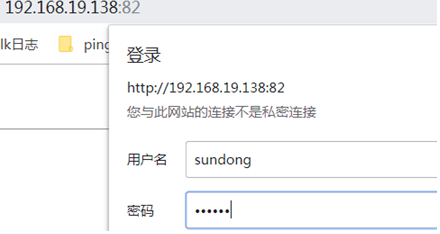

F、kibana配置安全认证访问

输入账号密码访问,获取如上效果。

自此完成了elk整个过程实现。

详细的配置参考https://github.com/Wangwang12345/elk

381

381

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?