文本纠错,是自然语言处理领域检测一段文字是否存在错别字、以及将错别字纠正过来的技术,一般用于文本预处理阶段,同时能显著缓解智能客服等场景下语音识别(ASR)不准确的问题。

本文将通过以下几个章节简要介绍文本纠错相关知识。

1. 文本纠错示例与难点2. 文本纠错常用技术3. 如何将 BERT 应用于文本纠错4. 文本纠错最优模型:Soft-Masked BERT(2020-ACL)5. 立马上手的纠错工具推荐一.文本纠错示例与难点

生活中常见的文本错误可以分为(1)字形相似引起的错误(2)拼音相似引起的错误 两大类;如:“咳数”->“咳嗽”;“哈蜜”->“哈密”。错别字往往来自于如下的“相似字典”。

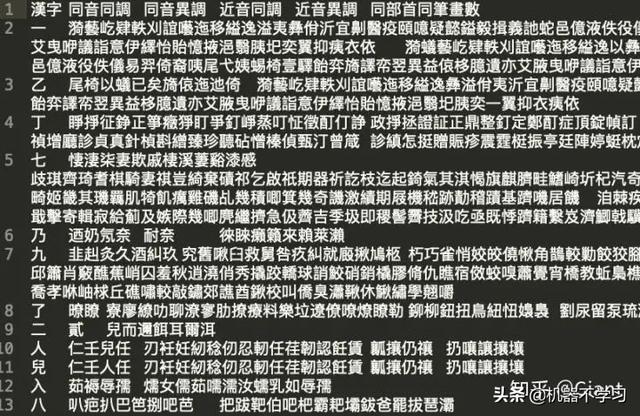

相似发音中文字典

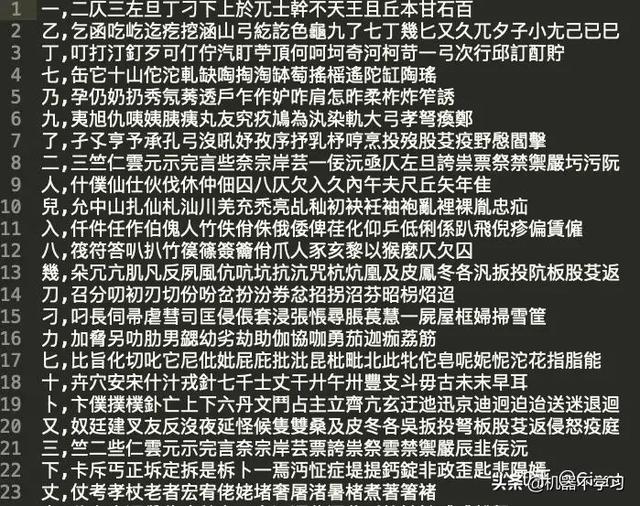

相似字形中文字典

其他错误还包括方言、口语化、重复输入导致的错误,在ASR中较为常见。

现有的NLP技术已经能解决多数文本拼写错误。剩余的纠错难点主要在于,部分文本拼写错误需要常识背景(world-knowledge)才能识别。例如:

Wrong: "我想去埃及金子塔旅游。"Right: "我想去埃及金字塔旅游。"将其中的“金子塔”纠正为“金字塔”需要一定的背景知识。

同时,一些错误需要模型像人一样具备一定的推理和分析能力才能识破。例如:

Wrong: "他的求胜欲很强,为了越狱在挖洞。"Right: "他的求生欲很强,为了越狱在挖洞。"“求胜欲”和“求生欲”在自然语言中都是正确的,但是结合上下文语境来分析,显然后者更为合适。

最后,文本纠错技术对于误判率有严格的要求,一般要求低于0.5%。如果纠错方法的误判率很高(将正确的词“纠

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1804

1804

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?