ps:我第一次datanode没有启动是因为我的java_home指错了;后来namenode没法启动,删了/home/wangxing/Hadoop-0.20.2/tmpdir/hdfs/data/current/VERSION文件就行了,前面那部分目录就是hdfs-site.xml配置文件中dfs.data.dir指向的目录

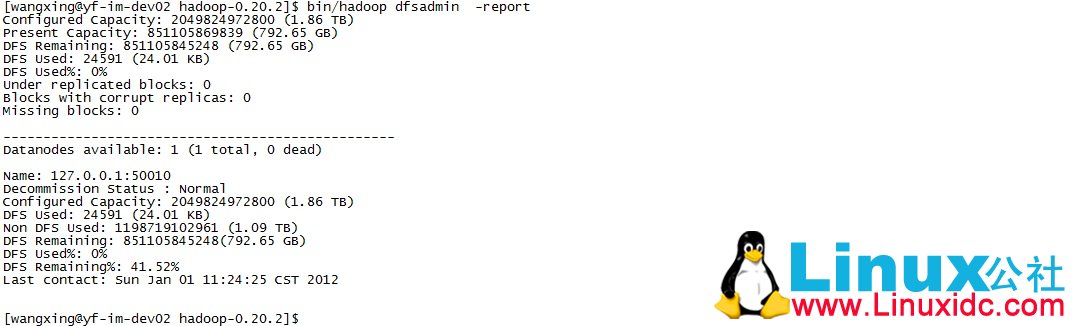

7.查看集群状态:bin/hadoop dfsadmin -report

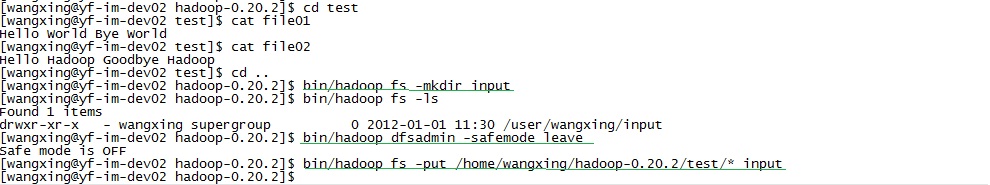

8.在/home/wangxing/hadoop-0.20.2创建目录test,在test下创建文本file01、file02,分别输入数个单词

9.在hdfs分布式文件系统创建目录input:bin/hadoop fs -mkdir input;之后可以使用bin/hadoop fs -ls查看

ps:删除目录:bin/hadoop fs -rmr ***;删除文件:bin/hadoop fs -rm ***

10.离开hodoop的安全模式:bin/hadoop dfsadmin -safemode leave

11.将文本文件放入hdfs分布式文件系统中:bin/hadoop fs -put /home/wangxing/hadoop-0.20.2/test/* input

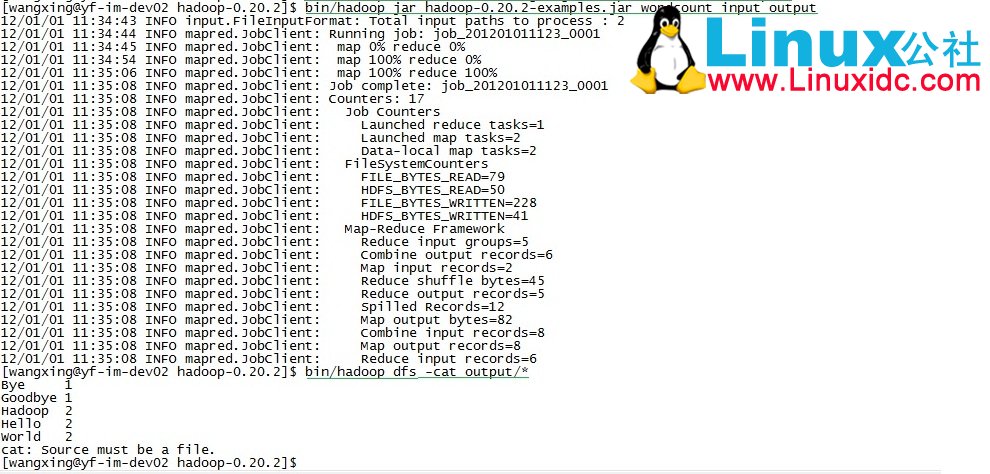

12.执行例子中的WordCount:bin/hadoop jar hadoop-0.20.2-examples.jar wordcount input output

13.查看执行结果:bin/hadoop dfs -cat output/*

14.关闭hadoop所有进程:bin/stop-all.sh

553

553

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?