集群描述

YARN情况如下:

- NodeManager个数为20

- 每个Nodemanager分配内存为104G左右。

- 每个container内存设置为4G,可生成约520个container。

- 资源调度方式为fair scheduler。

加工数据

加工数据为1T的gzip压缩数据,解压约为3至4T数据,个数为1000个。

负载任务

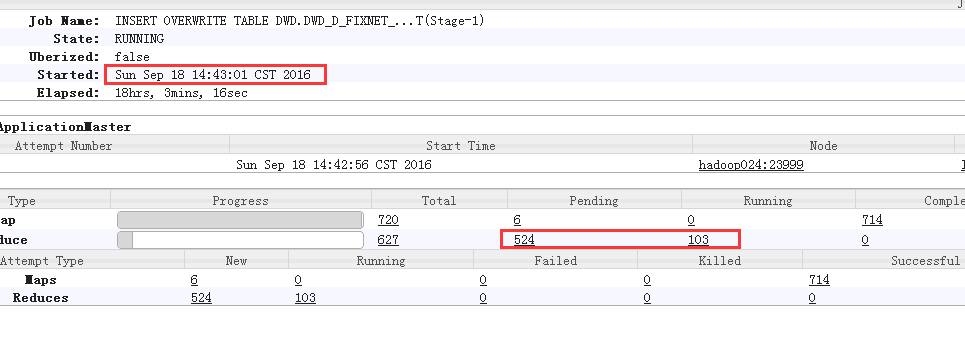

任务执行情况如下:

- 每个任务:map1000+,reduce1000+

- 如果集群只运行单个任务,则单个计算时间可控制在10分钟左右。

- 最多同时运行10至20个任务,每个任务可分配到使用的contianer个数为30-50个。

问题描述

问题现象

- 大部分任务的Map剩余部分Pending

- 任务的Reduce已经启动显示为Running

- 集群CPU负载几乎为0

示例

如20个任务,每个任务剩余10-100个的Map在Pending状态,每个任务的Reduce获取了约25个container显示为Running状态。因此,整个集群的任务都在等待其他任务释放container,然而各自任务的Reduce占用了container却不释放,全部任务都处于等待状态。

解决思路

参数调整

将产生Map较多的任务参数mapreduce.job.reduce.slowstart.completedmaps设置为1.0。避免Map和Reduce过多的任务出现Map未执行完,Reduce任务先开始执行,过多任务并行时所需资源相互等待的窘境。这是客户端参数

不利影响

- 当集群负载比较空闲时,少数任务中Map接近执行完毕,而Reduce任务不启动导致的container闲置,集群资源浪费。若Map任务处理数据出现不平均的情况,这种情况会更加严重。

- 从集群资源负载监控会出现Map和Reduce任务出现两个波峰,中间出现波谷(Cpu空闲)。

2725

2725

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?