在idea上创建一个基于sbt的spark项目时,sbt依赖报错

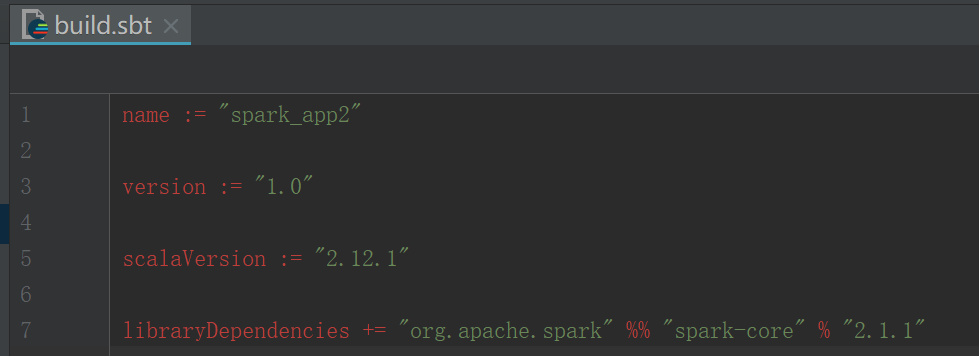

build.sbt 文件内容如下:

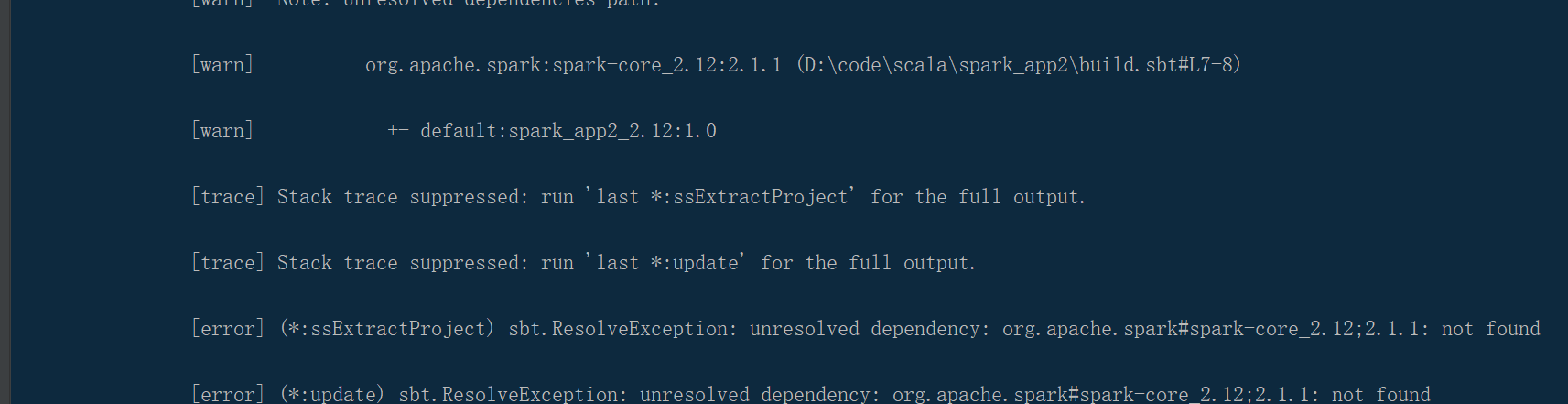

解析依赖的时候提示:

可以看出,这是找不到spark依赖,然后访问了sbt提供的依赖的pom的url,发现确实不存在,

在maven库上看了下,spark-core包的版本目前为2.11,没有2.12,于是在晚上查找了一下,

发现有类似的问题,最终在

https://stackoverflow.com/questions/25285855/unresolved-dependencies-error-while-trying-to-create-jar 找到了解决方案

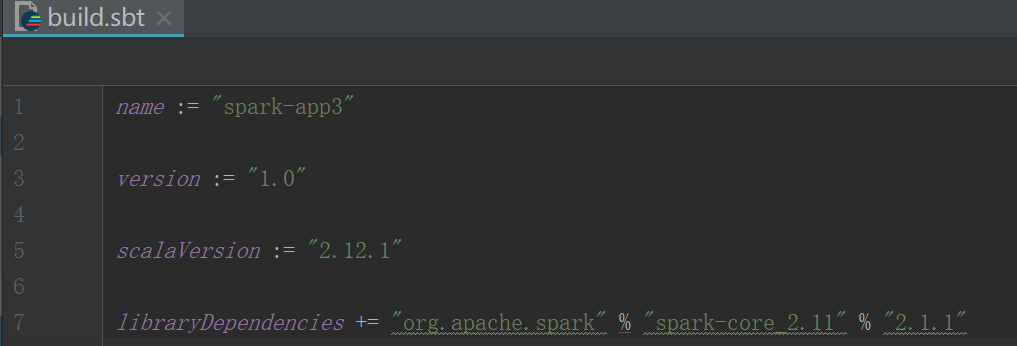

1、%%改为%

2、spark-core 改为 spark-core_2.11

最终的依赖如下:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?